Launch-Analyse: nVidia GeForce GTX 680

Nach langem Warten stellt nVidia heute mit der GeForce GTX 680 und dem zugrundeliegendem GK104-Chip das erste Produkt der Kepler-Architektur vor, mittels welcher nVidia – ähnlich wie AMD bei der GCN-Architektur der Radeon HD 7000 Serie – einen gewissen Stilbruch in der Grafikchip-Architektur vornimmt. Hinzu kommt die spezielle Situation, daß der GK104-Chip eigentlich einmal als Lösung für das Performance-Segment geplant war, nun aber seitens nVidia mittels höherer Taktraten sogar zum Kontrahenten von AMDs bester SingleChip-Lösung Radeon HD 7970 auserkoren wurde und im Zuge dieses Wandels sowohl in der Namenswahl als auch beim Preispunkt kräftig zulegte.

Denn im eigentlichen ist der GK104-Chip der Nachfolger des GF114-Chips der GeForce GTX 560 /Ti und nicht der Nachfolger des GF110-Chips der GeForce GTX 570 & 580 – jener GF110-Chip wird mit dem GK110-Chip [2] im Spätsommer seinen eigenen Nachfolger bekommen. Daß der GK104-Chip trotzdem "mit den Großen mitspielen kann", verdankt dieser Chip maßgeblich zwei Punkten: Erstens einmal hat AMD bei seiner kompletten Radeon HD 7000 Serie doch nur eher maßvoll die Performance-Möglichkeiten der 28nm-Fertigung ausgespielt – und zweitens konnte sich nVidia beim GK104-Chip viel von dem für GPGPU benötigten Einheiten und Transistoren sparen, welche AMD beim R1000/Tahiti und nVidia beim GK110 verbauen müssen.

| Fertigung | Chipfläche | Transistoren | |

|---|---|---|---|

| AMD RV940/Barts -> Pitcairn | 40nm -> 28nm | 255mm² -> 212mm² | 1,7 Mrd. -> 2,8 Mrd. |

| AMD RV970/Cayman -> R1000/Tahiti | 40nm -> 28nm | 389mm² -> 365mm² | 2,64 Mrd. -> 4,313 Mrd. |

| nVidia GF114 -> GK104 | 40nm -> 28nm | 358mm² -> 294mm² | 1,95 Mrd. -> 3,54 Mrd. |

| nVidia GF110 -> GK110 | 40nm -> 28nm | 520mm² -> ~550mm² | 3 Mrd. -> ~6 Mrd. |

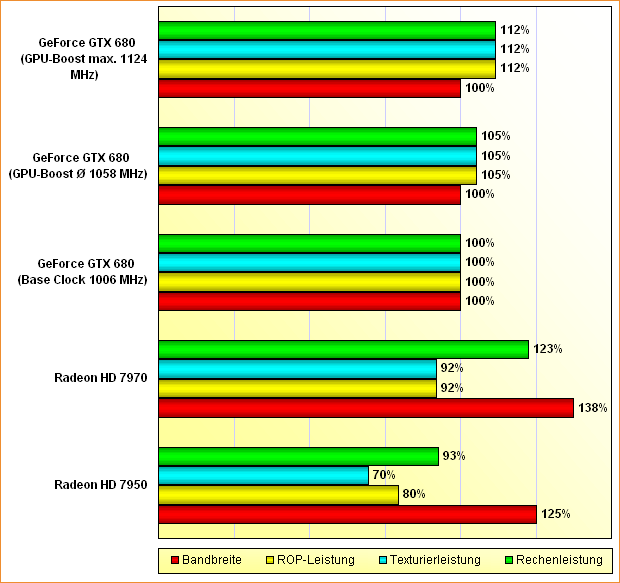

So kommt es zu der eigentlich irritierenden Situation, daß der GK104-Chip mit einer klar kleineren Chipfläche von nur 294mm² gegen den R1000/Tahiti-Chip von AMD mit einer Chipfläche von 365mm² antritt – und trotzdem bezüglich der Spiele-Performance absolut auf Augenhöhe operiert. Einfach ausgedrückt steht hier seitens AMD ein Spiele/GPGPU-Mehrzweckchip gegen einen seitens nVidia maßgeblich nur auf den Spieleeinsatz ausgerichteten Chip. Daneben hat nVidia die Vorteile der Fermi-Architektur beim Frontend der Grafikchip-Architektur nach Kepler transferiert, bietet also die weiterhin höhere Rasterpower – was besonders bei solcherart HighEnd-Chips mit vielen Recheneinheiten wichtig ist, um diese auch sinnvoll auslasten zu können (ein deutliches Problem von R1000/Tahiti).

| Radeon HD 7950 | Radeon HD 7970 | GeForce GTX 580 | GeForce GTX 680 | |

|---|---|---|---|---|

| Chipbasis | AMD R1000/Tahiti, 4,3 Milliarden Transistoren in 28nm auf 365mm² Chip-Fläche | nVidia GF110, 3 Milliarden Transistoren in 40nm auf ca. 520mm² Chip-Fläche | nVidia GK104, 3,54 Milliarden Transistoren in 28mn auf 294mm² Chip-Fläche | |

| Technik | DirectX 11.1, 2 Raster Engines, 1792 (1D) Shader-Einheiten, 112 TMUs, 32 ROPs, 384 Bit DDR Interface | DirectX 11.1, 2 Raster Engines, 2048 (1D) Shader-Einheiten, 128 TMUs, 32 ROPs, 384 Bit DDR Interface | DirectX 11, 4 Raster Engines, 512 (1D) Shader-Einheiten, 64 TMUs, 48 ROPs, 384 Bit DDR Interface | DirectX 11.1, 4 Raster Engines, 1536 (1D) Shader-Einheiten, 128 TMUs, 32 ROPs, 256 Bit DDR Interface |

| Taktraten | 800/2500 MHz | 925/2750 MHz | 772/1544/2000 MHz | 1006/3000 MHz (GPU-Boost Ø 1058 MHz, max. 1124 MHz) |

| Speicherausbau | 1536 oder 3072 MB GDDR5 | 3072 MB GDDR5 | 1536 oder 3072 MB GDDR5 | 2048 MB GDDR5 |

| PCI Express | PCI Express 1.x/2.0/3.0 | PCI Express 1.x/2.0/3.0 | PCI Express 1.x/2.0 | PCI Express 1.x/2.0/3.0 |

| Layout | SingleSlot & DualSlot | DualSlot | DualSlot | DualSlot |

| Kartenlänge | 281mm | 281mm | 267mm | 26cm |

| Stromanschlüsse | 2x 6pol. | 1x 6pol. + 1x 8pol. | 1x 6pol. + 1x 8pol. | 2x 6pol. |

| TDP/MGCP | 200W | 250W | 244W | 195W |

| Idle-Verbrauch | 16W [3] | 14W [4] | 31W [4] | ~15W |

| Spieleverbrauch | 154W [3] | 211W [4] | 238W [4] | ~190W |

| Perform.index | 290% | 330% | 280% | 360% |

| Preislage | 380-410 Euro [5] | 450-480 Euro [5] | 340-380 Euro [5] | 480-520 Euro |

Demzufolge ist es am Ende nicht ganz verwunderlich, wenn nVidia die gleiche Spiele-Performance aus der etwas geringeren Anzahl an Shader-Einheiten herausholt, welche sich nunmehr zwischen AMD- und nVidia seit langer Zeit mal wieder ganz gut vergleichen lassen. Hier liegt dann auch der hauptsächliche Unterschied zwischen Fermi und Kepler: nVidia verabschiedet sich mit Kepler von den Shader-Einheiten mit Hotclocks und geht wie bei AMD zu sehen auf einfacher umzusetzende Shader-Einheiten mit regulärem Chiptakt – von denen man dann eben auch viel mehr verbauen kann. Dabei erhöht nVidia im Vergleich der Grafikchips GK114 zu GK104 die Anzahl der Shader-Einheiten aber nicht nur um den Faktor 2 (um den Wegfall der Hotclocks auszugleichen), sondern gleich um den Faktor 4 – kommt also noch ohne Berücksichtigung der gestiegenen Taktraten schon auf die verdoppelte Shader-Leistung.

Hinzu kommt dann noch der auf 1006 MHz gestiegende Chiptakt, welcher ein wenig den Vorteil von AMDs höherer Anzahl an Shader-Einheiten abknabbert. Dieser Unterschied wird weiter reduziert durch das GPU-Boost Feature, welches eine dynamische Übertaktung des Chips vornimmt, bis ein im BIOS der Grafikkarte festgesetzter TDP-Wert erreicht wird. Der von nVidia diesbezüglich angegebene Boost-Takt von 1058 MHz bei der GeForce GTX 680 stellt aber nur einen Mittelwert dar, welchen nVidia garantieren will – sofern die Karte aber mehr Spielraum feststellt, taktet sie sich auch höher. In verschiedenen Tests wurden hierbei Höchst-Taktraten zwischen 1110 und 1124 MHz festgestellt – gegenüber der default-Taktrate sind dies beachtbare 10 bis 12 Prozent, gegenüber dem "garantierten" Boost-Takt von 1058 MHz dann 5 bis 6 Prozent.

Letzterer Wert ist jener, um welchen Benchmark-Werte zu GeForce GTX 680 Karten in theoretischen Konstruktionen aufgrund GPU-Boost voneinander abweichen können – denn die 1058 MHz Boost-Takt garantiert nVidia schließlich. In der Praxis dürfte es aber zum einen kaum Situationen geben, wo die eine Karte nicht über diese 1058 MHz hinauskommt und die nächste dann locker 1124 MHz schafft. Hinzu kommt, daß der GPU-Boost in aller Regel nur Teile eines Benchmark-Durchlaufs beschleunigt – logischerweise zumeist diese Teile, wo die Grafikkarte weniger als üblich zu tun hat und daher (ohne GPU-Boost) unterhalb ihres TDP-Limits liegt. In der Praxis kann GPU-Boost damit selbst unter wirklich schlechten Bedingungen für vielleicht bis zu 3 Prozent Performance-Different stehen, im Normalfall dürften es ein bis zwei Prozent sein, was nahe der allgemeinen Meßungenauigkeit liegt.

Allerdings besteht bei GPU-Boost die Befürchtung, daß das Feature für die Spiele-Praxis möglicherweise unnütz ist und faktisch nur Benchmark beschleunigt – vulgo Balken-Länge produziert. Denn hochgetaktet wird schließlich nur dann, wenn der Grafikchip durch das Spiel nicht vollens ausgelastet ist. Wenn der Grafikchip aber beispielsweise nur in den sowieso schnellen Szenen hochtaktet, dann werden aus 100 fps eben 110 fps, was zwar zwar gut für einen Benchmark erscheint, in der Spiele-Praxis aber ohne Belang ist – dort interessiert eher die Beschleunigung der langsamen Szenen von unter 50 fps. Diesbezüglich gibt es nun die Befürchtung, daß GPU-Boost in diesen langsamen Szenen nicht oder nur unterdurchschnittlich hochtaktet, weil der Grafikchip gemäß allgemeiner Theorie in den eher langsamen Spiele-Szenen ja schon voll ausgelastet ist und daher keine (oder weniger) TDP-Reserven haben sollte.

Diese Erläuterung hört sich erst einmal plausibel an – und trifft aber wahrscheinlich nicht auf die Realität des Wirkens eines Grafikchips zu. Wenn ein Grafikchip mal eine wirklich schwere Spiel-Szene zu bewältigen hat, wo die Framerate also wirklich heruntergeht, dann ist der Grafikchip zwar in der Tat schwer am Arbeiten – aber höchstwahrscheinlich limitiert gerade bei einer sehr niedrigen Framerate zuerst ausschließlich eine einzelne Ausführungseinheit (Rasterizer, Tesselation Shader-Einheiten, Texturen-Einheiten, Special Function Units, ROPs, etc.) und die anderen Ausführungseinheiten drehen Däumchen bzw. warten auf neue Daten. In dieser Situation dürfte der Grafikchip gerade sehr viele TDP-Reserven haben, weil halt der gesamte Arbeitsfluß an nur einer Kategorie von Ausführungseinheiten hängt und der Rest der Ausführungseinheiten demzufolge teilweise stark unterausgelastet ist.

Trifft diese Theorie zu (und mehr als eine Theorie ist sie derzeit nicht), dann würde GPU-Boost vermutlich gerade dann das Spiel beschleunigen, wenn die Framerate durch irgendeinen Effekt mal deutlich nach unten fällt. Einfaches Beispiel: Die allseits beliebte Rauchgranate, welche die Framerate für ein paar Sekunden herb nach unten drückt. In dieser Zeitspanne dürfte kaum der ganze Grafikchip nur an dem Raucheffekt und davon ausgelösten Seiteneffekten arbeiten, sondern vermutlich limitiert nur eine einzelne Ausführungseinheit die ganze Arbeit im Chip. Die restlichen Einheiten langweilen sich also, verbrauchen daher weniger Strom und mehr Platz unter der TDP entsteht – der GPU-Boost geht unter Umständen auf sein Maximum und beschleunigt diese Szene durch den höheren Chiptakt um immerhin 10 Prozent.

Sofern es solcherart funktioniert, wäre GPU-Boost nicht nur ein Feature für die Balkenlänge in Benchmarks (welche natürlich trotzdem immer das erste Hersteller-Augenmerk genießen), sondern auch ein herzlich willkommenes Feature im Spiele-Einsatz. Allerdings gibt es bislang keinerlei Bestätigung über das konkrete Detailwirken von GPU-Boost sowie viel zu wenig Erfahrungswerte mit diesem Feature, um diese Auslegung der Dinge schon beschreien zu können. Genauso gut kann auch die vorherige Theorie zutreffen, daß GPU-Boost nur dann beschleunigt, wenn es sowieso eine ausreichend hohe Framerate gibt und somit maßgeblich nur größere Balkenlängen, aber weniger Praxiseffekt erzielt. Man wird diese Thematik weiter beobachten müssen, um hier später einmal zu einem Urteil zu gelangen.

Im übrigen besitzt GPU-Boost auch eine Untertaktfunktion, welche bis auf 640 MHz Chip-Taktrate herunterführt und dafür gedacht ist, den Chip bei zu großer Belastung zu entlasten, um letztlich die gesetzte TDP einhalten zu können. In diesem Augenblick funktioniert nVidias GPU-Boost dann wie AMDs PowerTune, wo das Abriegeln einer zu großen Last im Vordergrund steht. Allerdings sollte diese Untertaktfunktion im Normalfall beiderseits nicht greifen, diese ist vielmehr für (die Grafikchips untypisch hoch auslastenden) "Powerviren" wie den FurMark gedacht. Beim Übertakten der GeForce GTX 680 ist dann jedoch an diese Abriegel-Funktionalität zu denken und somit ebenfalls das TDP-Limit der zu übertakteten Grafikkarte zu erhöhen (möglich mit bis zu 30 Prozent Zuschlag) – ansonsten rennt sich die Übertaktung nämlich schlicht am regulären TDP-Limit von 195 Watt fest, was schon bei einer geringen Übertaktung der Fall sein dürfte.

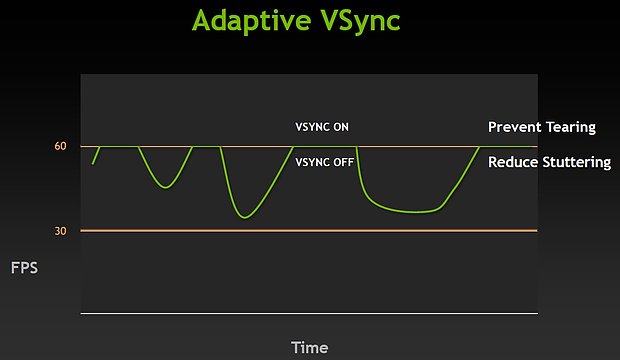

Daneben hat nVidia der Kepler-Architektur noch weitere interessante Features spendiert: "Adaptive Vsync" schaltet Vsync dynamisch aus, wenn die 60-fps-Marke sowieso nicht erreicht wird und nimmt damit zwar Tearing unterhalb dieser fps-Marke in Kauf, vermindert aber die auffallenden und damit störenden Frameraten-Sprünge zwischen glatt 15, 30 und 60 fps bei aktivem Vsync. In der Praxis scheint das Feature gut zu funktionieren und der Tausch von etwas Tearing gegenüber einer "weicheren" Frameausgaben den Hardware-Testern zu gefallen. Desweiteren unterstützt nVidia nunmehr auch Surround-Gaming mit nur einer Grafikkarte, bisher waren hierfür immer mindestens zwei nVidia-Beschleuniger notwendig. Insgesamt können mit einer einzelnen GeForce GTX 680 nunmehr bis zu vier Monitore angesteuert werden.

Im Bereich der Anti-Aliasing-Modi bietet nVidia zum einen das verbesserten FXAA 4.0 an, welches – ähnlich AMDs MLAA – ein Blurfilter ist, der per Shader-Programm Kanten zu erkennen und diese zu glätten versucht, dies aber mit einem gewissen zusätzlichen Unschärfegrad auf das ganze Bild bezahlt. Die Unschärfewirkung ist dabei geringer als bei AMDs MLAA, aber dennoch vorhanden, so daß bei Vorhandensein einer Alternative zu MLAA und FXAA regelmäßig diese empfohlen wird. Ansonsten hat FXAA (wie MLAA) aber (theoretisch) den Vorteil, in jedem Spiel (und ohne Support des Spieleherstellers) funktionieren zu können – ironischerweise traft dies ausgerechnet beim FXAA 4.0 der GeForce GTX 680 im Testbericht der ComputerBase [7] nicht zu, hier liefen einige bekannte Spiele unerwarteterweise nicht unter FXAA 4.0.

Das zweite neue Anti-Aliasing-Verfahren hört auf den Namen TXAA und bietet eine Zusammenführung von normalem Multisampling Anti-Aliasing mit FXAA an. Dabei wird unter TXAA1 schlicht 2x Multisampling Anti-Aliasing mit FXAA kombiniert und unter TXAA2 dann 4x Multisampling Anti-Aliasing mit FXAA. Allerdings gibt es beim hier eingemischten Multisampling Anti-Aliasing eine Besonderheit – die AA-Samples beziehen auch Informationen vom Nebenpixel mit ein und können damit eine bessere Kantenglättungswirkung erreichen. In der Summe sieht nVidia TXAA1 in der Qualität noch vor regulärem 8x Multisampling Anti-Aliasing, aber nur auf den Performance-Anforderungen von 2x Multisampling Anti-Aliasing – dies wäre in der Tat hochinteressant. Da TXAA aber in jedem Fall vom Spielehersteller unterstützt werden muß, gibt es derzeit noch keine praktischen Erfahrungen mit diesem Feature und muß daher dessen Beurteilung in die Zukunft verschoben werden.

Und letztlich kann man bei der über externe Tools wie dem EVGA Precision verfügbaren Option "Frame Rate Targets" ein freies fps-Limit angeben, für welche die Grafikkarte auch nur mit dieser Taktrate (und diesen Spannungen) operiert, die für das Erreichen diese Framerate ausreichend ist. Damit ist es möglich, eher sinnlose Frameraten oberhalb von 60 fps gar nicht erst zu produzieren, was nicht nur Strom spart, sondern die Grafikkarte auch (dauerhaft) weniger heiß arbeiten läßt, was Lüfterdrehzahlen und das Ausfallrisiko der Hardware senkt. Wie der Praxixtest der ComputerBase [8] zu diesem Feature zeigt, funktioniert jene Option absolut hervorragend und kann teilweise deutliche Gewinne bei Stromverbrauch, Chip-Temperatur und Lüfter-Lautstärke hinlegen.

Launch-Analyse: nVidia GeForce GTX 680 (Seite 2)

In der Frage des Stromverbrauchs können wir leider zum ersten Mal seit langem keine gemessenen Stromverbrauchs-Werte zur GeForce GTX 680 von rein nur der Grafikkarte bieten – nVidia hat es (völlig) unverständlich unterlassen, unsere diesbezüglich prädestinierte Partnerseite HT4U [11] rechtzeitig mit einem entsprechendem Testsample zu beliefern. Andere Stromverbrauch-Tests mit Messungen von Gesamtsystemen sowie die üblicherweise etwas zu niedrig liegenden Messungen rein der Grafikkarten bei der PC Games Hardware [12] deuten jedoch auf einem Idle-Verbrauch der GeForce GTX 680 von ca. 15 Watt und einen Spiele-Verbrauch von ca. 190 Watt hin, mithin sehr nahe an der TDP-Grenze von 195 Watt. Hier wirkt dann wieder GPU-Boost, welches durch die dynamische Hoch- unter Heruntertaktung den durchschnittlichen Stromverbrauch sehr nahe an den TDP-Wert heranführen kann.

| Idle | MultiMon. | Spiele | FurMark | TDP/MPCG | |

|---|---|---|---|---|---|

| Radeon HD 6950 2GB | 22W | 58W | 163W | 206W | 200W |

| Radeon HD 6970 | 22W | 66W | 205W | 267W | 250W |

| Radeon HD 7850 | ~12W | ~30W | ~110W | ~135W | ? |

| Radeon HD 7870 | 13W | 31W | 127W | 159W | ? |

| Radeon HD 7950 | 16W | 52W | 154W | 208W | 200W |

| Radeon HD 7970 | 14W | 49W | 211W | 296W | 250W |

| GeForce GTX 560 Ti 448 Core | 25W | 74W | 197W | 243W | 210W |

| GeForce GTX 570 | 24W | 70W | 199W | 247W | 219W |

| GeForce GTX 580 | 31W | 92W | 238W | 318W | 244W |

| GeForce GTX 680 | ~15W | ? | ~190W | ? | 195W |

In der Frage der Geräuschentwicklung kam das Radiallüfter-Referenzdesign von nVidia durchgehend vernünftig bis gut an. Die Karte ist zwar sowohl im Idle-Betrieb als auch im Spiele-Einsatz nicht wirklich leise, aber auch nicht unbedingt störend und für ihre Performanceklasse schon richtiggehend gut. Konkret liegt die Lautstärke insbesondere im Spiele-Einsatz auf dem (vergleichsweise guten) Niveau der GeForce GTX 580 und damit klar niedriger als bei der Radeon HD 7970 zu beobachten war. Hersteller-eigene Designs können hier aber dennoch noch einiges herausholen und für Silent-Fans sei daher natürlich das Abwarten auf eben jene Hersteller-Designs empfohlen.

Womit wir zur letztlich alles entscheidenden Frage der Performance der GeForce GTX 680 kommen. Die verschiedenen Vorab-Benchmarks haben die Hardware-Welt natürlich schon entsprechend angespitzt und alles wartete nun ab, ob sich die Vorhersagen eines Benchmark-Gewinns der GeForce GTX 680 gegenüber der Radeon HD 7970 bestätigen lassen – oder ob es eine Überraschung in dieser Frage gibt. Um Überraschungen durch die Bewertung des "falschen" Hardware-Tests auszuschließen, bieten wir nachfolgend wiederum kumulierte Benchmark-Werte mehrerer Testberichte an, womit kleinere Ungenauigkeiten und falsche Tendenzen im Schnitt der vielen Ergebnisse untergehen sollten und somit ein solider Mittelwert der Benchmarks zur GeForce GTX 680 entsteht:

| 1920x1200 4xAA | 7950 | 7970 | 560Ti | 580 | 680 |

|---|---|---|---|---|---|

| ComputerBase [13] | 86% | 100% | 57% | 82% | 109% |

| TechPowerUp [14] | 88% | 100% | 63% | 87% | 108% |

| Hardwareluxx [15] | 87% | 100% | - | 80% | 106% |

| PC Games Hardware [16] | - | 100% | - | 86% | 108% |

| AnandTech [17] | 87% | 100% | 58% | 85% | 113% |

| Hardware Canucks [18] | - | 100% | - | 83% | 112% |

| Hardware.fr [19] | 86% | 100% | 59% | 82% | 106% |

| Hot Hardware [20] | 87% | 100% | - | 84% | 115% |

| 1920x1200 8xAA | 7950 | 7970 | 560Ti | 580 | 680 |

|---|---|---|---|---|---|

| ComputerBase [13] | 90% | 100% | 55% | 83% | 107% |

| 2560x1600 4xAA | 7950 | 7970 | 560Ti | 580 | 680 |

|---|---|---|---|---|---|

| ComputerBase [13] | 85% | 100% | - | 75% | 101% |

| TechPowerUp [14] | 85% | 100% | 55% | 80% | 104% |

| Hardwareluxx [15] | 87% | 100% | - | 76% | 103% |

| PC Games Hardware [16] | - | 100% | - | 83% | 106% |

| AnandTech [17] | 85% | 100% | - | 79% | 109% |

| Hardware Canucks [18] | - | 100% | - | 80% | 110% |

| Hardware.fr [19] | - | 100% | - | 75% | 102% |

| Hot Hardware [20] | 87% | 100% | - | 80% | 110% |

| 2560x1600 8xAA | 7950 | 7970 | 560Ti | 580 | 680 |

|---|---|---|---|---|---|

| ComputerBase [13] | 87% | 100% | - | 78% | 102% |

| Hardware Canucks [18] | - | 100% | - | 87% | 117% |

| 5760x1080 4xAA | 7950 | 7970 | 560Ti | 580 | 680 |

|---|---|---|---|---|---|

| Hardware Canucks [18] | - | 100% | - | - | 98% |

| Hardware.fr [19] | - | 100% | - | - | 100% |

Nach (stundenlanger) Sichtung aller möglichen Tests und Aufaddierung der dort aufgelaufenen Testergebnis läßt sich jedoch das klare Fazit ziehen, daß es nVidia tatsächlich gelungen ist, mit der GeForce GTX 680 eine gegenüber der Radeon HD 7970 sogar etwas schnellere Grafikkarte hinzulegen – trotz kleinerem Chip und geringerer Stromaufnahme. Dabei legt die GeForce GTX 680 im Schnitt der Messungen einen Vorsprung von 9,6 Prozent unter 1920x1200 4xAA und ca. 5,6 Prozent unter 2560x1600 4xAA gegenüber der Radeon HD 7970 hin. Selbst die (leider nur wenigen) Benchmark-Werte unter 1920x1200 8xAA und 2560x1600 8xAA deuten weiterhin auf einen geringen Vorteil der GeForce GTX 680 hin – zwar nicht mehr ganz so klar wie unter 1920x1200 4xAA, aber weiterhin ausreichend für einen Benchmark-Sieg.

Erst unter 5760x1080 4xAA geht der GeForce GTX 680 dann etwas die Puste aus und sie erreicht "nur noch" dasselbe Ergebnis wie die Radeon HD 7970. Für eine Karte mit ihrem (relativ) kleinerem Speicherinterface ist dies dennoch eine starke Leistung, weil der gegenüber der Radeon HD 7970 relative Performanceabfall der GeForce GTX 680 von 1920x1200 4xAA zu 5760x1080 4xAA nur runde 10 Prozent beträgt, dieser Wert bei früheren nVidia-Grafikkarten viel höher war und AMD in diesen Sphären früher somit weit deutlich vorn lag. Bei der GeForce GTX 680 trifft dies wie gesagt nicht mehr zu, die Karte liegt grob gesagt unter normalen Settings bis zu 10 Prozent vor der Radeon HD 7970 und erreicht selbst unter extremen Settings immer noch einen Performance-Gleichstand zur AMD-Toplösung.

Damit kommt die GeForce GTX 680 basierend auf den heutigen Testergebnissen in unserem 3DCenter Performance-Index auf eine Wertung von 360% Performance, was den Performance-Unterschied zur Radeon HD 7970 auf 330% Performance unter 1920x1200 4xAA ausdrückt. Von den 30 Prozentpunkten Differenz sollte man sich nicht täuschen lassen – relativ sind dies 9,1 Prozent Performanceunterschied im Index, was ziemlich perfekt zum realen Performanceunterschied passt. Daß die GeForce GTX 680 dann unter 2560x1600 4xAA relativ gesehen etwas schwächer wird, kann dieser (wie gesagt streng auf 1920x1200 4xAA basierende) Index natürlich nicht abbilden – allerdings würde ein auf 2560x1600 4xAA basierenden Performance-Index der GeForce GTX 680 eine Wertung von 350% Performance geben, die Differenz ist also eher marginal. Der Performance-Index ist halt nur zur schnellen Einordnung einer Grafikkarte gedacht – vorbehaltlich immer einer Detailbetrachtung, welche bei der GeForce GTX 680 eben eine (geringfügige) Schwäche auf höheren Settings als 1920x1200 4xAA ergibt.

[21]

[21]nVidia GeForce GTX 680 (Referenz-Design) [22]

In der Summe der Dinge bedeutet dies, daß es nVidia gelungen ist, wofür der GK104-Chip sicherlich ursprünglich niemals geplant war: Mit einem Chip des Performance-Segments die schnellste AMD SingleChip-Grafikkarte (der gleichen Fertigungstechnologie) zu schlagen, wenn im Gesamtbild auch nur eher marginal. Dies war vorher so nicht zu erwarten und auch angesichts der in den letzten Wochen geleakten Hardware-Daten zur GeForce GTX 680 keineswegs eine Selbstverständlichkeit – immerhin erzielt nVidia dieses Ergebnis mit einem kleineren Chip mit geringerem Stromverbrauch. Daß nVidia mit dem GK104-Chip keine großartigen GPGPU-Eignung bieten musste und sich daher (im Gegensatz zu AMD beim R1000/Tahiti) reichlich Transistoren für diese Zwecke sparen konnte, zahlt sich hierbei vollens aus.

Und im eigentlichen erfüllt nVidia damit aber auch "nur" eine hier und da gestellte Forderung aus dem Gamer-Bereich nach einem reinen Gamer-Grafikchip unter dem Verzicht auf möglichst viel GPGPU-Ballast. Dieser GPGPU-Ballast wurde schon immer verdächtigt, gerade die HighEnd-Chips von nVidia unnötig aufzublähen und kaum zur Spiele-Performance beizutragen. Mit dem GK104-Chip hat der Gamer nun einen solchen Chip in der Hand: Moderne Architektur, maßvoller Stromverbrauch (für dieses Performance-Segment), interessante neue Feature und eine überzeugende Performance – welche AMDs Toplösung minimal, aber aufzeigbar schlägt.

An dieser Stelle folgt gewöhnlich ein "Aber, ..." – und dies trifft auch hier in voller Härte zu: Aber, der Preis für das verlangte ist deutlich zu hoch – vor allem, wenn man sich vor Augen führt, daß der GK104-Chip eben die Ablösung des GF114-Chips darstellt und der eigentliche HighEnd-Chip GK110 [2] noch folgen wird. Richtung 500 Euro für einen Performance-Chip, welcher möglicherweise am HighEnd-Segment schnuppert, aber dennoch weiterhin seine Herkunft nicht verleugnen kann, sind einfach zu viel – gerade wenn man diese Preislage in Relation dazu betrachtet, wo der Preis eines Tages nach Preiskämpfen und besserer 28nm-Verfügbarkeit mal stehen dürfte. Dann sollte eine GeForce GTX 680 nicht mehr als 300 Euro kosten, eher weniger – und selbst dies wäre im Vergleich zu früheren Performance-Lösungen wie der GeForce GTX 560 Ti (stieg für 210 bis 250 Euro ein [23]) noch sehr viel.

Denn immerhin hat nVidia mit der 28nm-Lösung GeForce GTX 680 auch nichts anderes getan, als auf den wahrhaftigen 40nm-Vorgänger in Form der GeForce GTX 560 Ti jenes Maß an Performance draufgelegt, welches man von der 28nm-Fertigung mindestens erwarten durfte – nämlich runde 70% Performanceplus zwischen GeForce GTX 680 und GeForce GTX 560 Ti. Ob die GeForce GTX 680 ganz langfristig denselben Preispunkt wie die GeForce GTX 560 Ti erreichen kann, wäre etwas zu bezweifeln – zum einen ist die GeForce GTX 680 das etwas höherwertigere Design aufgrund der etwas höheren TDP, zum anderen dürfte nVidia eher die Karte eines Tages durch einen Refresh ersetzen, als daß man so tief im Preis heruntergeht. Nichtsdestotrotz ist der aktuelle Preis der GeForce GTX 560 Ti von etwas unter 200 Euro die eigentliche Zielmarke für die GeForce GTX 680 – und sei es nur um festzustellen, wieviel man heutzutage zu viel für diese Karte bezahlt.

Demzufolge lautet die eigentliche Empfehlung dieser Launch-Analyse zur GeForce GTX 680: Abwarten auf die Einpendelung der Preise der 28nm-Beschleuniger. Dies mag möglicherweise etwas dauern, weil zuerst die 40nm-Modelle auslaufen müssen, zudem muß sich die Liefersituation an 28nm-Grafikchips ebenfalls erst einmal deutlich bessern. Aber nach diesen zwei Punkten kann man deutlich bessere Preislagen der 28nm-Beschleuniger erwarten: Eine Radeon HD 7950 für 250 Euro und Radeon HD 7970 sowie GeForce GTX 680 gemeinsam für 300 Euro. Den HighEnd-Bereich werden in diesem Szenario dann die zu erwartenden DualChip-Grafikkarten mit Preisen von ca. 550 Euro einnehmen, hinzu kommt nVidias HighEnd-Chip GK110 mit einem Preispunkt von vielleicht 450 Euro. Mehr ist nicht sinnvoll und mehr wird auch nicht von der Breite des Marktes bezahlt – die hohen Preise der aktuellen 28nm-Beschleuniger lassen sich nur halten, weil die Liefermengen so gering sind, daß niedrigere Preise derzeit gar nicht lohnen würden. Um aus den 28nm-Beschleunigern aber ein Massengeschaäft zu machen, werden AMD und nVidia kräftig am Preis drehen müssen – und dies kann man ruhig abwarten, ehe man sich später darüber ärgert, heute wirklich deutlich zu viel bezahlt zu haben.

- Erste Testberichte zur GeForce GTX 680:

- Test: nVidia GeForce GTX 680 – Kepler greift Tahiti an [13]

[ComputerBase]

[ComputerBase] - GeForce GTX 680 im Test: Das Imperium schlägt zurück [24]

[Golem]

[Golem] - Test: nVidia GeForce GTX 680 [25]

[Hardwareluxx]

[Hardwareluxx] - Test der nVidia GeForce GTX 680: Ist AMDs Radeon HD 7970 geschlagen? [16]

[PC Games Hardware]

[PC Games Hardware] - nVidia GeForce GTX 680 Review: Retaking The Performance Crown [17]

[AnandTech]

[AnandTech] - nVidia GeForce GTX 680 2GB Review [18]

[Hardware Canucks]

[Hardware Canucks] - nVidia GeForce GTX 680 Review: Kepler Debuts [20]

[Hot Hardware]

[Hot Hardware] - nVidia GeForce GTX 680 Kepler 2GB [14]

[TechPowerUp]

[TechPowerUp] - nVidia's GeForce GTX 680 graphics processor [26]

[The Tech Report]

[The Tech Report] - nVidia GeForce GTX 680 (Kepler) 2GB Reference Card Video Card Review [27]

[TweakTown]

[TweakTown] - nVidia GeForce GTX 680 en test [19]

[Hardware.fr]

[Hardware.fr]

Launch-Analyse: nVidia GeForce GTX 680 (Nachträge)

Nachtrag vom 1. April 2012

Wie bei jeder HighEnd-Grafikkarte interessiert natürlich auch bei der GeForce GTX 680 das Thema der Übertaktungseignung – ergo haben wir aus den Artikeln der letzten zwei Wochen die entsprechenden Übertaktungsergebnisse extrahiert. Dabei scheint die Übertaktung der GeForce GTX 680 durch das Wirken von GPU Boost komplizierter zu sein als üblich – in der Praxis ist es dies aber nicht, da GPU Boost unauffällig im Hintergrund arbeitet und man einfach nur die default-Taktrate ("Base Clock") der GeForce GTX 680 anheben muß, bis sich eben Artefakte einstellen. Daß die Karte dann im Spieleeinsatz teilweise (oder meistens) wegen GPU Boost überhalb des Base Clocks operiert, ist vollkommen normal und schließlich auch ohne Übertaktung der Fall.

Zur Ausgangslage: Die GeForce GTX 680 als die größte Grafikkarten-Variante basierend auf dem GK104-Chip taktet per default mit 1006/3000 MHz, wobei der Chiptakt dynamisch per GPU Boost nach oben oder unten gesetzt wird, immer ausgerichtet an der regulären TDP von 195 Watt. nVidia "garantiert" dabei eine Boost-Taktrate von 1058 MHz, in der Praxis wurden aber eher Boost-Taktraten von 70 bis 110 MHz Aufschlag auf den default-Takt festgestellt. Die Chipspannung wird ebenfalls dynamisch von GPU Boost geregelt und liegt beim Base Clock auf nur 0,987V, geht im Boost-Modus ohne Übertaktung durch den Anwender bis auf 1,15V hinauf, mit Übertaktung bis auf 1,17V. Weiterführende Möglichkeiten zur Spannungsanhebung sind derzeit noch nicht verfügbar.

Alle Übertaktungen der GeForce GTX 680 wurden derzeit mit den Tools EVGA Precision, Asus GPU Tweak oder MSI Afterburner durchgeführt, welche sich im Funktionsumfang (bezüglich des Übertaktens) ungefähr gleichen. So ist eine maximale Chipübertaktung um 549 MHz und eine maximale Speicherübertaktung um 1000 MHz vorgesehen, was aufgrund der hohen Grenzwerte derzeit keinerlei limitierenden Einfluß hat. Zum Übertakten der GeForce GTX 680 muß jedoch in erster Linie die Option "Power Target" auf ihr Maximum von +32% gebracht werden: Damit wird das TDP-Limit der Karte entsprechend angehoben und etwaige Übertaktungen nicht (durch GPU Boost) wegen der originalen TDP-Grenze von 195 Watt heruntergeregelt.

| Overclocking-Ergebnisse der GeForce GTX 680 (default = 1006/3000 MHz) | |||

|---|---|---|---|

| PC Games Hardware [29] | 1180/3557 MHz (nVidia-Referenz) | Hartware [30] | 1130/3556 MHz (Zotac GTX680) |

| Hardwareluxx [31] | 1183/3276 MHz (nVidia-Referenz) | OCaholic [32] | 1206/3304 MHz (Asus GTX680) |

| ComputerBase [33] | 1153/3506 MHz (nVidia-Referenz) | VR-Zone [34] | 1137/3600 MHz (Asus GTX680) |

| Hardware Canucks [35] | 1153/3528 MHz (nVidia-Referenz) | Fudzilla [36] | 1139/3544 MHz (Gainward GTX680) |

| Hot Hardware [37] | 1189/- MHz (nVidia-Referenz) | ||

| TechPowerUp [38] | 1159/3566 MHz (nVidia-Referenz) | ||

| BSN [39] | 1212/- MHz (nVidia-Referenz) | ||

| Hardware.fr [40] | 1106/3600 MHz (nVidia-Referenz) | Neoseeker [41] | 1177/3285 MHz (nVidia-Referenz) |

| Guru3D [42] | 1264/3317 MHz (nVidia-Referenz) | Legit Reviews [43] | 1171/3160 MHz (nVidia-Referenz) |

| Overclock3D [44] | 1215/3055 MHz (nVidia-Referenz) | Overclockers Club [45] | 1186/3254 MHz (nVidia-Referenz) |

| PC Perspective [46] | 1156/- MHz (nVidia-Referenz) | X-bit Labs [47] | 1186/3564 MHz (nVidia-Referenz) |

Das durchschnittliche Übertaktungsergebnis der GeForce GTX 680 ohne (manueller) Spannungszugabe und bezogen auf den Base Clock liegt damit bei 1173/3417 MHz, was +17 Prozent beim Chiptakt und +14 Prozent beim Speichertakt bedeuten. Dies ergibt eine vernünftige Übertaktung der GeForce GTX 680 mit einem Performance-Potential von knapp unter 15 Prozent Performanceplus. Der große Übertakter ist die GeForce GTX 680 damit natürlich nicht – aber dies ist aufgrund des sowieso schon hochgeprügelten Designs auch nicht zu erwarten gewesen.

Zudem bliebe abzuwarten, wie sich die Sache nach echten Spannungsmodifikationen und einem eventuell noch höherem "Power Target" Limit gestaltet – erst dann wird der GK104-Chip zeigen können, was wirklich in ihm steckt. Zudem muß derzeit ebenfalls noch die Frage offenbleiben, inwiefern GPU Boost einen maximalen Übertaktungserfolg verhindert. Unter Umständen kann es für HighEnd-Übertaktungen sinnvoller sein, alle Boost-Taktstufen zu deaktivieren (wofür natürlich erst einmal ein entsprechendes Tool geschrieben werden müsste) und dann ganz konventiell hochzutakten. All dies wird sich im Laufe der Zeit sicherlich ergeben, dafür müssen nur genügend GeForce GTX 680 Karten in Umlauf und damit zu den echten Enthusiasten und Hardcore-Übertaktern gelangen.

Nachtrag vom 19. April 2012

HardOCP [48] haben sich in einem Artikel speziell mit nVidias "Adaptive VSync Technology" beschäftigt und werfen damit dieses beim Launch der GeForce GTX 680 vielleicht etwas zu kurz geratene Thema erneut auf. Mittels Adaptive VSync wird schlicht die Vsync-Funktionalität dynamisch deaktiviert, sobald sowieso keine Frameraten in der Nähe des Vsync-Limits (in aller Regel 60 fps) erreicht werden. Erreichen die Frameraten dagegen das Vsync-Limit, wird Vsync automatisch wieder aktiv, so daß das obligatorische Tearing (auf dem Monitor werden gleichzeitig versetzte Teile von zwei Frames ausgegeben, man sieht also irgendwo einen leichten "Bruch" im Bild) vermieden wird.

[49]

[49]nVidia Adaptive VSync [50]

Vsync ist im Spiele-Alltag ein generell sinnvolles Features und wird gewöhnlich nur zum Benchmarken deaktiviert, da man natürlich nicht die Vsync-Marke des jeweils eingesetzten Monitors testen will, sondern die Leistungsfähigkeit der Grafikkarte. In der Praxis ergibt sich allerdings das Problem mit "springenden" Frameraten unter dem Einsatz von Vsync: Denn Vsync kann systembedingt nicht die exakte von der Grafikkarte erzeugte Framerate ausgeben, sondern nur gewisse Frameraten-Werte, welche auf ganzzahligen Teilern der Refreshrate basieren – bei 60 Hertz sind demzufolge real angezeigte Frameraten von 12, 15, 20, 30, 60 fps möglich (Hintergrund-Artikel Vsync [51]). Dies kann allerdings insbesondere bei den größeren Sprüngen – wie von 30 fps auf 60 fps – dem geübten Auge unangenehm als Stuttering-Effekt auffallen.

Daneben vernichtet Vsync auch noch gehörig an erzeugter Framerate: In einem Beispiel haben HardOCP ohne Vsync – also unter Benchmark-Bedingungen – 48,7 fps ausgemessen, derselbe Test mit Vsync ergab allerdings nur 33,5 fps. Hier wurde augenscheinlich sehr oft die von der Grafikkarte erzeugte Framerate zwischen 30 und 60 fps durch Vsync weggekappt auf nur noch 30 fps, die dann letztlich auf dem Monitor ankamen. Weil es diese wenig beachtete Nebenproblematik so gut demonstriert, erlauben wir uns ausnahmesweise einmal die Kopie eines der Benchmark-Diagramme von HardOCP [48]:

nVidias Adaptive VSync kann diesen beiden Problemen wie gesagt hervorragend entgegenwirken: Zum einen ist Vsync dort aktiv, wo es wegen des störenden Tearings interessant ist und verhindert damit dieses. Dafür ist Vsync dann dort, wo es die Framerate behindert, inaktiv und sorgt somit sogar für real höhere Frameraten: Im Beispiel von HardOCP gab es mit Vsync wie gesagt 33,5 fps und ohne Vsync waren es 48,7 fps – mit Adaptive VSync waren es 47,2 fps, was nahezu dem Wert von ohne Vsync entspricht.

Hier wurden also zwei Fliegen mit einer Klappe geschlagen – eine hervorragende Arbeit seitens nVidia, noch dazu wo dieses Feature mit den letzten 301er Treibern [52] auch für frühere nVidia-Grafikkarten zur Verfügung steht. Normalerweise müssten die AMD-Treiberingenieure derzeit Überstunden ohne Ende abreißen, bis AMD etwas ähnliches präsentieren kann. Natürlich ist es subjektiv, ob man dieses Feature schätzt oder nicht (womit das Thema der nächsten Umfrage gefunden wäre) – aber wenn man dieses Feature als nutzvoll anerkennt, dann ist dies ein heftiger Pluspunkt zugunsten von nVidia in der ewigen Streitfrage AMD vs. nVidia. An diesem Punkt kann der eiserne AMD-User sogar wirklich ins Grübeln geraten – um so dringender sollte sich AMD diesem Thema widmen.

Nachtrag vom 21. April 2012

Die vorstehende Meldung hat einen entscheidenden Fehler – sie geht nicht auf TripleBuffering ein. Mittels TripleBuffering geht man das Problem der springenden bzw. niedrigeren Frameraten unter aktiven Vsync ebenfalls an, einziger Nachteil ist ein zusätzlicher Inputlag, da die Grafikkarte nun schließlich immer ein weiteres fertiges Bild vorhalten muß, ehe dies am Monitor ausgegeben wird. Bisher war TripleBuffering allerdings immer nur eine Behelfsmöglichkeit, da es die wenigsten Spiele direkt unterstützen. nVidia hat dies allerdings schon vor einiger Zeit geändert und forciert nunmehr mittels des Treibers automatisch TripleBuffering. Dies funktioniert zwar nicht unter jedem Spiel, allerdings kann man bei den Problemfällen diese Funktionalität über diverse TweakTools dann doch noch aktivieren.

Letztere Möglichkeit funktioniert im übrigen auch für die AMD-User, selbst wenn der AMD-Treiber von Haus aus keine Forcierung von TripleBuffering unter DirectX zuläßt. Insofern ist die Diskussion zu dieser Meldung [53] mehrheitlich auf dem Standpunkt, daß TripleBuffering eine völlig ausreichende bzw. sogar bessere Lösung für diese Problematik darstellt und Adaptive VSync im eigentlichen nicht benötigt werden würde. Allenfalls könnten AMD & nVidia es noch perfekt machen und TripleBuffering ohne jede Problemfälle oder/und notwendige Usereingriffe unter wirklich jedem Spiel erzwingbar machen. So gesehen erscheint Adaptive VSync allerhöchstens als weitere Lösung für ein bestehendes Problem, der Anspruch der alleinigen Problemlösung entfällt allerdings. Abschließend greifen wir das Thema Adaptive VSync oder TripleBuffering auch noch mit einer Umfrage [54] auf.

Nachtrag vom 8. Mai 2012

Im nachgereichten GeForce GTX 680 Testbericht von HT4U [55] (dieser einen Monat nach Launch erschienene Artikel zeigt deutlich auf, wie gut eine Arbeit sein kann, wenn man sich dafür entsprechend Zeit nimmt) gibt es einen wunderbaren Abschnitt über das GPU-Boost-Feature der Kepler-Grafikchips. Dieser Abschnitt zeigt erst einmal auf, daß GPU-Boost ganz klar als Leistungsaufnahme-Limiter operiert und daß nVidia das "Power Target" bei der GeForce GTX 680 offensichtlich auf 170 Watt festgesetzt hat. Alle Boost-Taktraten und die dafür anliegenden Spannungen orientieren sich immer daran, jene 170 Watt nicht zu überschreiten. Gleichfalls versucht GPU Boost aber auch, durch automatisches Hochtakten jene 170 Watt zu erreichen, die GeForce GTX 680 läuft im Spieleeinsatz also durchgehend mit 170 Watt Verbrauch.

Für Benchmarks bringt GPU Boost allerdings neue Probleme mit sich – und damit ist nicht der Punkt gemeint, daß verschiedene Grafikkarten andere praktische Boost-Eigenschaften je nach Produktionsklasse des jeweils verbauten Grafikchips aufweisen können, was aber natürlich auch der Fall ist. Das eigentliche Benchmark-Problem ergibt sich aus dem Umstand, daß GPU-Boost auf die anliegenden Chiptemperaturen reagiert und daß damit der Taktraten-Boost nach längerem Gaming geringer ausfällt als direkt nach dem Start eines Spiels, wo der Grafikchip noch unbelastet und daher nicht auf Temperatur ist. Gebenchmarkt wird aber üblicherweise direkt nach dem Start eines Spiels – im eigentlichen reicht oftmals allein der (üblicherweise wenig belastende) Ladebildschirm aus, um den Grafikchip wieder herunterzukühlen und damit nachfolgend kurzfristig höhere Boost-Taktraten zu ermöglichen. HT4U haben diesen Punkt in einer einfachen Gegenüberstellung der Boost-Taktraten zum einen in den ersten 10 Sekunden eines Spiels und zum anderen nach ca. 3 Minuten Gaming aufgezeigt:

| Boost in den ersten 10 Sekunden | Boost nach zirka 3 Minuten | |

|---|---|---|

| EVGA GeForce GTX 680 | Ø 1098,4 MHz (+9,2%) | Ø 1073,4 MHz (+6,7%) |

| Zotac GeForce GTX 680 | Ø 1083,1 MHz (+7,7%) | Ø 1060,4 MHz (+5,4%) |

Wie bei beiden getesteten Herstellerkarten zu sehen, ist die real anliegende Taktrate im echten Spieleinsatz um 2,1 bis 2,3 Prozent höher als zu diesem Zeitpunkt, wo üblicherweise ein Benchmark abläuft. Dies bedeutet natürlich noch nicht direkt eine Verfälschung von Benchmark-Ergebnissen in dieser Höhe: Dies hängt dann maßgeblich davon ab, wie lange und wie fordernd ein Benchmark ist. Bringt ein Benchmark den Grafikchip möglichst umgehend auf Touren und läuft der Benchmark danach noch verhältnismäßig lange, kann der Effekt dann weitaus niedriger ausfallen. HT4U haben dies nachfolgend zu simulieren versucht und einfach die Benchmarks immer erst etwas später gestartet, sich das Spiel also vorher etwas "aufheizen" lassen. In der Summe aller Messungen mit Anti-Aliasing kam dabei eine Differenz von 0,9 Prozentpunkten heraus – viele Benchmarks reagierten dabei gar nicht, bei Reaktion lagen die normalen Differenzen im Rahmen von 1 bis 3 Prozent, mit einem Peak von immerhin 5,8 Prozent (Skyrim 2560x1440 8xAA).

Angesichts dieser geringen Differenz steht natürlich die Frage im Raum, ob man GPU-Boost wirklich als "Benchmark-Verfälschung" ansehen kann. Andererseits handelt es sich so oder so bei diesen 0,9 Prozent um eine Performance, welche im Spieleeinsatz nicht vorhanden ist – sondern eben nur unter Benchmarks und nur bei der GeForce GTX 680. Insofern ist dies egal der Höhe der Differenz immer eine gewisse Verfälschung – so daß man einen Prozentpunkt Performance bei der GeForce GTX 680 und zukünftig weiteren Kepler-basierten Grafikkarten immer herausrechnen sollte. Mittels einer Zunahme des Boost-Faktors beispielsweise bei der GeForce GTX 670 [56] kann der Effekt zukünftig sogar größer ausfallen als eben nur auf einem Prozentpunkt. Mit der Differenz verschiedener GeForce GTX 680 Karten unter GPU Boost (die von HT4U getesteten Karten von EVGA und Zotac weichen wegen des unterschiedlich wirkenden GPU Boosts um 0,7% Endperformance voneinander ab) hat dies im übrigen nichts zu tun – dieser Effekt macht vergleichende Benchmarks zwar schwieriger, zeigt aber weiterhin ein Ergebnis auf, welches der Spielepraxis entspricht.

Allerdings muß angesichts dieser Erkenntnisse auch die Frage aufgestellt werden, ob AMDs PowerTune nicht vielleicht einen ganz ähnlichen Effekt aufweisen könnte. Denn auch PowerTune regelt schließlich den Grafikchip herunter, wenn gewisse Grenzwerte erreicht sind – und daß solche Grenzwerte unter der Dauerbelastung eines Spiels eher ereicht werden als kurz nach dem Ladebildschirm, trifft schließlich universal zu. Der bei nVidia zu beobachtende Effekt kann daher prinzipiell gesehen auch bei AMD auftreten, dies müsste man durch gleichartige Messungen (Benchmark nicht sofort starten, sondern sich das Spiel erst einmal "aufheizen" lassen) belegen oder eben wiederlegen. Ganz generell betrachtet macht es wohl Sinn, sich für zukünftige Grafikkarten-Tests eine Strategie zur optimalen Aufheizung der Grafikkarten vor dem eigenen Benchmark-Beginn zurecht zu legen: Ob mittels späteren Benchmark-Starts oder eines vor dem Benchmark laufenden zusätzlichen Belastungstests. Die Benchmark-Welt wird sich jedenfalls dem Fakt stellen müssen, daß zukünftig gerade kurze Benchmarks direkt nach Idle-Phasen eine gewisse Benchmark-Verfälschung mit sich bringen können und erst ein richtig aufgeheizter Grafikchip seine exakte Performance offenbart.