Hauptlinks

Suche

News des 15./16. Oktober 2011

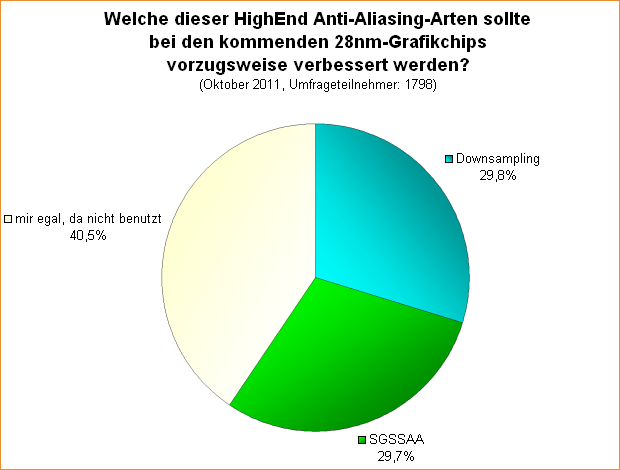

Die Umfrage der letzten Woche fragte nach, welche HighEnd Anti-Aliasing-Art die Grafikchip-Entwickler bei der nächsten Grafikkarten-Generation bevorzugt verbessern sollen: Downsampling oder Sparsed Grid Super-Sampling Anti-Aliasing (SGSSAA). Beide Varianten haben dabei ihr Für und Wider: SGSSAA bringt (aufgrund des sparsed grid) die besseren Kantenglättungs-Ergebnisse und kann im Zweifelsfall sogar performanter sein (wenn per Treiber oder Spiel ausreichend optimiert wird). Dafür funktioniert SGSSAA nicht überall mit jeder Engine bzw. jeder Renderingart reibungslos, sondern benötigt dauernden Support seitens der Grafikchip-Entwickler. Downsampling kann dagegen mit jedem Spiel ohne Probleme funktionieren, wenn es denn einmal im Treiber sauber eingebunden werden würde. Aufgrund dieser Vor- und Nachteile auf beiden Seiten kam wohl auch der faktische Gleichstand des Interesses heraus: Downsampling und SGSSAA erhielten die nahezu gleiche Anzahl an Stimmen – womit an die Grafikchip-Entwickler keine klare Empfehlung ausgesprochen werden kann, welche dieser Anti-Aliasing-Arten bevorzugt verbessert werden sollte.

Daß aber gut 60 Prozent der Umfrage-Teilnehmer sich für eine der beiden Verbesserung aussprachen, ist als klarer Hinweis zu verstehen, daß die Grafikchip-Entwickler dem Thema generell mehr Aufwerksamkeit widmen sollten. Sicherlich benutzen – wegen der hohen für Downsampling bzw. SGSSAA üblicherweise benötigten Performancereserven – derzeit fast nur Enthusiasten solche Features, andererseits könnten diese über eine bessere Einbindung in die jeweiligen Grafikkarten-Treiber auch für einen gewissen Teil des Mainstream-Markts interessant werden, beispielsweise zur Aufhübschung älterer Spiele. Gerade da die kommende Grafikkarten-Generation kaum den großen technologischen Schub bringen wird, weil keine neue DirectX-Schnittstelle ansteht, sollte der Ausbau solcher "Nebenfeatures" interessant und machbar sein.

Im HighEnd-Bereich kann es schließlich durchaus passieren, daß der Sieger in der nächsten Grafikkarten-Generation nicht über die pure Performance entschieden wird (weil 5% mehr Framerate bei sowieso superschneller Performance keine echte Relevanz mehr hat), sondern gerade eben über solche zusätzlichen Möglichkeiten bei den höherwertigeren Anti-Aliasing-Arten. Schon bei unserem letzten Grafikkarten-Test zur aktuellen Grafikkarten-Generation wurde das Endergebnis maßgeblich dadurch beeinflußt, daß nVidia derzeit die besseren Möglichkeiten bietet, seine Grafikkarten an die maximal mögliche Bildqualität (bei spielbaren Frameraten) heranzutreiben – obwohl die reine Rohperformance bei diesem Test von Radeon HD 6970 gegen GeForce GTX 570 eher auf der Seite der AMD-Karte lag. Zukünftig wird der Einfluß solcher Nebenfeatures vermutlich noch stärker ausfallen, da dem hohen von der nächsten Grafikkarten-Generation erwarteten Performancespring derzeit keine gleichwertig höheren Performanceanforderungen seitens der Computerspiele gegenüberstehen.

Ein Ex-Ingenieur von AMD hat laut den X-bit Labs eine mögliche Erklärung für die ziemlich große Die-Fläche von AMDs Bulldozer, zumindest gemessen an dessen Performance, anzubieten: Danach hat AMD beim Bulldozer-Design wohl zu sehr auf automatische Designtools vertraut sowie zu wenig manuelles Feintuning vorgenommen und schleppt nun haufenweise unnützer Transistoren mit sich herum – die das Verlustleistungsbudget belasten und daher die maximale Taktbarkeit beschränken. Eine Abspeckung durch ein manuell nachgebessertes Chipdesign könnte also nicht nur die Die-Fläche um gut 20 Prozent verkleinern, sondern damit natürlich auch die Verlustleistung von Bulldozer herunterbringen und damit höhere Taktraten – welche das Design selber absolut erbringen kann – zu einer verträglichen Verlustleistung möglich machen, sprich die ursprüngliche Bulldozer-Idee der sehr hohen Taktraten letztlich doch realisieren. Ob AMD einen solchen Weg gehen wird, ist aber ungewiß, daß die Entscheidung pro der Designtools sicherlich nicht von einem auf den anderen Tag geändert werden wird.

Bulldozer-Shortcuts: Daß das Problem von Bulldozer in der durch die Decke gehenden Leistungsaufnahme bei hohen Taktfrequenzen liegt, zeigen auch entsprechende Messungen von HT4U auf: Ein auf 4.4 GHz laufender FX-8150 verbraucht bei gerade einmal 22% mehr nominaler Taktrate und gut 10% echtem Performancezuwachs gleich dicke 193 Watt nur für die CPU und den Mainboard-Wandler – dies sind 41 Prozent mehr als im unübertakteten Zustand (137 Watt). Hier liegt der maßgebliche Grund, wieso AMD nicht vom Start weg mit Bulldozer-CPUs mit 4 GHz und mehr angekommen ist – nicht, weil das Bulldozer-Design dies nicht jetzt schon erreichen könnte, sondern weil die auf diesen Taktfrequenzen erzielte Verlustleistung in keine übliche TDP-Klasse mehr hereinpasst, nicht einmal in die früher seitens AMD teilweise benutzte 140-Watt-Klasse. Auf das nun sicher kommende B3-Stepping sollte man diesbezüglich allerdings nicht setzen, denn AMD hat hier einen sehr großen Rückstand, welcher sicherlich nicht nur innerhalb eines Steppings aufzuholen sein wird – und wenn der vorgenannte Ex-Ingenieur von AMD Recht hat, liegt der ursächliche Fehler sogar im Chipdesign und weniger in der Produktionsreife.

Die PC Games Hardware berichtet zudem von Gerüchten, AMD wolle zukünftig auch Bulldozer-Prozessoren bei TSMC fertigen lassen. Prinzipiell ist dies möglich, da GlobalFoundries derzeit keine ausreichenden 32nm-Kapazitäten liefern kann und TSMC in jedem Fall auch schneller mit der kleineren 28nm-Fertigung zur Hand wäre. Allerdings ist mit dieser Meldung nicht gesagt, um welche Bulldozer-basierten Produkte es sich handelt – es könnte sich um Bulldozer-Ableger wie Trinity handeln oder auch um erst in der Zukunft antretende Bulldozer-Nachfolger. Die Neuauflage von Bulldozer bei einem anderen Fertiger würde sowieso Monate dauern und damit nicht so schnell etwas an der aktuellen Situation ändern können. Und letztlich berichtet nochmals die PC Games Hardware darüber, daß AMD bei der Optimierung der 2012er Piledriver-Rechenkernen für die Bulldozer-Nachfolger Trinity und Vishera eher auf Desktop-Anforderungen geachtet hat – und nicht wie bei den originalen Bulldozer-Kernen zuerst auf Server-Anforderungen. Ob damit gemeint ist, daß man von den Piledriver-Rechenkernen einen überdurchschnittlichen Leistungsgewinn speziell im Desktop-Einsatz erwarten kann, bliebe allerdings abzuwarten.