Hauptlinks

Suche

News des 5. Mai 2011

Tom's Hardware haben sich die Entwicklung der AMD-Treiber über einen längeren Zeitraum angesehen – leider noch nicht ohne den neuen 11.4er Treiber, aber dafür geht es bei den älteren Treibern immerhin bis ins Jahr 2009 zurück. Innerhalb dieses Zeitrahmen sind seitens AMD (und natürlich auch von nVidia mittels deren Treiber) reichlich Performance-Verbesserungen versprochen worden, welche in der Summe die benutzte Radeon HD 5870 dann doch bemerkbar nach vorn bringen sollten. Die Ergebnisse unter 1680x1050 sowie 1920x1080 sind dabei ziemlich eindeutig: Zwischen den Treiberversionen 10.3 und 9.10 hat es einen größeren Sprung gegeben, danach sind die Performancegewinne allerdings eher mager bei 2-4 Prozent. Die Ergebnisse unter 2560x1600 sind dagegen etwas "verrückt": Hier gab es den großen Sprung zwischen den Treiberversionen 11.1 und 10.8, wobei die früheren Treiber unter dieser Auflösung sogar etwas schneller als jener 10.8er Treiber waren.

| Tom's Hardware | 11.1 vs. 10.8 | 11.1 vs. 10.3 | 11.1 vs. 9.10 |

|---|---|---|---|

| 1680x1050 4x/8xAA | +2,3% (-2,3%) | +3,0% (-2,9%) | +10,7% (-9,7%) |

| 1920x1080 4x/8xAA | +2,8% (-2,7%) | +3,6% (-3,5%) | +10,6% (-9,6%) |

| 2560x1600 4x/8xAA | +14,7% (-12,9%) | +13,6% (-12,0%) | +12,0% (-10,7%) |

In der Summe sind die Treiberverbesserungen bei AMD über diesen langen Zeitraum also in jedem Fall bemerkenswert – aber doch etwas weg von jenen großen Zahlen, welche in den Releasenotizen regelmäßig vollmundig verkündet werden. Die THG-Messungen relativieren sogar die eherne Regel etwas, Grafikkarten-Tests immer zwingend mit gleichen Treiberversionen für alle Testkarten anzutreten bzw. generell auf ältere Treiber zu verzichten – natürlich nur unter der Voraussetzung, daß nicht gerade mit der letzten Treiberversion ein größerer Sprung vollzogen wurde. Über die Zeit betrachtet sind 10 Prozent Zugewinn aber natürlich beachtenswert und könnten theoretisch sogar die Performanceeinordnung einer Grafikkarte verändern. Da aber auch nVidia regelmäßig ähnliche Treiberverbesserungen erzielt, sollte sich im Normalfall auch über die Zeit nichts an der Performanceeinordnung von älteren Grafikkarten ändern – Ausnahmen durch eine sich als besonders zukunftsfreundlich herausstellende Architekur (AMDs Radeon X1900 Serie) bestätigen die Regel.

Bei Radeon3D hat man sich an einem Vergleich der PCI-Express-Anbindungen unter CrossFire versucht. Mittels der verdoppelten Bandbreite von PCI Express 2.0 ist es nicht mehr so elementar für CrossFire oder SLI, unbedingt perfekt mit zweimal 16 PCI Express Lanes angebunden zu werden – aber dennoch könnte man doch einen gewissen Performance-Unterschied zwischen x8 und x16 auch unter PCI Express 2.0 erwarten. Radeon3D konnten dies allerdings nicht herausfinden, denn das PCI-Express-Interface in Intels bisherigen Sandy-Bridge-Prozessoren stellt Grafikkarten nun einmal nur insgesamt 16 PCI Express Lanes zur Verfügung – ob man diese also auf einem P67-Mainboard mittels eines NF200-Chips von nVidia zu zwei angeblich vollwertigen x16-Anbindungen "aufwertet", bleibt am Ende gleich, weil das limitierende Teil weiterhin das integrierte PCI-Express-Interface der CPU selber ist.

Allerdings lies sich mittels dieses Tests dann doch ein interessanter Punkt aufzeigen: nVidias NF200-Chip auf P67-Mainboards bringt keine Leistung, sondern kostet sogar welche: Die Differenz ist mit 3-4 Prozent zwar nicht weltbewegend – aber dafür, daß der NF200-Chip ja eigentlich nur zur Performancesteigerung auf den Mainboards ist (und dieses auch teurer macht), ist es dann doch wieder beachtenswert. Laut dem Test von Radeon3D muß man ergo einen Bogen um Mainboards mit NF200-Chip machen und lieber der originalen x8/x8-Aufteilung des PCI-Express-Interfaces des P67-Chipsatzes vertrauen. Und selbst wenn dies nur ein Einzelfall sein sollte oder der NF200-Chip mit SLI eventuell besser funktionieren sollte als mit CrossFire – wirklich zaubern kann auch der NF200-Chip nicht, wenn das PCI-Express-Interface der CPU eben nur insgesamt 16 PCI Express Lanes für die Grafikkarte zur Verfügung stellt.

Wer seine zwei Grafikkarten unter SLI/CrossFire nicht nur virtuell mit jeweils 16 PCI Express Lanes versorgen will, wird dies nur mit anderen Prozessoren und demzufolge anderen PCI-Express-Interfaces realisieren können: Sowohl bei den HighEnd-Nehalems der X58-Plattform als auch allen AMD-Prozessoren mit dem passenden Mainboard-Chipsatz (890FX) ist dies realisierbar. Ob dieser Punkt der besseren PCI-Express-Anbindung wirklich etwas bringt, ist dagegen weitgehend vakant – und könnte wenn dann nur auf den entsprechenden Plattformen ausgetestet werden. Wie gesagt ist dieses Problem mittels PCI Express 2.0 deutlich kleiner geworden und auch mit PCI Express 1.x war eine x8/x8-Anbindung unter SLI/CrossFire zwar nicht optimal, aber keinesfalls ein echter Leistungsfresser. Voraussichtlich mittels PCI Express 3.0 (ab Sandy Bridge E und Ivy Bridge) dürfte sich diese Problematik weiter entschärfen und auch geteilte x8/x8-Anbindungen unter SLI/CrossFire dann keines größeren Nachdenkens mehr würdig sein.

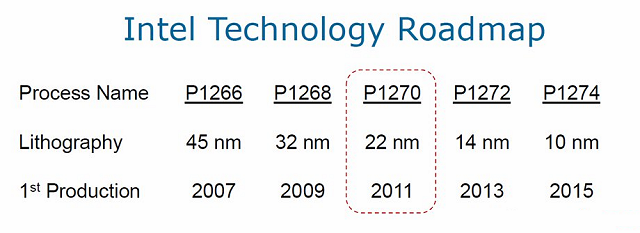

Intel hat im Rahmen der Vorstellung seiner dreidimensionalen Transistoren ("3-D Tri-Gate Transistors") auch über die mittelfristige Intel Technologie-Roadmap gesprochen, welche derzeit nach dem 22nm-Prozeß (Massenfertigung ab Ende 2011) aller zwei Jahre einen weiteren Fertigungsschritt vorsieht: 14nm im Jahr 2013 und 10nm im Jahr 2015 (Auslieferungstermin dürfte jeweils ein Jahr später sein, also 14nm im Jahr 2014 und 10nm im Jahr 2016). Am 14nm-Prozeß wird in zwei Intel-Werken (Hillsboro & Chandler) sogar schon gearbeitet bzw. diese Produktionsstätten dann auf diese Fertigung umgerüstet. Da Intel mittels seiner dreidimensionalen Transistoren ein bedeutender Schritt in der Halbleiterfertigung gelungen ist und dieser Fortschritt Intel die automatisch auftauchenden Probleme bei immer kleineren Strukturen für eine Zeit vom Hals hält, dürfte die 14nm-Fertigung sicher erreichbar sein – und womöglich auch noch die 10nm-Fertigung ohne größere Probleme. Für Fertigungsschritte unterhalb der 10nm-Fertigung hatten Halbleiter-Korophäen dagegen schon vor einiger Zeit prophezeit, daß man dafür wieder eine bedeutende technologische Umwälzung benötigen würde.

Zu jenen dreidimensionale Transistoren wäre noch nachzutragen, daß derart gebaute Prozessoren der 22nm-Generation laut Intel um bis zu 37% schneller schalten können sollen als Prozessoren der bisherigen 32nm-Generation, sprich also Ivy Bridge ein bis zu 37 Prozent höheres Taktpotential aufweist. Da die Sandy-Bridge-Prozessoren im Übertaktbetrieb bestenfalls 4.5 bis 5.0 GHz erreichen und ca. 4.3 GHz eine ziemliche sichere Übertaktung darstellt, geht das Taktpotential mit Ivy Bridge somit bestenfalls auf nahezu 7 GHz (!) hinauf und runde 5.5 GHz sollten demzufolge mit jedem Ivy-Bridge-Prozessor problemlos erreichbar sein. Natürlich wird Intel dieses Taktpotential nicht im Ansatz für reguläre Taktraten ausnutzen – doch daran wird wohl endgültig deutlicher, weshalb Intel die harten Übertaktungs-Beschränkungen bei Sandy Bridge eingeführt hat: Wenn jeder 100-Dollar-Prozessor der Ivy-Bridge-Generation auf 5 GHz und mehr Takt übertaktbar wäre, würde wir alle nächstes Jahr diese Prozessoren kaufen und dann für drei bis fünf Jahre (oder gar länger) keinerlei Aufrüstbedarf mehr haben.

Hier hat Intel schlicht eine Lehre aus den exzellenten Übertaktungsergebnissen der Core-2-Generation gezogen: Kann man in der Breite der Angebotspalette so derart gut übertakten, dann verschiebt sich der Aufrüstdruck sehr weit nach hinten, was für Intel als wirtschaftlich denkendes Unternehmen in einem Markt ohne ernsthaften Druck durch die Wettbewerber natürlich nicht die beste Vorgehensweise darstellt. Deswegen gibt es freie Übertaktungen ab Sandy Bridge nur noch für einige Spitzenmodelle, da jene (bezogen auf den gesamten Prozessoren-Absatz) in viel zu geringen Stückzahlen verkauft werden, als daß dies größere Auswirkungen auf zukünftige Geschäfte haben würde. Daraus läßt sich auch ableiten, daß es K-Modelle bei Intel zukünftig kaum für kleinere Prozessoren geben wird, weil jene dann sofort zu extremen Rennern werden würden. All dies funktioniert natürlich nur deshalb, weil AMD in letzter Zeit Intel nicht wirklich unter Druck setzen konnte – demzufolge ist es selbst aus Sicht des getreuesten Intel-Käufers immer gut, wenn AMD mit Bulldozer etwas potentes auf die Beine stellt.