Hauptlinks

Suche

News des 27. Juli 2011

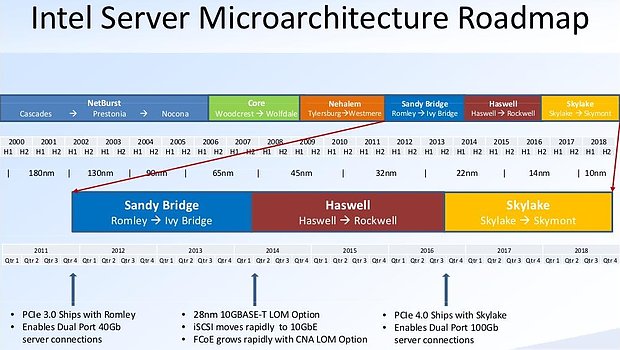

In Fernost ist eine Intel Server Microarchitecture Roadmap für den langen Zeitraum der Jahre 2000 bis 2018 aufgetaucht, welche Auskunft über die kommenden Intel Prozessoren-Architekturen über Ivy Bridge und Haswell hinaus gibt. Dabei behält Intel sein Tick-Tock-Schema bei: Es wechseln sich neue Architekturen in der gleichen Fertigungstechnologie mit Refresh-Generationen in einer jeweils kleineren Fertigungstechnologie ab. Während Ivy Bridge also die Refresh-Generation zu Sandy Bridge in der 22nm-Fertigung darstellt, wird Haswell eine neue Architektur in 22nm und Rockwell dessen Refresh in 14nm. Skylake wird dagegen wieder eine neue Architektur in 14nm und Skymont dessen Refresh in 10nm. Interessant ist, daß Intel bei dieser Roadmap zwischen den neuen Fertigungsschritten einen Zeitraum von nunmehr zweieinhalb Jahren einzeichnet – und nicht mehr exakt zwei Jahre, wie ursprünglich bei der Vorstellung des Tick-Tock-Schemas geplant.

Dies zeigt an, daß selbst Intel in Zukunft nicht mehr die schnellen Fortschritte in der Halbleiter-Fertigung vergangener Tage mitgehen kann. Für die nach der 10nm-Fertigung liegende Zukunft (ca. das Jahr 2020) ist von einer noch weiteren Verlangsamung der Entwicklung auszugehen, dann könnte es durchaus drei Jahre und mehr dauern, ehe neue Fertigungsverfahren zur Verfügung stehen. Die Entwicklung der Halbleiterfertigung wird zwar kaum stehenbleiben und auch heute als schwierig zu überwinden anzusehende technologische Barrieren dürften mit der Zeit fallen (oder umgangen werden) – aber all dies wird mittel- und langfristig mehr Zeit kosten als bisher üblich und daher die Innovationszyklen in der Halbleiterbranche auseinanderziehen. Daneben sei zu dieser klar Server-bezogenen Roadmap noch zu erwähnt, daß die angegebenen Releasetermine nicht auf entsprechende Desktop-Produkte umlegbar sind, da die Server-Produkte üblicherweise erst einige Monate später in den Markt entlassen werden.

Von Intel kommt ein Artikel samt White Paper, welche CPU-seitiges Morphological Anti-Aliasing (MLAA) beschreibt. Die angewandte Methode ist dabei dieselbe wie bei AMDs schon existierendem MLAA und nVidias zukünftigem FXAA: Das Bild bekommt faktisch einen Weichzeichner, wobei dieser – je nachdem wie gut die Erkennung ist – nur auf Kanten und nicht auf Texturen anzuwenden versucht wird. In der Folge dessen kann es zu einem Glättungseffekt und dem teilweisen Verlust von Texturenschärfe kommen. Manche Kanten werden aber fehlerhafterweise nicht erkannt und manche Kanten sind mit diesem Verfahren auch nicht erkennbar, der reine Anti-Aliasing-Effekt ist also immer nur zweitklassig. Dafür funktioniert das Verfahren in faktisch jedem Spiel und unter jeder Render-Engine, was heutzutage durchaus einen Pluspunkt darstellt. Trotzdem ist das Verfahren letztlich ungeliebt, weil nicht zu Unrecht als "Weichzeichner" verschrieen und von der Optik her kein Fortschritt, sondern ein klarer Rückschritt.

Intel hat sich nun schlicht eine Lösung dafür ausgedacht, MLAA auch auf CPUs ausführen zu können – wobei man hier auf Vielkern-Prozessoren spekuliert, deren viele Rechenkerne unter Spielen häufig nicht ausgenutzt werden und welche man mittels CPU-seitigem MLAA auslasten könnte. Dafür rechnet man sogar vor, daß oberhalb von 4x Multisampling Anti-Aliasing das MLAA-Verfahren dann sogar effizienter sein soll – technisch vielleicht richtig, aber wer eine höhere Bildqualität als 4x Multisampling Anti-Aliasing wünscht, wird sicherlich nicht auf MLAA zurückschalten, wenn gleichzeitig auch 8x Multisampling Anti-Aliasing möglich wäre. Interessant ist CPU-seitiges MLAA eher als Spar-Anti-Aliasing zur Unterstützung der integrierten Intel-Grafikbeschleuniger, welche sich dann nicht mit dem sie überfordernden Multisampling Anti-Aliasing herumplagen müssen. Natürlich kann man sich auf dieser Ebene dann nicht mehr mit ausgewachsenen Grafikkarten vergleichen, aber dafür ist die Performance selbst der Sandy-Bridge-Grafiklösung sowieso zu schwach – und die vergleichbaren LowCost-Grafikkarten von AMD und nVidia haben wiederum genauso wenig die Performancereserven für Multisampling Anti-Aliasing.

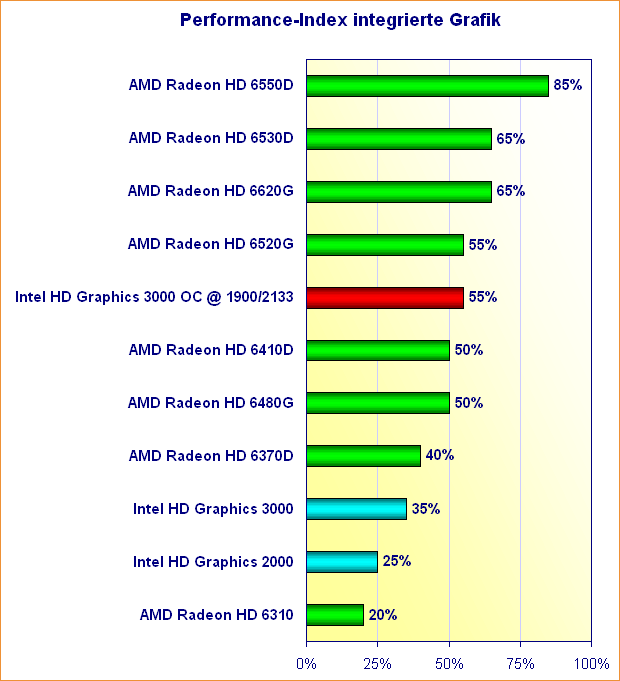

Bei Hartware hatte man den A6-3650 Llano-Prozessor im Test und hat dabei dankenswerterweise erstmals die GPU-Performance der kleineren Radeon HD 6530D Grafiklösung ausgemessen. Deren Performance konnte bislang nur auf Basis der bekannten Rohleistungen geschätzt werden, die letzte Schätzung belief sich dabei auf ca. 30 Prozent Performancevorteil zugunsten der zumeist getesteten Radeon HD 6550D des A8-3850 Llano-Prozessors. In den Benchmarks seitens Hartware kam eine Differenz von 25,8 Prozent unter einer Auflösung von allerdings nur 1280x1024 heraus – bei einer höheren Auflösung könnte die Differenz größer ausfallen, so daß die vorherige Schätzung durchaus wieder erfüllt werden könnte. Sicherlich kann man aber sagen, daß zwischen Radeon HD 6530D und 6550D gut 25-30 Prozent Performance-Differenz liegen, was auf dem nun nicht überragenden Performance-Niveau dieser integrierten Llano-Grafiklösungen durchaus einen sehr beachtbaren Unterschied ausmacht.

Wichtig ist auch zu realisieren, wie weit dann die integrierten Grafiklösungen der anderen Llano-Prozessoren zurückliegen: Gegenüber einer Radeon HD 6410D ist die Radeon HD 6550D dann schon um ca. 70% schneller, gegenüber einer Radeon HD 6370D dann um mehr als 110%. Integrierte Llano-Grafik ist also bei weitem nicht gleich integrierte Llano-Grafik und AMD deckt hier mit nur einer einzelnen Grafikeinheit eine wirklich sehr breite Leistungsspanne ab. Im Desktop-Bereich sind zum Glück nur die eher uninteressanten Llano-Zweikerner mit den schwächeren Grafiklösungen gekoppelt, im Mobile-Bereich sieht dies aber anders aus – hier wäre durchaus der eine oder andere Zweikerner noch gangbar, fällt aber wegen der verbauten schwachen Grafiklösung heraus. Da zudem die beste mobile Grafiklösung auch nur die Performance der zweitbesten Desktop-Grafiklösung bietet, lautet unsere Empfehlung im Mobile-Bereich, nichts unterhalb des A8-3500M mit Radeon HD 6620G zu nehmen – ansonsten verliert man zu viel des Schwungs der eigentlich gutklassigen Llano-Grafiklösung.