Hauptlinks

Suchen

News des 9. April 2010

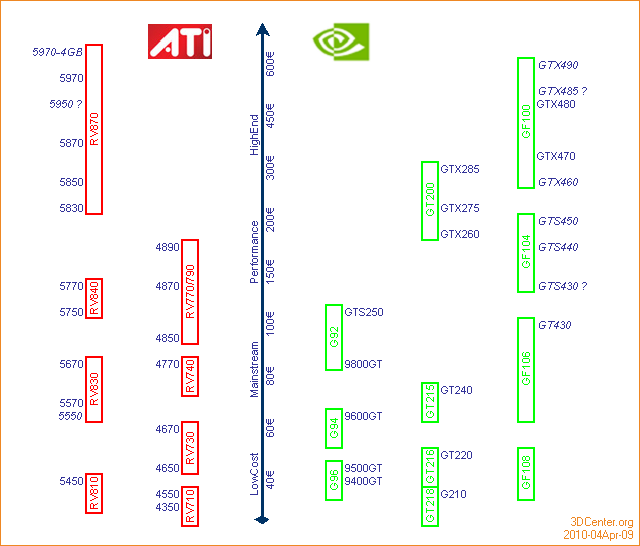

Laut Expreview soll basierend auf dem GF100-Chip von nVidia noch eine dritte SingleChip-Grafiklösung erscheinen, die GeForce GTX 460. Die technischen Daten zu dieser Karte sind bislang weitgehend unklar, einzig allein das 256 Bit DDR Speicherinterface samt 1024 MB Grafikkartenspeicher und die preisliche Konkurrenz zur Radeon HD 5850 sind bekannt. Letzteres scheint wohl der Grund für diese GeForce GTX 460 zu sein: nVidia hat derzeit kein preisliches Äquivalent zur Radeon HD 5850, weil GeForce GTX 470 & 480 von Performance und Preis her klar höher angesetzt sind. Damit ist die Radeon HD 5850 diese Karte, welche nVidia im HighEnd-Segment derzeit am meisten Ärger bereiten dürften – sie hat (für das HighEnd-Segment) ein ziemlich gutes Preis/Leistungsverhältnis und nVidia hat kein DirectX11-Gegenangebot dafür. Eine Ausweichmöglichkeit wären zwar die Grafikkarten auf Basis des kommenden GF104-Chips, allerdings sieht es eher so aus, als würde dieser Chip selbst in seiner besten Version nicht das Performance-Niveau einer Radeon HD 5850 erreichen können.

Aus diesem Grund könnte nVidia sich nunmehr zu einer GeForce GTX 460 als Konterpart zur Radeon HD 5850 entschlossen haben. Der GF100-Chip ist zwar eigentlich nicht für dieses Preissegment vorgesehen, aber mit einigen Abspeckungen ist da sicherlich etwas zu machen. Vornehmlichste Aufgabe dürfte dabei sein, die Fertigungskosten so niedrig wie möglich zu halten, um trotz der hohen Produktionskosten für den GF100-Chip den Preisbereich der Radeon HD 5850 erreichen zu können. Dazu passt zum einen das nur 256 Bit DDR breite Speicherinterface (abgespeckt vom ursprünglich 384 Bit DDR breiten Interface des GF100-Chips), weil damit die Speichermenge auf 1024 MB sinkt, was weniger Kosten für den Speicher und für das Platinenlayout bedeutet. Und zum anderen gibt es wohl kein Referenzdesign der GeForce GTX 260 – die einzelnen Grafikkartenhersteller sollen hier selber tätig werden, was diesen bessere Möglichkeiten gibt, Einsparpotentiale zu erkennen und dann auch zu realisieren.

Zur Anzahl der bei der GeForce GTX 460 noch freigeschalteten GF100-Recheneinheiten gibt es derzeit keinerlei Informationen – allerdings kann man davon ausgehen, daß es klar mehr als 256 Shader-Einheiten werden dürften, denn mit 256 Shader-Einheiten an einem 256 Bit DDR breiten Speicherinterface (= GF104-Chip) kann man selbst auf hohen Taktfrequenzen das Performanceniveau der Radeon HD 5850 nicht erreichen. Eingedenk der eher gemächlichen Taktfrequenzen des GF100-Chips sind vielleicht 400 Shader-Einheiten auf Taktraten ähnlich der GeForce GTX 470 vonnöten, um die Radeon HD 5850 in Schach zu halten – ergo könnte eine GeForce GTX 460 mit 384 oder 416 Shader-Einheiten antreten, je nach Taktrate. Voraussichtlich wird nVidia versuchen, ziemlich exakt das Leistungsniveau und den Preispunkt der Radeon HD 5850 zu treffen – nicht, um hier ein wesentliches besseres Angebot als die Radeon HD 5850 auf die Beine zu stellen (dafür sind die Möglichkeiten des GF100-Chips angesichts dessen Die-Größe und der Produktionskosten zu limitiert), sondern einfach um ein konkurrenzfähiges Gegenangebot im selben Preisbereich zu haben.

Die Verlustleistung einer solchen GeForce GTX 460 sollte dann im übrigen ebenfalls humaner werden, schätzungsweise dürfte es dann wenigstens mit dieser Karte unterhalb von 150 Watt Spieleverbrauch gehen. Zudem dürfte ein derart stark abgespeckter GF100-Chip auch die Produktionsausbeute bei TSMC hochhalten – nicht gerade unwichtig angesichts der Größe des GF100-Chips und der damit verbundenen Probleme in der Chipfertigung. Insofern scheinen die wenigen vorliegenden Informationen zur GeForce GTX 460 sehr gut Sinn zu machen – die Karte erscheint realisierbar und würde nVidia in jedem Fall nutzen. Einziges Problem könnte wieder einmal die Lieferfähigkeit der aktuellen HighEnd-Chips sein – die GeForce GTX 460 soll am 1. Juni vorgestellt werden und es ist nicht klar, ob nVidia bis dahin die GF100-Massenfertigung so weit auf Laufen hat, daß man sowohl die vielen Vorbestellungen an GeForce GTX 470 & 480 Karten abarbeiten konnte, um auch noch eine vernünftige Lieferfähigkeit der GeForce GTX 460 garantieren zu können.

Laut SemiAccurate soll nVidia den Verkaufsstart der GeForce GTX 470 & 480 Karten am 12. April mit nur 8.000 Karten weitweit begehen können und damit das ursprüngliche Ziel einer klaren fünfstelligen Zahl an Auslieferungskarten deutlich verfehlen. Diese "Menge" von 8.000 Karten dürfte natürlich bei weitem nicht ausreichend sein, um den anfänglichen Bedarf zu decken – selbst wenn GeForce GTX 470 & 480 bei den HighEnd-Käufern derzeit nicht so gut ankommen wie von nVidia gedacht. Damit läuft nVidia in dieselbe Falle wie ATI, deren HighEnd-Produkte ebenfalls zum Launch nur in extrem geringen Liefermengen "verfügbar" waren (und es derzeit immer noch sind), womit viel weniger Umsatz gemacht wurde als es möglich gewesen wäre. Für den Grafikkartenkäufer gleich die Liefersituation im HighEnd-Bereich damit bei beiden Grafikchip-Entwicklern eher denn einer Tombola als einem Markt.

Ungemach drohnt scheinbar auch den Einzelhändlern, welche sich am GeForce GTX 470 & 480 Verkaufsstart beteiligen wollen: Wie der österreicher Händler Hi-Tech in seinem Blog ausführt, stellen die Grafikkartenhersteller aufgrund einer Vorgabe von nVidia drastische Bedingungen für den Erwerb von GeForce GTX 470 & 480 Karten. So müssen für eine GeForce GTX 470 Karte auch noch 10 andere nVidia-Grafikkarten erworben werden, für eine GeForce GTX 480 Karte sogar 20 andere nVidia-Karten (Anmerkung: entsprechende Gerüchte gab es schon länger, aber hier steht es nun schwarz auf weiß). Nun sind Bundlegeschäfte nichts wirklich neues auf dem Weg der Produkte von den Herstellern zum Einzelhandel, allerdings liegt hierbei der Vorteil doch klar auf Seiten von nVidia – die extrem schwache Verfügbarkeit der GeForce GTX 470 & 480 wird ausgenutzt, um den Einzelhändlern eine doch erhebliche Zahl an anderen Produkten aufzuschwatzen.

Bleibt zugunsten der Händler nur zu hoffen, daß die anderen nVidia-Karten auch GeForce G210, GT 220 und GT 240 heißen dürfen – denn diese kann man durchaus noch verkaufen und deren Wertumfang ist auch nicht so hoch. Ein nahezu unmögliches Geschäft für die Einzelhändler wäre es dagegen, wenn man GeForce GTX 260/275/285 Karten bei nVidia abnehmen müsste – erstens einmal haben die einen deutlich höheren Wertumfang und zweitens ist deren Preis/Leistungsverhältnis derzeit einfach nur noch schlecht: Die GeForce GTX 260 kostet mehr als eine Radeon HD 4890, die GeForce GTX 275 kostet soviel wie eine Radeon HD 5830 und die GeForce GTX 285 kostet mehr als eine Radeon HD 5850 – bei jeweils deutlich niedrigerer Performance, vom fehlenden DirectX11 gar nicht zu reden. In jedem Fall macht sich nVidia mit dieser Verkaufsstrategie kaum Freunde unter den Einzelhändlern – und es zeigt nochmals an, wie wenige GeForce GTX 470 & 480 Karten zum Verkaufsstart wirklich zu erwarten sein werden.

AMD hat nun offizielle Informationen zu seiner "TurboCore" genannten automatischen Übertaktungstechnik herausgegeben, welche erst einmal das bestätigen, was zum Ende des März diesbezüglich schon berichtet wurde: Die AMD-Prozessoren mit Thuban-Abstammung übertakten unter TurboCore jeweils die Hälfte ihrer Rechenkerne um 400 bzw. 500 MHz (je nach Prozessormodell). Dabei gibt es im Gegensatz zu Intels TurboMode keine weiteren Abstufungen – allerdings erscheint dies auch nicht zwingend notwendig, denn aus Performancesicht erscheint AMDs TurboCore klar im Vorteil zu sein: Bei Intel erreichen nur die Lynnfield-basierten Modelle Core i5-750, Core i7-860 und Core i7-870 ähnlich gute automatische Übertaktungsergebnisse, bei den restlichen Nehalem-Prozessoren ist der TurboMode dagegen zumeist arg hüftlahm.

| 1 Kern | 2 Kerne | 3 Kerne | 4 Kerne | 5 Kerne | 6 Kerne | |

|---|---|---|---|---|---|---|

| Core i5-6xx | + 266 MHz | + 133 MHz | - | - | - | - |

| Core i5-750 | + 533 MHz | + 533 MHz | + 133 MHz | + 133 MHz | - | - |

| Core i7-860 | + 666 MHz | + 533 MHz | + 133 MHz | + 133 MHz | - | - |

| Core i7-870 | + 666 MHz | + 533 MHz | + 266 MHz | + 266 MHz | - | - |

| Core i7-97x | + 266 MHz | + 266 MHz | + 133 MHz | + 133 MHz | - | - |

| Core i7-980X | + 266 MHz | + 133 MHz | + 133 MHz | + 133 MHz | + 133 MHz | + 133 MHz |

| Phenom II X4 9xxT | + 400 MHz | + 400 MHz | +0 | +0 | - | - |

| Phenom II X6 1035T/1055T/1075T | + 500 MHz | + 500 MHz | + 500 MHz | +0 | +0 | +0 |

| Phenom II X6 1090T | + 400 MHz | + 400 MHz | + 400 MHz | +0 | +0 | +0 |

| Bei Intel sind diese maximalen Übertaktungsergebnisse in der Praxis immer durch die TDP begrenzt: Die CPU wertet den aktuellen Stromverbrauch aus und wird unter Umständen das TurboMode-Ergebnis drosseln, wenn der Stromverbrauch zu hoch ist. Eine solche Einschränkung scheint es bei AMD nicht zu geben. | ||||||

Bezüglich der Limitierung durch die TDP hat AMD zudem nunmehr ausgesagt, daß mittels TurboCore die spezifizierte TDP nicht überschritten wird – ergo gibt es wohl im Gegensatz zu Intel keine Sicherheitsschaltung, welche die automatische Übertaktung bei Überschreitung der TDP-Grenze herunterregelt. Dies kann funktionieren, da bei Aktivierung von AMDs TurboCore ja immer die Hälfte aller Rechenkerne abgeschaltet werden und nicht wie bei Intels TurboMode auch schon mit der vollen Anzahl an Rechenkernen eine automatische Übertaktung versucht wird. Wie gesagt erscheint der TurboCore gerade dann, wenn es um eine gute SingleCore- und DualCore-Performance geht, im Vorteil gegenüber dem TurboMode – was allerdings natürlich noch in der Praxis zu beweisen wäre. AMDs Thuban-basierte Prozessoren sollen Ende April gelauncht werden, dann wird man sich auch ein Bild über das TurboCore-Feature machen können.

Eine mögliche Erklärung, wieso gerade Intel mit dem Support von USB 3.0 so derart zögerlich ist, hat das CNet ausgegraben: Danach würde Intel USB 3.0 durchaus bewußt etwas ausbremsen, um vorher noch die Entwicklungen an der Intel-eigenen Light Peak Technologie abschließen zu können. Light Peak kann USB 3.0 von der Datentransferrate her knapp überflügeln und ist dabei universeller einsatzbar. Regulär sollen erste Light-Peak-Gerätschaften noch 2010 erscheinen – ab wann Intel bei seinen Mainboard-Chipsätzen einen nativen Light-Peak-Support anbieten wird, ist aber noch nicht bekannt. Daß Intel aber selbst bei den zum Jahreswechsel 2010/11 erscheinenden Mainboard-Chipsätzen der 6er Serie immer noch keinen nativen USB 3.0 Support bieten wird, wie Fudzilla berichten, verstärkt den Verdacht, Intel würde der schnellen Verbreitung von USB 3.0 vorsätzlich Steine in den Weg legen.