Hauptlinks

Suche

Hardware- und Nachrichten-Links des 22. Januar 2019

Zur Berichterstattung zu GeForce GTX 1660 & 1660 Ti gilt noch hinzuzufügen, das der zugrundeliegende nVidia TU116-Chip trotz aller vorliegenden Daten zu den genannten Grafikkarten immer noch nicht sicher bestätigt ist. Allerdings wird es mit den kleineren Grafikkarten-Varianten auf TU116-Basis immer unwahrscheinlicher, das nVidia hierfür den großen TU106-Chip von GeForce RTX 2060/2070 weiterbenutzt: Erstens einmal würde die angesetzte Abspeckung bei der GeForce GTX 1660 (non Ti) dann schon wirklich heftig sein, von 36 auf 20 Shader-Cluster heruntergehend, unter dem weiteren Verzicht auf RT- und Tensor-Cores sowie einem Drittel des Speicherinterfaces. Und zweitens erscheint der TU106-Chip mit 445mm² Chipfläche dann doch als zu "dick" für einen Einsatz im Midrange-Segment für Grafikkarten, welche im Preisbereich von grob 250 Dollar stehen, eventuell sogar bis zu 200 Dollar nach unten reichen. Die Turing-Generation hat zwar sicherlich die starke Tendenz von ziemlich dicken Grafikchips, dafür wurden aber auch (bei den größeren Beschleunigern) die Preislagen nach oben gerissen – was im typischen Midrange-Segment dann nicht mehr funktioniert.

| Pascal | Turing | |||

|---|---|---|---|---|

| Enthusiast | GP102 | 471mm², 3840 Shader-Einheiten | TU102 | 754mm², 4608 Shader-Einheiten + RT-Fähigkeit |

| HighEnd I | GP104 | 314mm², 2560 Shader-Einheiten | TU104 | 545mm², 3072 Shader-Einheiten + RT-Fähigkeit |

| HighEnd II | TU106 | 445mm², 2304 Shader-Einheiten + RT-Fähigkeit | ||

| Midrange | GP106 | 200mm² 1280 Shader-Einheiten | TU116 | ~250-300mm², 1536 Shader-Einheiten |

| Mainstream | GP107 | 132mm², 768 Shader-Einheiten | TU117 | ~170-200mm², 896 Shader-Einheiten |

Wirtschaftlicher ist hier sicherlich für nVidia die Auflage eines extra Grafikchips für GeForce GTX 1660 & 1660 Ti – eben der TU116-Chip. Jenen könnte man auf eine Chipfläche von 250-300mm² unterbringen – immer noch viel für einen Midrange-Chip, aber weit weg von den 445mm² des TU106-Chips. Gerade das nVidia in dieser Grafikchip-Generation mit TU104 und TU106 gleich zwei HighEnd-Chips aufgelegt hat, deutet schließlich an, das es sich ab einer gewissen Flächenersparnis lohnt, extra Grafikchips aufzulegen. Anders formuliert: Wenn die 100mm² Differenz zwischen TU104 und TU106 für die Auflage eines extra Grafikchips reichen, dann wird nVidia dies normalerweise beim kolportierten TU116-Chip und dessen Flächenersparnis in Richtung 140-190mm² in jedem Fall tun. Da müssten schon einige unwahrscheinliche Dinge zusammentreffen, auf das diese These wirklich noch wackeln sollte. Da aber letztlich sowieso schon eine noch kleinere Turing-Lösung mit 896 Shader-Einheiten gesichtet wurde (welche somit einen neuen Chip voraussetzt), kann man ziemlich sicher davon ausgehen, das nVidia eben solche weiteren Turing-Chips (in Form von TU116 & TU117) in Vorbereitung hat.

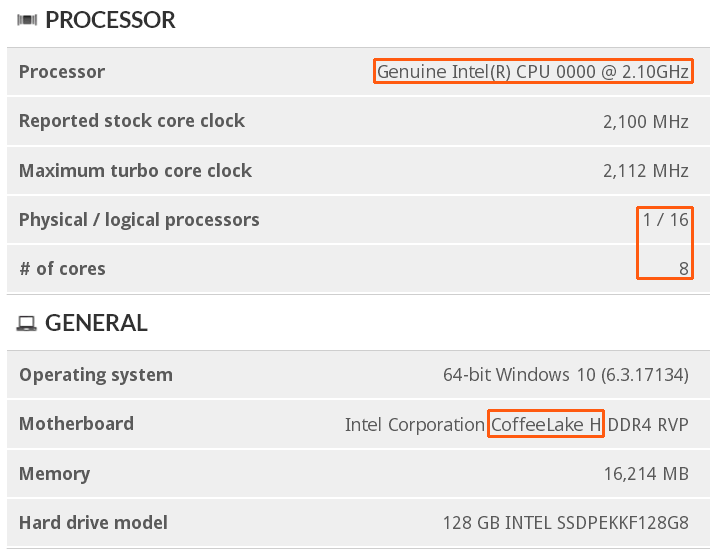

Der gestern genannte Intel Mobile Achtkern-Prozessor ist nicht einmal gänzlich neu, denn schon im letzten Oktober hatte die ComputerBase auf das 3DMark-Resultat eines solchen Systems hingewiesen. Jenem ist dann auch deutlich die Mobile-Abstammung durch Nennung von "Coffee Lake H" zu entnehmen – die "H"-Prozessoren bei Intel haben üblicherweise eine TDP von 45 Watt und sind die schnellsten Mobile-Modelle (wie im aktuellen Mobile-Portfolio von Intel). Augenscheinlich ist ein solcher Mobile Achtkern-Prozessor bei Intel somit schon seit letztem Herbst in Arbeit, insofern wäre es auch wenig verwunderlich, wenn jener nun mit einer kommenden Laptop-Ausführung der GeForce GTX 1660 Ti gepaart werden würde – die Notebook-Hersteller bieten für ihre neuen Modelle gerne die jährlichen Updates der jeweiligen Chip-Hersteller auf. Ironischerweise wäre speziell ein mobiler Achtkerner natürlich eher mit einer GeForce RTX 2080 zu paaren, da angesichts dieses dicken Prozessors der Mobile-Gedanke bei jenem Notebook sowieso in den Hintergrund treten und es sich eher um ein "Desktop Replacement" (DTR) Gerät handeln dürfte.

Genau hierzu passend hat man sich bei Notebookcheck erneut den Fall des MacBook Pro 15 angesehen, wo schon bei den initialen Tests die nominell schnelleren Coffee-Lake-Prozessoren praktisch langsamer ausfielen. Inzwischen hat man es bei Apple augenscheinlich hinbekommen, das die kleineren Core i7 Modelle ihren Dienst anständig tun, gerade aber das größere Core i9 Modell, welches den Notebook-Käufer immerhin 340-480 Euro mehr kostet, ist nach wie vor beachtbar langsamer. Dabei handelt es sich im Vergleich Core i7-8850H gegen Core i9-8950HK beiderseits um Sechskern-Prozessoren, selbst deren Taktraten sind mit 2.2/4.2 GHz gegen 2.9/4.8 GHz nun nicht gänzlich voneinander abweichend. Aber augenscheinlich ist schon der Verbau des kleineren Core i7-8850H grenzwertig – und der gewisse Mehrtakt des Core i9-8950HK läßt das System dann "kippen", wird am Ende mehr gedrosselt als der Turbomodus eingelegt. Notebookcheck führen dies zuerst auf das Kühlsystem des konkreten Apple-Notebooks zurück, welches aber für 50 Watt ausgelegt ist und damit zu diesen Prozessoren der 45-Watt-Klasse durchaus passt.

Nicht beachtet wird an dieser Stelle der limitierende Einfluß der TDP, welche Intel-Prozessoren außerhalb von Retail-Mainboards des Desktop-Segments durchaus beachten – womit also auch ein etwas leistungsfähigeres Kühlsystem nicht weiterhelfen würde. Diese Prozessoren sind mit 45 Watt schlicht bei deren TDP zu grenzwertig angesetzt, zumindest auf den Core i9-8950HK mit sechs CPU-Kernen und seinen Taktraten von 2.9/4.8 GHz zutreffend. Wenn dann später noch ein mobiler Achtkerner kommt, dürfte der Rückfall auf Basetakttraten noch häufiger zu beobachten sein, unter Umständen gibt es (bei Erreichen zu hoher CPU-Temperaturen) sogar eine Drosselung auf noch niedrigere Taktraten. Eigentlich müssten noch leistungsfähigere Mobile-Prozessoren innerhalb der 14nm-Fertigung dann in einer anderen (höheren) TDP-Klasse erscheinen, um wirklich ihre Rohleistung ausspielen zu können. Ob sich Intel allerdings dazu breitschlagen läßt, wäre eher zu bezweifeln: Erstens schränkt dies die zur Verfügung stehenden Notebook-Designs massiv (auf spezielle Übertakter-Geräte) ein, zum anderen sieht ein Hochziehen der TDP im Zweikampf mit AMD medial nicht gut aus.