Hauptlinks

Suche

News des 13. Juli 2010

Bei SemiAccurate hat man sich ein an einer Aufstellung zu den Herstellungskosten einer GeForce GTX 460 versucht. Der GF104-Chip mit seiner Die-Fläche von ca. 320mm² dürfte diesbezüglich grob in die Richtung von ATIs RV870/Cypress-Chips gehen – dieser ist minimal größer (334mm²), aber länger im Markt und sollte daher die derzeit bessere Produktionsausbeute haben, allerdings dürften RV870/Cypress-Boards auch generell etwas teuer sein als die GF104-Boards. Aufgrund der niedrigeren Abgabepreise von GF104-Grafikkarten rechnen SemiAccurate dann allerdings aus, daß ATI das deutlich bessere Geschäft macht – wobei hierbei durchaus Äpfel mit Birnen verglichen werden, denn der höheren Abgabepreis betrifft nicht den GeForce-GTX-460-Kontrahenten Radeon HD 5830, sondern natürlich Radeon HD 5850 & 5870, deren Kontrahenten allerdings die GF100-basierten GeForce GTX 470 & 480 sind. Würde man also streng die preisgleichen Karten – ergo GeForce GTX 460 und Radeon HD 5830 – vergleichen, würde wohl herauskommen, daß beide in etwa gleich rentabel für die Grafikchip-Entwickler und die Grafikkartenhersteller sind.

Zudem leidet die Rechnung natürlich unter dem Problem, daß sowohl die Produktionsausbeute einzelner Grafikchips nicht bekannt ist – und zum anderen auch zum Wafer-Preis bei Chipfertiger TSMC nur ungenügende Informationen vorliegen. Zwar sagt man gern, daß ein 300mm Risk-Wafer bei TSMC mit 5000 Dollar zu Buche steht, aber dies sagt nun wenig aus über die Waferkosten einer Massenproduktion. Auch kann die Vertragsgestaltung gänzlich anders sein als bei Risk-Wafern, wo das Risiko der Produktionsausbeute komplett beim Grafikchip-Entwickler liegt – in der Vergangenheit hatte TSMC in der Massenproduktion durchaus auch Verträge geschlossen, in denen eine gewisse Mindestausbeute garantiert war, bei deren Unterschreitung also TSMC die kompletten Kosten übernommen hat. Auch sind Zwischenformen denkbar, wo sowohl TSMC als auch die Grafikchip-Entwickler jeweils einen Teil des Produktionsrisikos tragen.

Die Rechnung von SemiAccurate stimmt bezüglich der Grafikchip-Herstellungspreise in jedem Fall überhaupt nicht – weil man dort schlicht den Preis der Risk-Wafer angesetzt hat, was gerade für den RV870/Cypress-Chip inzwischen bei weitem nicht mehr passen dürfte. Da wir – ohne jede weitere Information – an dieser Stelle nicht spekulieren wollen, wieviel 300mm-Wafer in 40nm von TSMC aktuell nun kosten, verweisen wir zur Frage des Grafikchip-Preises besser auf Informationen aus einem älteren Artikel, in welchem es um die Aufschlüsselung der Herstellungspreise aller Komponenten einer Grafikkarte geht: Danach liegt ein Chip des Performancesegments zwischen 32 und 55 Dollar Abgabepreis an die Grafikkartenhersteller, im HighEnd-Segment sind es bis zu 90 Dollar. Innerhalb dieses Bereichs müssen dann die Herstellungspreise liegen – und da bei Grafikchips zu den reinen Produktionskosten jeweils noch erhebliche Entwicklungskosten hinzukommen, sollte der reine Herstellungspreis sogar klar unterhalb dieses Abgabepreises liegen.

Im Fall einer GeForce GTX 460 kann man also annehmen, daß der Grafikchip die Grafikkartenhersteller vielleicht 50 bis 55 Dollar kostet, die Kosten für ein Boards dürften irgendwo um die 70 Dollar liegen. Damit liegt der Materialwert bei 120 bis 125 Dollar, was zuzüglich der Aufwendungen für Transport, Marketing, Händlermargen und Support sich als machbares Geschäft darstellt – genau läßt sich das natürlich mit diesen vielen Schätzwerten nicht sagen. Und zurückkommend zum reinen Chippreis läßt sich konstatieren, daß nVidia den GF104-Chip realistisch betrachtet für sicherlich klar unter 50 Dollar herstellen wird können, da mit der Produktion dieser Chips ja auch noch die Dutzenden Millionen Dollars an Entwicklungskosten wieder eingespielt werden müssen (und werden, wenn man sich die nVidia-Geschäftsergebnisse ansieht). Die diesbezügliche Rechnung von SemiAccurate stimmt ergo hinten und vorn nicht – was jetzt nicht ganz überraschend kommt in einem Fall, wo SemiAccurate etwas über nVidia schreibt ;).

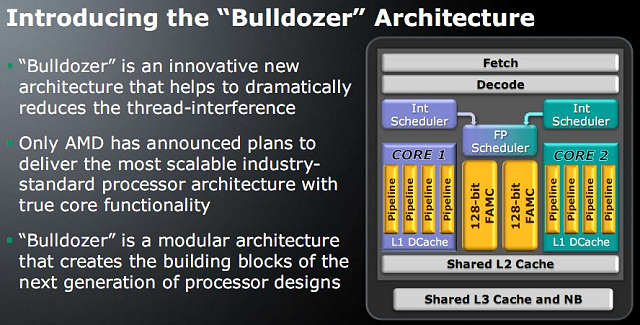

Seitens Citavia gibt es neue Details zum kommenden Bulldozer-Prozessorendesign seitens AMD: Danach enthält wohl jeder der zwei Teilkerne eines Bulldozer-Kerns gleich vier ALUs (Arithmetic Logic Units) und drei oder vier AGUs (Address Generation Units), was ziemlich heftig wäre – denn bisher konnte man auch annehmen, daß sich die auf verschiedenen Schemabildern eingezeichneten vier Einheiten in einem Teilkern auch auf 2 ALUs und 2 AGUs aufschlüsseln lassen, nun ist es wohl das doppelte. Damit hat einer der beiden Teilkerne eines Bulldozer-Kerns schon mehr Integerpower als ein K10-Recherkern, welcher drei ALUs und drei AGUs aufbieten kann – und Bulldozer hat wie gesagt gleich zwei Integer-Minikerne in einem Rechenkern.

Natürlich muß diese geballte Rechenleistung auch anständig über den Scheduler gefüttert werden können, was derzeit alles noch im weitgehend unbekannten Bereich liegt – aber so ist zumindest das Potential dafür vorhanden, daß AMD bei der Pro/MHz-Leistung mal wirklich erhebliche Verbesserungen hinbekommt, um auf die diesbezüglich klar führende Nehalem-Prozessorenarchitektur von Intel aufschließen zu können. Schließlich sind Taktraten nun einmal vom Produktionsverfahren her begrenzt und kann AMD nicht ewig immer nur mit höheren Taktraten der besseren Pro/MHz-Leistung von Intel hinterherhecheln – irgendwann muß einfach mal ein größerer Sprung in die Richtung höhere Pro/MHz-Leistung auch bei AMD kommen. Bulldozer scheint ganz klar in diese Richtung zu gehen und hat sogar das Potential, Intel in dieser Frage richtig unter Druck zu setzen. Allerdings wird sich auch Bulldozer schon nicht mehr an der Nehalem-, sondern dann an der Sandy-Bridge-Architektur messen lassen müssen.

Shortcuts: Im Widerspruch zu der Meldung von letzter Woche, Intel wolle die Celeron-Marke im nächsten Jahr gänzlich auslaufen lassen, hat Intel dies gemäß Fudzilla dementiert: Danach sollen weiterhin Celeron-Prozessoren für den absoluten LowCost-Bereich aufgelegt werden – als Billigst-Marke unter der Billig-Marke "Pentium". Die PC-Welt berichtet über einen Trojaner mit einer neuen Angriffsmethode über den Windows Input Method Editor (IME). Interessanter an diesem Fall sind aber zwei Nebenpunkte: Erstens basiert der Trojaner wieder auf der tatkräftigen Mithilfe des Anwenders, da dieser den Schädling – welcher sich unbeholfen als update.exe "tarnt" – selber starten muß, und zweitens ist das Wirken des Trojaners auch in diesem Fall einwandfrei daran zu erkennen, daß dieser diverse Sicherheitsprogramme ausschaltet. Bei Orthy gibt es einen exzellenten Kühler-Ratgeber zur Radeon HD 5770, welcher sich mit all den erhältlichen extra Grafikkarten-Kühlern und deren Montagefähigkeit auf den verschiedenen Layouts der Radeon HD 5770 beschäftigt – gerade auf das Kompakt-Layout der Karte passen nämlich nur die wenigsten Grafikkartenkühler.