Hauptlinks

Suche

Hardware- und Nachrichten-Links des 3. September 2020

Videocardz zeigen die ersten Straßenpreise für Ampere-Custommodelle in Großbritannien, konkret vom Caseking-Partner "Overclockers.co.uk". Relevant hieran ist vor allem, wie nahe jene Straßenpreise an die Listenpreis herankommen bzw. wie die Spanne nach oben hin ist – immer allerdings unter dem Vorbehalt, das Vorabpreise jederzeit leicht zu hoch ausfallen können. Diese Problematik scheint jedoch im konkreten Fall überhaupt nicht vorzuliegen, denn jene Vorabpreise liegen teilweise sogar leicht unterhalb der Listenpreise. Auch die Preisspanne geht in Ordnung, denn jene beinhaltet natürlich auch hochwertige Eigendesigns, im Median-Schnitt liegen diese Straßenpreise nur knapp oberhalb der Listenpreise. Daraus ergeben sich zwei Erkenntnisse: Zum einen kommt Gaming-Ampere tatsächlich zu den von nVidia genannten Preislagen in den Einzelhandel. Und zum anderen gibt es diesesmal wohl keine unterschiedliche Preissituation zwischen Herstellerkarten und nVidias eigener Founders Edition, der von nVidia genannte Listenpreis umfasst somit wieder beide Karten-Ausführungen.

| UK-Listenpreis | Preisspanne | Median | |

|---|---|---|---|

| GeForce RTX 3090 | £1399 | £1399-1590 | £1415 |

| GeForce RTX 3080 | £649 | £639-849 | £670 |

| GeForce RTX 3070 | £469 | £449-499 | £470 |

| gemäß der von Videocardz erfassten Straßenpreise des britischen Händlers Overclockers.co.uk | |||

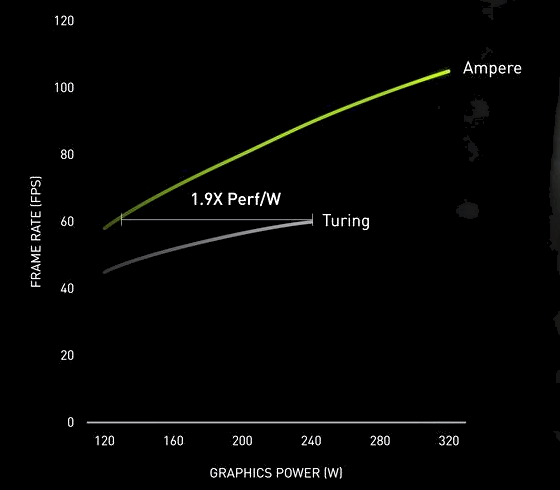

Hardwareluxx weisen auf den wichtigen Umstand hin, dass nVidias Energieeffienz-Angabe zu Ampere ziemlich "kreativ" gedacht ist: Verglichen wird seitens nVidia zu einer festen fps-Rate, üblich ist hingegen der Vergleich zu einem festen Stromverbrauch (es heißt schließlich "Performance per Watt", selbst nVidia benutzt diese Terminologie). Laut Hardwareluxx erzielt Ampere in nVidias eigenem Schaubild eine reale Energieeffizienz von ca. +50% auf Turing, da auf demselben Stromverbrauch unter Ampere ca. 90 fps erzielt werden, wo Turing nur 60 fps erreicht. Davon abgesehen fand dieser Vergleich natürlich nur unter einem einzelnen Spieletitel statt (somit mutmaßlich ein Bestcase) und sind die verglichenen Karten nicht direkt benannt. Im Schnitt unabhängiger Tests könnte sich somit durchaus noch eine etwas niedrigere Differenz einstellen – was dann, wenn da vielleicht nur +45% Energieeffizienz auf Turing herauskommt, schon sehr heftig von nVidias offizieller Angabe abweichen würde.

Videocardz fassen hingegen die wichtigsten Aussagen zur GeForce RTX 3000 Generation aus einer Fragestunde mit nVidia auf Reddit zusammen. Erwähnenswert sind hierbei die nVidia-Ausführungen zu DLSS bei Ampere, welches nunmehr die Versionsnummer 2.1 erreicht. Jenes beinhaltet allerdings "nur" drei Detail-Verbesserungen, im genauen den Support für 8K, VR sowie dynamische Auflösungen. Das vorher prognostizierte "DLSS 3.0" hat sich somit nicht materialisiert, dies war dann eines der nicht zutreffenden Gerüchte zu Gaming-Ampere. Zur seinerzeit aufgeworfenen Frage, ob DLSS eventuell per default im Treiber aktiviert ist, wurde nichts gesagt, aber wahrscheinlich trifft auch dieses Gerücht letztlich nicht zu. Allerdings ist klar, dass nVidia DLSS durchaus als seine "Lösung der Wahl" ansieht, denn in allen nVidia-eigenen Benchmarks unter Spieletiteln, wo DLSS zur Verfügung steht, wurde dieses (durch nVidia) genutzt. Dabei wurde auch gern einmal mit Ampere auf DLSS gegen Pascal ohne DLSS verglichen – und somit die Performance-Differenz zwichen Pascal und Ampere künstlich aufgebläht. Auch dieses Bild werden die unabhängigen Testberichte (ab 17. September) dann korrigieren müssen.

Zur kürzlichen Meldung über die verdoppelte Anzahl an Shader-Einheiten bei Gaming-Ampere sind noch zwei relevante Nachträge zu bringen: Zum einen liegt der auf gleicher Anzahl an Shader-Einheiten normierte Performancegewinn zwischen Pascal und Turing augenscheinlich bei ca. +30%, zu ermessen an den fast Hardware-gleichen GeForce GTX 1080 und GeForce RTX 2070 Super Grafikkarten. Ein kleinerer Teil hiervon geht noch weg wegen leicht unterschiedlicher Taktraten und kleineren Hardware-Differenzen, aber grob liegt der auf die reine Anzahl an Shader-Einheiten normierte Turing-Effekt bei ca. +25%. Dies ist dann das, was Turing mittels seiner besseren Shader-Cluster herausholt, welche zum einen mehr Verwaltungslogik führen und zum anderen eben noch die INT32-Einheiten an Bord haben. Doch dies ist dann beachtbar weniger, als was nVidia mit seiner Aussage angegeben hatte, nachdem auf 100 FP32-Berechnungen immerhin 36 INT32-Berechnungen kommen sollen.

| GeForce RTX 1080 | GeForce RTX 2070 Super | Verbesserung | |

|---|---|---|---|

| Chipbasis | Pascal GP104 | Turing TU104 | - |

| Raster-Engines (GPC) | 4 | 5 | +20% |

| Shader-Cluster (SM) | 20 | 40 | +100% |

| FP32-Einheiten (CUDA-Cores) | 2560 | 2560 | keine Differenz |

| INT32-Einheiten | - | 2560 | extra INT32-Power |

| Textureneinheiten (TMUs) | 160 | 160 | keine Differenz |

| ROPs | 64 | 64 | keine Differenz |

| Level2-Cache | 2 MB | 4 MB | +100% |

| Speicherinterface | 256 Bit GDDR5X | 256 Bit GDDR6 | GDDR5X → GDDR6 |

| 4K Perf.Index | 132% | 172% | +30% |

Immerhin bleibt die Verwaltungslogik bei der nachfolgenden Ampere-Architektur gleich (oder wird sogar besser), es entfällt allein der Effekt des INT32-Performancegewinns, sofern man den doppelten FP32-Durchsatz aktiviert. Selbiger liegt demzufolge irgendwo in den genannten +25% drin, die genaue Höhe wird sich natürlich kaum jemals ermitteln lassen. Eine grobe Schätzung von +10-20% führt dazu, dass der Rechenleistungs-Zugewinn von Turing zu Ampere auf ca. +65-80% geschätzt werden kann, in diesem Fall normiert auf die Anzahl der Shader-Cluster. Wieviel davon wirklich auf die Straße gebracht wird, bleibt noch abzuwarten – die aktuell herumschwirrenden Benchmarks kommen alle von nVidia selber oder sind unter von nVidia kreierten Bedingungen entstanden (#1, #2 & #3) und demzufolge schwierig zu werten. Die grundsätzliche Höhe des (derzeit) augenscheinlichen Performance-Zugewinns von Gaming-Ampere läuft jedoch durchaus auf die Möglichkeit hin, jenen realen Zuwachs an Rechenleistung (wie gesagt ca. +65-80%, normiert per Shader-Cluster) nahezu in dieser Höhe auch in der Spiele-Praxis zu sehen.

Der andere Nachtrag betrifft die rein technische Ausgestaltung der Shader-Cluster von Ampere bzw. der dort verbauten Recheneinheiten. Ein im 3DCenter-Forum schreibender nVidia-Mitarbeiter hat hierzu zuletzt wiederholt darauf hingewiesen, dass nVidias Blockschaltbilder und Angaben zur Anzahl an "CUDA-Cores" eher denn schematisch zu sehen sind. nVidias Angaben sollen in Bezug auf die damit erreichbare Rohleistung zwar korrekt sein, aber die eigentliche Hardware-Gestaltung im Silizium weicht wohl doch teilweise von den Blockschaltbildern ab. Denkbar beispielsweise, dass jene CUDA-Cores nicht wirklich einzeln vorliegen, sondern immer Teil eines größeren Rechenwerks sind, welches mehrere CUDA-Cores umfasst. Denkbar auch, dass die einzelnen FP32- und INT32-Einheiten letztlich dieselbe Einheit bilden, welche einfach zu beiden Rechenoperationen (nicht gleichzeitig) in der Lage ist. Inwiefern nVidia hierzu noch genauere Informationen herausgibt, bleibt abzuwarten: Demnächst werden wohl tiefergehende Technik-Artikel zu Ampere auf Basis entsprechender Whitepapers erscheinen, allerdings hat sich nVidia bislang noch nie genauer in die Karten blicken lassen als bis zur Tiefe der Viertel-Partition eines Shader-Clusters.