Hauptlinks

Suche

News des 18. Oktober 2010

Die letzte Gerüchtelage zum Barts-Chip der Radeon HD 6800 Serie geht laut Fudzilla dahingehend, daß es nunmehr angeblich sicher 1120 5-D VLIW Shader-Einheiten bei der Radeon HD 6870 sein sollen und 960 davon bei der Radeon HD 6850. Dies klingt plausibel – und würde letztlich ziemlich exakt dieselbe Rechenleistung ergeben, wenn es – wie lange vermutet – nur 960 4-D VLIW Shader-Einheiten beim Barts-Chip wären. Schließlich sollen 4-D VLIW Shader-Blöcke zu 98,5 Prozent so viel Leistung bringen wie 5-D VLIW Shader-Blöcke, sprich die einzelnen Shader-Einheiten sind rein rechnerisch um 23,1 Prozent effizienter zwischen 4-D und 5-D VLIW Einheiten. 960 4-D VLIW Einheiten könnten somit in der theoretischen Peakleistung so viel bringen wie 1182 5-D VLIW Shader-Einheiten – ein Chip mit "nur" 1120 5-D VLIW Shader-Einheiten würde allerdings schon gleich schnell sein, weil mit der höheren Anzahl an Shader-Einheiten auch eine etwas höhere Anzahl an Textureneinheiten einhergeht.

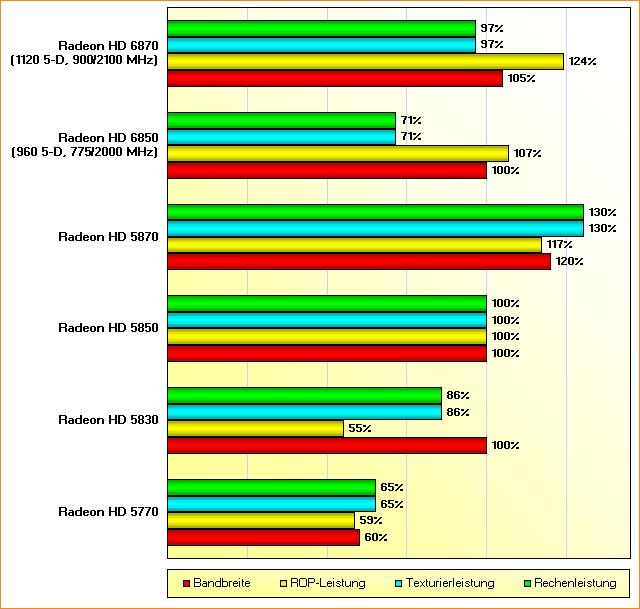

Entscheidender Punkt an einer Ausführung des Barts-Chips mit 1120 5-D VLIW Shader-Einheiten wäre die nahezu perfekte Vergleichbarkeit zum RV870/Cypress-Chip der Radeon HD 5800 Serie: Schließlich sind Speicherinterface und ROPs gleich und Barts soll zudem die Raster-Engine von RV870/Cypress erben – wennn Barts tatsächlich mit 5-D VLIW Shader-Einheiten daherkommt, wäre der letzte große Unterschied entschwunden und man konnte Barts trefflich als eine Light-Version des RV870/Cypress-Chips beschreiben. Mit diesen gemeinsamen Merkmale würde dann auch eine Performanceprognose sehr vereinfacht: Kommt die Radeon HD 6870 mit 1120 5-D VLIW Shader-Einheiten auf 900/2100 MHz, so hat diese in etwa die Rohleistung einer Radeon HD 5850 zur Verfügung. Mit ein paar Effizienzverbesserungen zwischen Barts und RV870/Cypress kann es in der Realität zu etwas mehr Performance bei gleicher Rohleistung kommen, aber die Performance einer Radeon HD 5870 kann eine solche Karte kaum erreichen.

Die Radeon HD 6850 würde mit 960 5-D VLIW Shader-Einheiten auf 775/2000 MHz irgendwo in der Nähe der Radeon HD 5830 landen – dies ist aufgrund der teilweise sehr unterschiedlichen Rohleistungen leider nur eher grob abschätzbar. Generell würde eine solche Ausführung des Barts-Chips aber gut zu den bisher bekannten Performance-Resultaten zur Radeon HD 6850 & 6870 passen, trotzdem verwundert der Rückschritt hin zu 5-D VLIW Shader-Einheiten: Wenn AMD diese sowieso mit dem Cayman-Chip auflegt (und diese 4-D Einheiten erwiesenermaßen effizienter sind), wieso dann nicht auch beim Barts-Chip? Eine mögliche Erklärung hierfür könnte sein, daß AMD nach der Entscheidung, die eigentlich geplante 32nm-Generation auf die 28nm-Fertigung zu verschieben und dafür eine weitere 40nm-Generation in Form von Northern Islands einzuschieben, nicht mehr all zu viel Zeit zur Verfügung hatte und daher die großen Änderungen nur beim HighEnd-Chip Cayman bringt, während sich Barts und die kleineren Chips aus Zeitgründen stärker an der Evergreen-Architektur der Radeon HD 5000 Serie orientieren.

In jedem Fall wird die Rätselei – welche AMD sicherlich mit einiger Begeisterung verfolgt haben dürfte – morgen ein Ende haben, denn dann steht ein Journalisten-Briefing zur Radeon HD 6800 Serie an. Üblicherweise dürfte es kurz danach den einen oder anderen Leak geben oder aber wenigstens ein paar Unter-der-Hand-Informationen, welche der inzwischen vielen spekulativ genannten Hardware-Bestückungen zu Barts denn nun die zutreffende ist und ob es 4-D oder 5-D VLIW Shader-Einheiten bei diesem Grafikchip geben wird. Bewaffnet mit diesen Informationen, dürften sich Radeon HD 6850 & 6870 dann recht gut einordnen lassen – und zum Freitag wird es mittels des offiziellen Launches dann auch noch massenweise Performance-Messungen geben, welche alle offenen Fragen zum Barts-Chip klären dürften.

Für OEM-Bedürfnisse hat nVidia eine GeForce GT 440 herausgebracht. Die Karte basiert auf dem GF106-Chip der GeForce GTS 450, tritt aber mit einer völlig anderen Hardware-Ausstattung an: Zuerst einmal gibt es nur 144 Shader-Einheiten und 24 TMUs anstatt 192 Shader-Einheiten und 32 TMUs wie bei der GeForce GTS 450 – auf der anderen Seite hat die GeForce GT 440 jedoch das volle 192 Bit DDR Speicheinterface des GF106-Chips, während die GeForce GTS 450 in dieser Frage auf ein Speicherinterface mit 128 Bit DDR Breite beschnitten ist. Doch bei der reinen Speicherbandbreite liegt die GeForce GTS 450 durch ihren mit 1800 MHz taktenden GDDR5-Speicher weiter vorn (57,6 GB/sec), während bei der GeForce GT 440 bestenfalls mit 900 MHz takender DDR3-Speicher zum Einsatz kommt (43,2 GB/sec).

Der einzige Effekt des größeren Speicherinterface liegt somit in der größeren Speichermenge – nVidia bietet die Karte mit gleich 1,5 oder 3,0 GB Speicher an. Der dabei herauskommende Mix ist natürlich arg zweifelhaft: Deutlich weniger Rechenleistung (342 zu 601 GFlops) und weniger Speicherbandbreite (43,2 zu 57,6 GB/sec) gegenüber der GeForce GTS 450 – und allein der Mehrspeicher wird die GeForce GT 440 überhaupt nicht voranbringen, nachdem die Fermi-Architektur nicht mehr die Probleme mit schnell ausgehendem Speicher wie die Vorgänger-Architekturen von nVidia hat. Ergo ist die GeForce GT 440 eine Karte, wo dem unbedarften Endkunden über den großen Speicher irgendein Vorteil suggeriert werden soll, der in der Praxis aber natürlich nicht vorhanden ist – nVidia tat weise daran, diese Karte nicht im Retail-Markt zu bringen.

Wie HT4U ausführen, hat AMD im Rahmen der Präsentation seiner Quartalszahlen ein wenig über die kommenden Prozessoren-Architekturen Llano (Mainstream) und Bulldozer (HighEnd) geplaudert. Danach soll Llano nun zwar doch früher als Bulldozer kommen – zwischen den Zeilen gelesen bedeutet dies aber eher, daß Bulldozer nun doch noch später als das bisher genannte zweite Quartal antritt. Da AMD gar nichts zu den Desktop-Modellen von Bulldozer sagen wollte, sondern sich nur auf die Server-Modelle bezog, kann man sogar vermuten, daß die Desktop-Modelle von Bulldozer erst zum Ende des dritten Quartals 2011 erscheinen werden – was dann in der Tat erst nach Llano wäre. Gegenüber Intel gerät AMD somit wieder einmal in zeitlichen Rückstand, denn trotz daß Intels HighEnd-Lösung Sandy Bridge E erst deutlich nach den regulären Sandy-Bridge-Modellen im Sommer 2011 erscheinen wird, kommt AMDs HighEnd-Lösung Bulldozer dann doch noch später als Intels.

| Intel Sandy Bridge | AMD Bobcat | Intel Sandy Bridge E | AMD Llano | AMD Bulldozer | |

|---|---|---|---|---|---|

| Zielmarkt | Desktop/Mobile LowCost bis HighEnd | Desktop/Mobile LowEnd bis LowCost | Desktop HighEnd | Desktop/Mobile LowCost bis Mainstream | Desktop HighEnd |

| Zeitpunkt | Vorstellung: CES 2011 Verfügbarkeit: CES 2011 |

Vorstellung: CES 2011 Verfügbarkeit: Anfang Q1/2011 |

Mitte Q2/2011 | Q3/2011 | Ende Q3/2011 |

| Fertigung | 32nm Intel | 40nm TSMC | 32nm Intel | 32nm GlobalFoundries | 32nm GlobalFoundries |

| Technik | geringe bis mittlere Verbesserungen gegenüber Nehalem, zwei bis vier Rechenkerne, DualChannel Speicherinterface, Speichersupport bis DDR3/1333 | abgespeckter K8-Kern, ein bis zwei Rechenkernen, SingleChannel Speicherinterface, Speichersupport bis DDR3/1333 | geringe bis mittlere Verbesserungen gegenüber Nehalem, vier bis acht Rechenkerne, TripleChannel oder QuadChannel Speicherinterface, Speichersupport bis ? | Kern ähnlich wie aktueller K10-Prozessor (größerer Level2-Cache, kein Level3-Cache), zwei bis vier Rechenkerne, DualChannel Speicherinterface, Speichersupport bis DDR3/1866 | stark veränderter Kern in Modul-Bauweise, vier bis acht Rechenkerne, DualChannel Speicherinterface, Speichersupport bis DDR3/1866 |

| Desktop-Sockel | 1155 | FT1 | 2010 | FM1 | AM3+ |

| Taktraten (Desktop) | 2.5 – 3.4 GHz | ~ 1.6 GHz | ? | ? | ? |

| integrierte Grafik | Intel-Grafikchip "Intel HD Graphics 200" (DirectX 10.1), Performance im Rahmen einer Radeon HD 5450 (abgespeckte Version "Intel HD Graphics 100" mit deutlich geringerer Performance) | AMD-Grafikchip mit 80 Shader-Einheiten (DirectX11), Performance im Rahmen einer Radeon HD 5450 | keine | AMD-Grafikchip mit 400-480 Shader-Einheiten (DirectX11), Performance im Rahmen einer Radeon HD 5550 DDR3 | keine |

Daneben hat AMD auch noch die Aussage getroffen, daß man auf absehbare Zeit ein Ende des Wettringens um immer mehr Rechenkerne mit Intel sieht. Wie WinFuture weiter ausführen, ging es dabei auch und besonders um Server-Prozessoren, wo also eigentlich mehr Rechenkerne immer noch sehr gern genommen werden – im Gegensatz zum Desktop-Segment, wo schon jetzt große Hürden absehbar sind, mehr als vier Rechenkerne anständig auszunutzen. Die Zukunft sieht AMD eher in Zusatzkernen für Spezialfunktionen, sprich Co-Prozessoren für Verschlüsselung, Video-Rendering oder Networking. Für den Desktop-Bereich ist dies sicherlich eine augenscheinlich logische Entwicklung, im Server-Bereich könnte dagegen der Bedarf nach mehr vollwertigen Rechenkernen noch lange vorhanden sein.