Hauptlinks

Suche

Aktuelle Treiber

- 26.5.2

- 32.0.101.8801

- 596.49

Neuer Artikel: Speicherkrise Preisindex April 2026

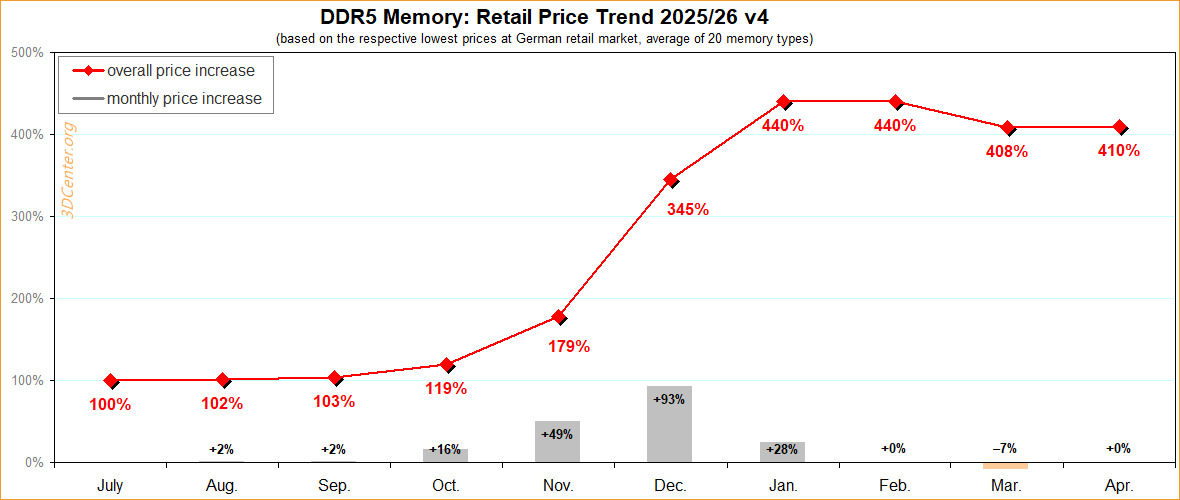

In wiederkehrender Aktualisierung des Speicherkrisen-Preisindex vom März soll nachfolgend erneut betrachtet wie auch dokumentiert werden, wie sich die Preise von DDR5, DDR3/4, SODIMM, internen SSDs & HDDs, externen Festplatten und Grafikkarten im deutschen Einzelhandel zwischen März und April 2026 sowie seit Sommer 2025 entwickelt haben. Zielsetzung ist es, zu klaren Zahlenwerten zu kommen, welche die hierbei auftretenden Preisübertreibungen für alle genannten Produktgruppen quantifizieren. Zugleich werden monatliche Steigerungsraten für jede Produktgruppe ermittelt, womit sich Anziehen und Abflauen von Preissteigerungen wie auch Preissenkungen belegen lassen. Abschließend wird auf Basis all dieser Daten der gesamte Verlauf der Preisveränderungen aller Produktgruppen von Beginn der Speicherkrise bis jetzt zusammengefasst in Diagramm-Form dargeboten ... zum Artikel.

News des 17. April 2026

Laut Tippgeber MEGAsizeGPU @ X soll sich die "GeForce RTX 5050 9GB" verspäten bzw. ist sogar etwas unsicher, ob jene Karte überhaupt noch erscheint. An deren Stelle soll nun hingegen die Neuauflage der GeForce RTX 3060 treten, welche im Juni erwartet werden darf. Letztgenannte Karte ist seit grob Jahresanfang aus dem Markt gegangen, es wurde aber jüngst bereits derart notiert, dass jene erneut aufgelegt bzw. gefertigt wird. Wichtig hierzu ist auch der Nachtrag, dass es sich tatsächlich um die 12-GB-Ausführung der GeForce RTX 3060 handelt – und nicht um die 8-GB-Ausführung, für welche nun kaum ein Bedarf zugunsten einer Neuauflage zu sehen ist. Bei einem anständigen Preispunkt – jener sollte unterhalb der GeForce RTX 5050 8GB liegen, da jene schneller und moderner ist – könnte da durchaus noch eine interessante Grafikkarte für Einsteiger-Bedürfnisse herauskommen, welche zudem mehr als 8 GB VRAM bietet. Im Preissegment von unter 300 Euro erreicht dies keine andere AMD- oder nVidia-Grafikkarte, die einzige Alternative ist hier Intels Arc B580.

RTX 5050 9G is delayed, launch becomes pretty uncertain now. The newly produced RTX 3060 will fill the gap, ETA June 2026.

Quelle: MEGAsizeGPU @ X am 17. April 2026

Is that still a 12GB?

Quelle: Touchy Bannerson @ X am 17. April 2026

Yes

Quelle: MEGAsizeGPU @ X am 17. April 2026