Hauptlinks

Suche

Aktuelle Treiber

- 26.5.2

- 32.0.101.8801

- 596.49

News des 27. April 2026

Unter den weiteren hereinkommenden Artikeln zum Ryzen 9 9950X3D2 vielleicht noch am interessantesten ist eine extra Ausarbeitung der PC Games Hardware zum Duell Ryzen 9 9950X3D vs 9950X3D2 auf jeweils gleichem Powerlimit – welches sich beim 9950X3D2 sogar auf 270W beläuft. Hierbei wurden beide X3D-16-Kerner jeweils normal und jeweils mit dem Powerlimit des anderen Prozessors ausgemessen – um herauszufinden, wie stark der Ryzen 9 9950X3D2 von seinem immerhin um 70 Watt höheren PPT profitiert. Hiernach läßt sich zum einen belegen, dass diese Differenz ziemlich klein ist, unter jenen Benchmarks gewinnt der Ryzen 9 9950X3D2 durch das höhere Powerlimit gerade einmal +2,2% unter Anwendungen sowie +1,4% unter Spielen hinzu. Da der reguläre Ryzen 9 9950X3D zudem von einem höheren Powerlimit ähnlich schwach profitiert, ergibt sich sogar die Situation, dass ein Ryzen 9 9950X3D2 @ 200W minimal schneller als ein Ryzen 9 9950X3D @ 270W herauskommt.

| Ryzen 9 9950X3D | 9950X3D @ 270W | 9950X3D2 @ 200W | Ryzen 9 9950X3D2 | |

|---|---|---|---|---|

| Powerlimit (PPT) | 200W | 270W | 200W | 270W |

| Anwendungs-Performance | 95,5% | 97,2% | 97,7% | 99,9% |

| Spiele-Performance | 97,5% | 97,2% | 98,5% | 99,9% |

| gemäß den Ausführungen bzw. Benchmarks der PC Games Hardware | ||||

News des 25./26. April 2026

YouTuber Moore's Law Is Dead verspricht im Titel zwar den baldigen Launch von nVidias N1X WoA-Chipsatz – das Video dreht sich dann aber eher darum, wieso selbiger weiterhin verschoben sein könnte. Zumindest zwei Industriequellen geben laut MLID an, dass nVidia erst im vierten Quartal damit herauskommen will – und dass dies dann dennoch eher ein Paperlaunch sein solle. Zumindest eine Quelle führt dazu aus, dass die großen Lieferkontingente für Gaming-SKUs erst im ersten Quartal 2027 "unterwegs" sein sollen – was aus der Sicht von OEMs eher deren eigenen Wareneingang bedeutet, somit noch einmal einige Wochen mehr Zeit braucht bis zur Ladentheke. Über den Grund dieser weiteren Verzögerungen sind sich hingegen beide Industriequellen auffallend einig: Massen an Bugs, auch im Zusammenspiel mit Windows, die Microsoft und nVidia noch fixen müssen, ehe dieses Konstrukt marktreif werden kann. Ob der späte Launchtermin und die kürzliche Streichung der MediaTek-Keynote zur Computex irgendwie zusammengehören, ist hingegen noch nicht sicher.

Source 1: We [Nvidia Partner] were just told that N1X should finish preparations for launch over the next 2-3 months. I would say at least a Q4 2026 paper launch is likely, and specifically we were told that high volume shipments for gaming models will be underway by Q1 2027. BTW – Nvidia & MS are still working to crush tons of bugs with MX. It's a nightmare.

Source 2: I [Major OEM] can confirm that MX is currently planned to be announced at Computex in a couple months, and then launch in October. However, I believe this will be a paper launch. Oh, and for what it's worth I am very skeptical of this product launching smoothly. Never doubt Nvidia, but so far this product has been a complete basket case – tons of bugs, endless delays, and genuinely few people over here expect good things.

Quelle: Industriequellen gegenüber Moore's Law Is Dead @ YouTube, veröffentlicht am 25. April 2026

News des 24. April 2026

Laut Leaker 'Jaykihn' plant Intel positiverweise bereits über die Grafikarchitekturstufe "Xe4" hinaus – denn etwas, was sich dann "Xe5" nennen könnte, ist für Mitte/Ende 2028 in der Pipeline. Dafür hat man allerdings alle Pläne zugunsten von Gaming-Grafikkarten auf Xe3-Basis eingestellt – und selbiges steht für Xe4 in den Sternen. Anders formuliert: Intel treibt seine Grafikarchitektur-Entwicklung weiter voran, auf Xe4 wird Xe5 folgen. Aber Gaming-Grafikkarten stehen derzeit nicht mehr auf dem Menü – so wie es denkbarerweise keinen "Big Battlemage" (Xe2) mehr geben wird und nun definitiv keine "Celestial"-basierten Grafikkarten (Xe3) und wie gesamt möglicherweise auch keine "Druid"-basierten Grafikkarten (Xe4). Dies ist aus Gamer-Sicht natürlich ein Trauerspiel, weil sich damit der faktisch eben erst erworbene dritte Wettbewerber im Grafikkarten-Markt aus diesem schon wieder zurückzieht – mit ungewisser Zukunft, ob sich dies eines Tages noch einmal ändern möge. Hinweis: Intels Xe-Namen sind universell, nicht an ein Segment oder Produkte gebunden. Die Eigennamen Battlemage, Celestial & Druid stehen hingegen eigentlich immer nur für die jeweiligen Gaming-Grafikkarten.

Xe4 successor mid-to-late 2028.

Crescent Island successor mid-to-late 2028.

Jaguar Shores successor late 2028, introduces rack-scale segment.

Quelle: Jaykihn @ X am 24. April 2026

Celestial was canned long ago.

Druid is up in the air.

Quelle: Jaykihn @ X am 24. April 2026

Xe3p gaming dGPU was actively developed and then cancelled long ago.

Quelle: Jaykihn @ X am 24. April 2026

Xe3P = Celestial.

Followed by Xe4 down the line.

Xe4 successor may or may not be Xe5.

Intel’s graphical architecture naming is not as straightforward as integer iterations; Xe4 itself has had multiple names, and multiple architectures have been referred to as Xe4, over time.

Quelle: Jaykihn @ X am 24. April 2026

Die Intel-Geschäftsergebnisse im ersten Quartal 2026

Intel hat seine Geschäftsergebnisse für das erste Quartal des Jahres 2026 vorgelegt, in welchem Intel zwar bei den Umsatz-Zahlen glänzen, bei den Gewinn-Zahlen jedoch wieder einmal im tief roten Bereich herauskommt. Die Ausgangslage war dabei eigentlich gut, denn Intel hatte vorab selber nur 11,7-12,7 Mrd. Dollar Umsatz prognostiziert, konnte dies dann aber mit 13,6 Mrd. Dollar klar überbieten und kommt damit sogar bis auf eine geringe Differenz an den Umsatz des Jahresschlußquartals 2025 heran – welches Intel mit einem ersten Quartal gewöhnlich niemals schlägt. Dies ist von dieser Seite her ein wirklich guter Start ins Jahr, gerade da Intel für das laufende zweite Quartal mit 13,8-14,8 Mrd. Dollar gleich einmal eine weitere Umsatzsteigerung verspricht. Das zweite Quartal soll dann auch ein Ende der Minuszahlen sehen, welche aber auch für dieses erste Quartal wieder stark von Sondereffekten bestimmt sind: 4,1 Mrd. Dollar gingen allein für Restrukturierungskosten drauf, der operative non-GAAP-Gewinn ist hingegen erneut klar positiv.

| Q1/2025 | Q2/2025 | Q3/2025 | Q4/2025 | Q1/2026 | |

|---|---|---|---|---|---|

| Umsatz | 12'667 Mio. $ | 12'859 Mio. $ | 13'653 Mio. $ | 13'674 Mio. $ | 13'577 Mio. $ |

| (nomineller) Gewinn | –887 Mio. $ | –3024 Mio. $ | 4270 Mio. $ | –333 Mio. $ | –4281 Mio. $ |

| Bruttomarge | 36,9% | 27,5% | 38,2% | 36,1% | 39,4% |

| operativer non-GAAP-Gewinn | 690 Mio. $ | –503 Mio. $ | 1524 Mio. $ | 1205 Mio. $ | 1668 Mio. $ |

News des 23. April 2026

Augenscheinlich arbeitet Intel laut der PC Games Hardware bzw. Aussagen von Intel höchstselbst daran, zukünftig mehr übertaktungsfähige Intel-Prozessoren anzubieten. Wie bekannt, sind jene derzeit auf die K/KF-Modelle begrenzt, was pro Generation üblicherweise 6 Prozessoren-Modelle bzw. drei unterschiedliche Prozessoren-Modelle des mittleren bis hohen Preisbereichs ergibt. AMD läßt die Übertaktung hingegen bei allen Modellen frei, sprich auch den Modellen des Mainstream-Segments. Dabei dürfte es kaum eine Rolle spielen, dass CPU-Übertaktung inzwischen weit entfernt vom Volkssport-Charakter der 90er und 2000er Jahre ist, sprich in der Praxis wenig benutzt und zumeist auch ziemlich zweckfrei ist. Was zählt ist eher, dass Intel in dieser Disziplin klar zurückliegt – und dass dies natürlich einer jener Punkte ist, welche man mit dem wenigsten Einsatz glattbiegen kann.

What you will see is more and more unlocked SKUs over time. That is the goal. That should not be a feature that is exclusively reserved for the people paying the most amount of money.

Quelle: Intels Robert Hallock gegenüber PC Games Hardware, veröffentlicht am 21. April 2026

News des 22. April 2026

Heise und ComputerBase berichten über die neuen TSMC-Fertigungsverfahren N2U, A13 und A12, welche TSMC im Zeitraum der Jahre 2028/29 herausbringen will. Hierbei dreht es sich grundsätzlich immer um Abwandlungen bekannter Verfahren – N2U entstammt N2P sowie A13 & A12 entstammen A14, handelt es sich also noch nicht um neue Fullnodes – diese sind somit erst für das Jahr 2030 zu erwarten. A12 bringt aber immerhin die Besonderheit mit, der Super-Power-Rail-Ableger von A14 zu sein, sprich mit "Backside Power Delivery" zu arbeiten – und damit besonders für dicke Server-Chips interessant zu sein. Ansonsten liest sich die Liste der Verbesserungen maßvoll bzw. war TSMC zu A13 & A12 generell wenig mitteilungsfreudig bezüglich harter Fakten. Dabei dürfte TSMC natürlich trotzdem alles aus den Händen gerissen werden, denn bislang konnte sich keiner der Kontrahenten an TSMCs Spitzenstellung heranarbeiten.

|

News des 20./21. April 2026

Die Launchreviews zum Ryzen 9 9950X3D2 sind wie zu sehen arg mager in der Anzahl ausgefallen, fehlend darunter Ausarbeitungen von einigen der bekanntesten Web-Publikationen. Der Grund hierfür wurde schnell bekannt: AMD hatte angeblich nur sehr wenige Testmuster und hat somit nur ausgewählten Publikationen ein Testexemplar zukommen lassen. Dies führt natürlich zur Verärgerung bei den nicht bedachten Publikationen und der erstaunten Frage, ob AMD mit dieser Auswahl die Testergebnisse zu beeinflussen versuchen könnte. Dies scheint nach Sicht der tatsächlich mit Hardware bedachten Publikationen aber weniger der Fall zu sein, denn darunter sind auch (einige), welche sehr akkurat und nachvollziehbar testen. Vermutlich ging es AMD hierbei nur darum, diesen Launch auf möglichst kleiner Flamme kochen zu lassen, damit nicht gleich Netz-weit thematisiert wird, wie mager der Ryzen 9 9950X3D2 doch letztlich ausgefallen ist. Dabei ist der Mehrgewinn an Anwendungs-Performance mit +5-7% gegenüber dem regulären Ryzen 9 9950X3D sogar ganz praktikabel, rechnet man ein, dass es sich hierbei nur um eine Abwandlung jenes Ryzen 9 9950X3D handelt – einen 3D V-Cache hatte letzterer schließlich auch schon.

| Anwendungen | 270KP | 9850X3D | 9950X | 9950X3D | 9950X3D2 |

|---|---|---|---|---|---|

| Hardware & Co (16 Tests) | 102,7% | 73,3% | 95,8% | 100% | 107,4% |

| PC Games Hardware (6 Tests) | 91,0% | 62,2% | 96,0% | 100% | 104,6% |

AMD Ryzen 9 9950X3D2: Die Launchreviews gehen online

Mit dem Ryzen 9 9950X3D2 schickt AMD – ziemlich spät – die Königsvariante seiner X3D-Modelle für Zen 5 in den Markt – endlich also mit zwei 3D V-Cache Chiplets und damit nicht mehr der Problematik, dass beide CCDs des bekannten Ryzen 9 9950X3D unterschiedlich stark sind. Andererseits dürfte AMD sich das zweite Cache-Chiplet bisher nicht nur aus Kostengründen gespart haben, vielmehr ist zu erwarten, dass der Performance-Effekt des Ryzen 9 9950X3D2 oftmals eher marginal ausfällt. Dies trifft gerade deswegen zu, weil der maximale Boosttakt um –100 MHz niedriger ausfällt, was bei Singlethread-Performance und Gaming-Benchmarks weniger gut kommt. In jedem Fall steht über dem Ryzen 9 9950X3D das große Fragezeichen, ob sich jener überhaupt vom konventionellen Ryzen 9 9950X3D absetzen kann bzw. seine 200 Dollar Mehrpreis wert ist. Andererseits kann man den Ryzen 9 9950X3D2 auch als absolutes Halo-Modell betrachten für diejenigen Anwender, welche generell nur das allerbesten kaufen. Wo sich der Ryzen 9 9950X3D2 gegenüber diesen Frage einordnen muß, haben die auffallend wenigen Launchreviews versucht zu beantworten, kann in unserem Forum diskutiert werden und sollte nachfolgend noch das Thema einer Launchanalyse sein – sofern sich da noch eine ordentliche Anzahl an Reviews einfinden möge.

| AMD Zen 5 X3D | Kerne | L2+L3 | 3DVC | Takt | iGPU | OC | TDP/PPT | Listenpreis | Release |

|---|---|---|---|---|---|---|---|---|---|

| Ryzen 9 9950X3D2 | 16C/32T | 16+64 MB | 128 MB | 4.3/5.6 GHz | ✓ | ✓ | 200/250W | $899 / 910€ | 22. April 2026 |

| Ryzen 9 9950X3D | 16C/32T | 16+64 MB | 64 MB | 4.3/5.7 GHz | ✓ | ✓ | 170/200W | $699 / 769€ | 12. März 2025 |

| Ryzen 9 9900X3D | 12C/24T | 12+64 MB | 64 MB | 4.4/5.5 GHz | ✓ | ✓ | 120/162W | $599 / 659€ | 12. März 2025 |

| Ryzen 7 9850X3D | 8C/16T | 8+32 MB | 64 MB | 4.7/5.6 GHz | ✓ | ✓ | 120/162W | $499 / 499€ | 29. Jan. 2026 |

| Ryzen 7 9800X3D | 8C/16T | 8+32 MB | 64 MB | 4.7/5.2 GHz | ✓ | ✓ | 120/162W | $479 / 529€ | 7. Nov. 2024 |

| Ryzen 5 9600X3D | 6C/12T | 8+32 MB | 64 MB | ? | ? | ? | ? | ? | komplett unbestimmt |

| Hinweis: Angaben zu noch nicht offiziell vorgestellter Hardware basieren auf Gerüchten & Annahmen | |||||||||

News des 18./19. April 2026

Von Leaker 'Jaykihn' kommen umfangreiche Hinweise zu den Cache-Konfigurationen von Nova Lake, bezogen sowohl auf bLLC-Modelle als auch non-bLLC-Modelle. Zugleich gibt es weitergehende Informationen zu den Verkaufsnamen und zur Frage der CPU-Features AMX und AVX10.1: Tweet #1, Tweet #2, Tweet #3, Tweet #4 & Tweet #5. Die Sache wird somit etwas klarer und Intels kommendes Desktop-Portfolio für das Jahr 2027 bereits besser einschätzbar. Als neue SKU kommt eine weitere P2-Ausführung im Rahmen des "Core Ultra 9 400" hinzu, welche zwar den bLLC-Cache tragen soll, aber nicht damit beworben wird – sprich ausdrücklich nicht als "400D" laufen soll. Ansonsten ist der Suffix "D" zukünftig das klare Kennzeichen für die Existenz eines vergrößerten Level3-Caches (bLLC) und das Suffix "DX" kennzeichnet Prozessoren mit zwei Compute-Dies samt bLLC. Dies war beim ersten größeren Leak hierzu bereits vermutet worden, bestätigt sich nun aber.

| Intel-Code | Verkaufsname | Kerne | Die(s) | L3-Cache | TDPs | Features |

|---|---|---|---|---|---|---|

| P3DX | Core Ultra 400DX | 52C = 16P+32E+4LP | 2x 8P+16E+bLLC-Die | 288 MB | 175W | bLLC/X-Modelle |

| P2DX | Core Ultra 400DX | 44C = 16P+24E+4LP | 2x 8P+16E+bLLC-Die | 264 MB | 175W | bLLC/X-Modelle |

| P2D | Core Ultra 9 400D | 28C = 8P+16E+4LP | 8P+16E+bLLC-Die | 144 MB | 125W | bLLC-Modelle |

| P2K | Core Ultra 9 400K | 28C = 8P+16E+4LP | 8P+16E-Die | 36 MB | 65W/125W | teilweise K-Modelle |

| P2 | Core Ultra 9 400 | 22C = 6P+12E+4LP | 8P+16E+bLLC-Die | 108 MB | ? | bLLC-Modelle |

| P2 | Core Ultra 9 400 | 22C = 6P+12E+4LP | 8P+16E-Die | 27 MB | 65W | - |

| P1D | Core Ultra 7 400D | 24C = 8P+12E+4LP | 8P+16E+bLLC-Die | 132 MB | 125W | bLLC-Modelle |

| P1K | Core Ultra 7 400K | 24C = 8P+12E+4LP | 8P+16E-Die | 33 MB | 65W/125W | teilweise K-Modelle |

| P1 | Core Ultra 7 400 | 16C = 4P+8E+4LP | 4P+8E-Die | 18 MB | 35W/65W | - |

| MS2K(F) | Core Ultra 5 400K/KF | 22C = 6P+12E+4LP | 8P+16E-Die | 27 MB | 65W/125W | teilweise K- und KF-Modelle |

| MS2 | Core Ultra 5 400 | 12C = 4P+4E+4LP | 4P+8E-Die | 18 MB | 35W/65W | - |

| MS1 | Core Ultra 5 400 | 8C = 4P+0E+4LP | 4P-Die | 12 MB | 35W/65W | - |

| T1 | Core Ultra 3 400 | 6C = 2P+0E+4LP | 4P-Die | 6 MB | 35W/65W | - |

| Hinweis: Angaben zu noch nicht offiziell vorgestellter Hardware basieren auf Gerüchten & Annahmen | ||||||

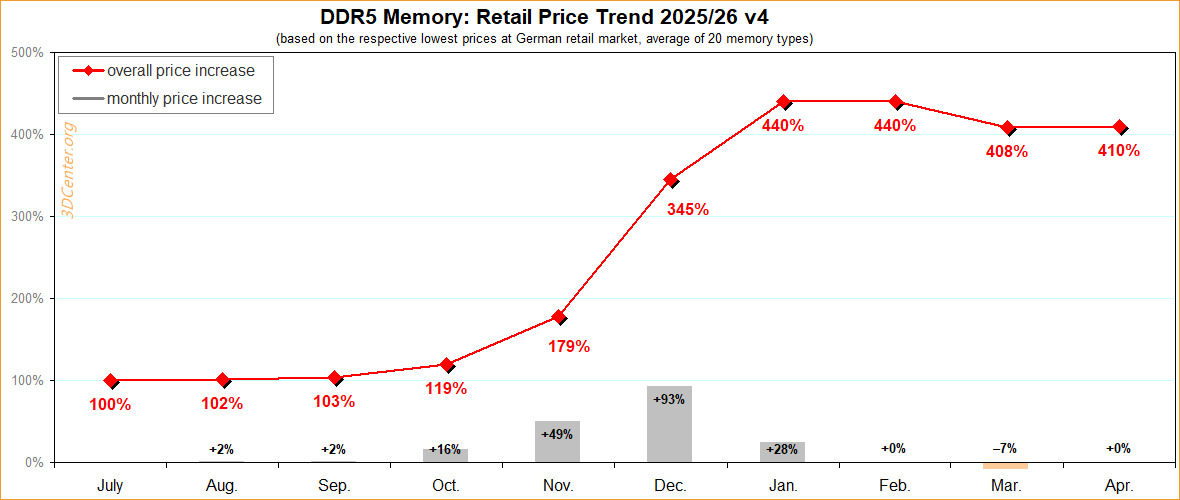

Neuer Artikel: Speicherkrise Preisindex April 2026

In wiederkehrender Aktualisierung des Speicherkrisen-Preisindex vom März soll nachfolgend erneut betrachtet wie auch dokumentiert werden, wie sich die Preise von DDR5, DDR3/4, SODIMM, internen SSDs & HDDs, externen Festplatten und Grafikkarten im deutschen Einzelhandel zwischen März und April 2026 sowie seit Sommer 2025 entwickelt haben. Zielsetzung ist es, zu klaren Zahlenwerten zu kommen, welche die hierbei auftretenden Preisübertreibungen für alle genannten Produktgruppen quantifizieren. Zugleich werden monatliche Steigerungsraten für jede Produktgruppe ermittelt, womit sich Anziehen und Abflauen von Preissteigerungen wie auch Preissenkungen belegen lassen. Abschließend wird auf Basis all dieser Daten der gesamte Verlauf der Preisveränderungen aller Produktgruppen von Beginn der Speicherkrise bis jetzt zusammengefasst in Diagramm-Form dargeboten ... zum Artikel.