Hauptlinks

Suche

Aktuelle Treiber

- 26.5.1

- 32.0.101.8737

- 596.36

News des 11. Mai 2026

Laut VideoCardz will AMD die Radeon RX 9000 Serie nun noch weiter in Mainstream-Gefilde hin ausdehnen, hierfür soll eine "Radeon RX 9050" auf Navi-44-Basis erscheinen. Jene Karte bringt interessanterweise den Vollausbau des Navi-44-Chips mit den vollen 32 Shader-Clustern am 128-Bit-Speicherinterface mit sich, augenscheinlich werden AMDs Salvage-Bedürfnisse allein mittels der üblicherweise nur im OEM-Segment verwendeten "Radeon RX 9060" (non-XT) bedient. Letztere Karte mit nur 28 Shader-Clustern scheint allerdings sehr wohl als Performance-Punkt für die Radeon RX 9050 gedient zu haben, denn mit den niedrigeren Taktraten selbiger erreichen beide Karten ziemlich exakt dieselbe (theoretische) FP32-Rechenleistung: 21,3 zu 21,4 TFlops. Da auch der Speichertakt (und somit die Speicherbandbreite) gleich liegen, dürfte die Radeon RX 9050 sehr wohl im Performance-Profil der Radeon RX 9060 herauskommen – und somit faktisch AMDs offizielle Lösung für diese Performance-Klasse darstellen.

| Radeon RX 9050 | Radeon RX 9060 | Radeon RX 9060 XT 8GB | GeForce RTX 5060 | |

|---|---|---|---|---|

| Chipbasis | AMD Navi 44 XT | AMD Navi 44 XL | AMD Navi 44 XT | nVidia GB206-250 |

| Hardware | 2 RE, 32 CU @ 128-bit, 32 MB IF$ | 2 RE, 28 CU @ 128-bit, 32 MB IF$ | 2 RE, 32 CU @ 128-bit, 32 MB IF$ | 3 RE, 30 SM @ 128-bit, 24 MB L2 |

| Taktraten | ?/1920/2600 MHz & 18 Gbps | 1700/2400/2990 MHz & 18 Gbps | 1700/2530/3130 MHz & 20,1 Gbps | 2280/2497 MHz & 28 Gbps |

| Rohleistungen | 21,3 TFlops & 288 GB/sec | 21,4 TFlops & 288 GB/sec | 25,6 TFlops & 322 GB/sec | 19,2 TFlops & 448 GB/sec |

| TDP | ? | 132W | 150W | 145W |

| Speicherausbau | 8 GB GDDR6 | 8 GB GDDR6 | 8 GB GDDR6 | 8 GB GDDR7 |

| FullHD Perf-Index | Richtung ~1600% | ~1610% | ~1840% | 1690% |

| Listenpreis | ? | rein OEM | $299 / 315€ | $299 / 319€ |

| Straßenpreis | ? | 330-380 Euro | 300-360 Euro | 290-330 Euro |

| Release | Sommer 2026 (?) | 5. August 2025 | 5. Juni 2025 | 19. Mai 2025 |

| Hinweis: Angaben zu noch nicht offiziell vorgestellter Hardware basieren auf Gerüchten & Annahmen | ||||

News des 9./10. Mai 2026

Abseits der GeForce RTX 5090, welche nunmehr mit der Marke von 4000 Euro liebäugelt, sind die Grafikkarten-Preise im deutschen Einzelhandel gemäß des jüngsten Marktüberblicks zumeist eher gesunken, zeigt sich inzwischen eine stetige Rückentwicklung der Preislagen zurück nahe der Ausgangslage vor der Speicherkrise. Anders formuliert konnten sich die Preisübertreibungen im Zuge der Speicherkrise im Grafikkarten-Markt nicht halten, gehen offenbar die Verkäufe so stark zurück, dass Händler & Hersteller in echte Absatznot geraten. Aktuell ging es von April zu Mai wieder um gemittelt –2 Prozentpunkte zurück, was monatlich nicht viel ist, aber vor allem gegenüber dem Höchststand der Preise (zumeist Februar) einen Unterschied macht. Gegenüber diesem Höchststand sind die deutschen Grafikkarten-Preise (für Produkte aktueller Generationen) derzeit im Schnitt bereits um 10 Prozentpunkte gefallen, grob gesehen wurde somit die Hälfte der maximalen Preisübertreibung bereits wieder abgetragen. Zugleich kann man auch sagen, dass ein Markt mit aktuell +12% überhöhten Preisen nun nicht gerade eine total überzogene Preislage hat – denn +12% mehr kann immer mal passieren, beispielsweise im Fall von Währungskapriolen oder akuten Lieferschwierigkeiten.

| Grafikkarten | Sept. | Dez. | Jan. | Feb. | März | Apr. | Mai. | max. Steig. | akt. Steig. | Diff. |

|---|---|---|---|---|---|---|---|---|---|---|

| Radeon RX 9060 XT 8GB | 279€ | 269€ | 311€ | 321€ | 335€ | 309€ | 298€ | +20% | +7% | –13PP |

| Radeon RX 9060 XT 16GB | 329€ | 349€ | 389€ | 438€ | 399€ | 389€ | 389€ | +33% | +18% | –15PP |

| Radeon RX 9070 16GB | 549€ | 529€ | 599€ | 613€ | 594€ | 566€ | 539€ | +12% | –2% | –14PP |

| Radeon RX 9070 XT 16GB | 639€ | 593€ | 671€ | 688€ | 655€ | 649€ | 636€ | +8% | ±0 | –8PP |

| Arc B570 10GB | 185€ | 217€ | 222€ | 217€ | 215€ | 223€ | 220€ | +21% | +19% | –2PP |

| Arc B580 12GB | 239€ | 239€ | 279€ | 278€ | 250€ | 259€ | 243€ | +17% | +2% | –15PP |

| GeForce RTX 5050 8GB | 232€ | 233€ | 250€ | 269€ | 257€ | 257€ | 261€ | +16% | +13% | –3PP |

| GeForce RTX 5060 8GB | 288€ | 277€ | 299€ | 324€ | 309€ | 299€ | 289€ | +13% | ±0 | –13PP |

| GeForce RTX 5060 Ti 8GB | 341€ | 348€ | 369€ | 394€ | 369€ | 319€ | 318€ | +16% | –7% | –23PP |

| GeForce RTX 5060 Ti 16GB | 416€ | 411€ | 483€ | 547€ | 540€ | 529€ | 529€ | +31% | +27% | –4PP |

| GeForce RTX 5070 12GB | 529€ | 526€ | 574€ | 619€ | 589€ | 579€ | 559€ | +17% | +6% | –11PP |

| GeForce RTX 5070 Ti 16GB | 766€ | 749€ | 849€ | 959€ | 929€ | 908€ | 889€ | +25% | +16% | –9PP |

| GeForce RTX 5080 16GB | 1027€ | 1009€ | 1238€ | 1259€ | 1219€ | 1189€ | 1169€ | +23% | +14% | –9PP |

| GeForce RTX 5090 32GB | 2319€ | 2689€ | 3079€ | 3280€ | 3365€ | 3539€ | 3499€ | +53% | +51% | –2PP |

| Preisindex (Ø 14 Produkte) | 100% | 101% | 114% | 120% | 116% | 114% | 112% | –10PP | ||

| Preisindex ohne 5090 (Ø 13 Prod.) | 100% | 100% | 112% | 119% | 114% | 111% | 109% | –11PP | ||

| jeweils günstigstes lieferbares Angebot im deutschen Einzelhandel gemäß Geizhals, Preisdatum jeweils Wochenende zur Monatsmitte (Mai-Preistand bereits 10. Mai) | ||||||||||

Neuer Artikel: Grafikkarten-Marktüberblick Mai 2026

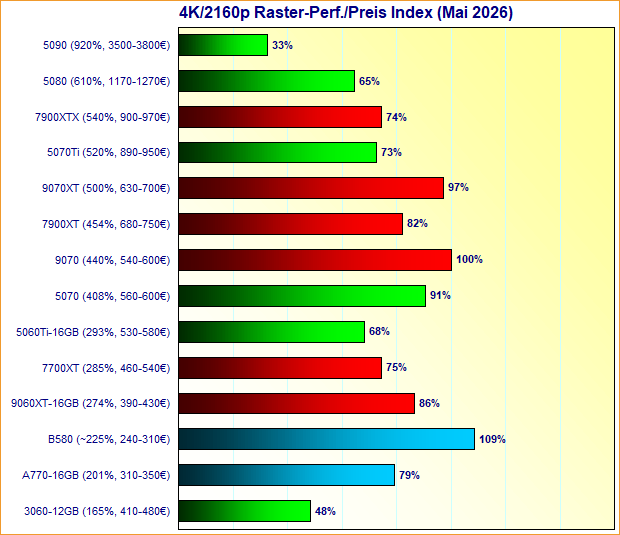

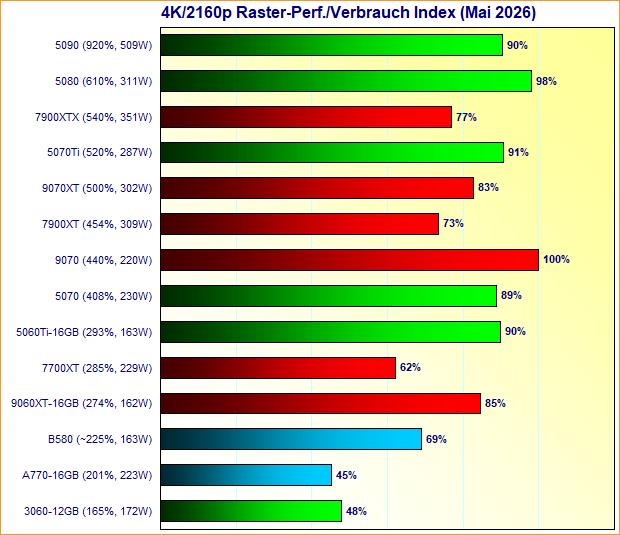

Seit dem letzten Grafikkarten-Marktüberblick vom März 2026 ist nicht zu viel Zeit vergangen, allerdings haben sich die Preise der meisten Grafikkarten doch wieder einigermaßen von den zwischenzeitlichen Übertreibungen der Speicherkrise beruhigt, so dass durchaus ein neuer Marktüberblick lohnt. Zugleich hat sich das Angebot allerdings erneut ausgedünnt, einige ältere Modelle sind aus dem Markt gegangen und bei weiteren steht selbiger Marktabschied nunmehr augenscheinlich bevor, gekennzeichnet durch zumeist nicht mehr attraktive Preislagen für diese Altmodelle. Interessanterweise gab es allerdings sogar einen Neuzugang im Marktangebot, etwas was man zuletzt (leider) gar nicht mehr gesehen hat. Wie sich das aktuelle Grafikkarten-Angebot von AMD, Intel und nVidia präsentiert und welche Performance/Preis-Verhältnisse wie Performance/Stromverbrauchs-Verhältnisse sich aus den aktuellen Marktpreisen ergeben, wird wie üblich nachfolgend dargelegt werden. ... zum Artikel.

News des 8. Mai 2026

WCCF Tech berichten über klar fallende Preise für AMD-Grafikkarten in China, speziell bezogen auf die China-exklusive Radeon RX 7650 GRE und aber auch die Radeon RX 9070 XT. Inzwischen sollen einige dieser Karten bereits unterhalb ihres (chinesischen) Listenpreises gehandelt werden, sprich die ansonsten den Grafikkarten-Markt innerhalb der Speicherkrise bisher kennzeichnende Preisübertreibung von ca. +20% wurde komplett abgetragen. Die Gründe für diesen Preisverfall werden leider nur gestreift, aber vermutlich ist es letztlich auch wie in der westlichen Welt: Die allgemeine Käuferzurückhaltung läßt den Absatz der Einzelhändler, Handelskette und Grafikkarten-Hersteller schrumpfen, jene geraten somit unter erheblichen Absatzdruck. Dazu passt, dass die Händlerpreise für AMD-Grafikkarten in China inzwischen sehr nahe dem Einkaufspreis liegen – ein Zeichen dafür, dass zu wenig abgesetzt wird und die Händler somit mit Macht ihre Ware in den Markt zu pressen versuchen. Die preisliche Situation im deutschen Einzelhandel bestätigt dieses Bild aus Fernost im übrigen sogar ziemlich gut, hinweisend auf einen allgemeinen, eher denn weltweit gültigen Effekt:

| Retail | Liste | Diff. | UVP | Diff. | |

|---|---|---|---|---|---|

| Radeon RX 9070 XT | ab 630€ | $599 (= aktuell 607€ mit MwSt) | +4% | 689€ | –9% |

| Radeon RX 9070 | ab 539€ | $549 (= aktuell 556€ mit MwSt) | –3% | 629€ | –14% |

| Radeon RX 9060 XT 16GB | ab 389€ | $349 (= aktuell 354€ mit MwSt) | +10% | 369€ | +5% |

| Radeon RX 9060 XT 8GB | ab 298€ | $299 (= aktuell 303€ mit MwSt) | –2% | 315€ | –5% |

| US-Preise immer ohne MwSt, Euro-Preise immer mit MwSt | |||||

News des 7. Mai 2026

Analyst Dan Nystedt @ X zeigt Prognosen zu Mainboard-Verkaufszahlen für die taiwanesischen Schwergewichte ASRock, Asus, Gigabyte und MSI, basierend auf einem Bericht der DigiTimes. Selbige sehen mit einem erwarteten Verkaufszahlen-Verlust von satten –30% im Jahr 2026 regelrecht schlecht aus, letztlich aber nur das manifestierend, was alle erwarten – richtig deutlich zurückgehende Absätze speziell im DIY-Segment. Die genannten Mainboard-Hersteller arbeiten zwar auch OEMs zu, dennoch haben die Hersteller von Komplett-PCs da auch noch andere Bezugsquellen bzw. lassen bei großen Serien die benötigten Mainboards auch gern von nicht am Retail-Markt agierenden Herstellern (ODMs) fertigen. Die gesamte aufgeführte Menge von 41,8 Millionen Desktop-Mainboards im Jahr 2025 entspricht dennoch ca. 70% aller im Jahr verkauften Desktop-PCs (~59 Mio., neben rund ~220 Mio. Notebooks), die hohe Marktbedeutung speziell der "großen Drei" Asus, Gigabyte und MSI für den Mainboard-Markt unterstreichend. Jene müssen sich 2026 augenscheinlich auf ein harsch zurückgehendes Geschäft mit Desktop-Mainboards einstellen – wie auch viele andere Hersteller des PC-Segments mit primärem Standbein im Retail- bzw. DIY-Geschäft.

| Mobo-Verkäufe | Auslieferungen 2025 | Prognose für 2026 | Differenz |

|---|---|---|---|

| ASRock | 4,3 Mio. | 2,7 Mio. | –37% |

| Asus | 15 Mio. | ~10 Mio. | –33% |

| Gigabyte | 11,5 Mio. | 8-8,5 Mio. | –26-30% |

| MSI | 11 Mio. | 8,4 Mio. | –24% |

| insgesamt | 41,8 Mio. | 29,1-29,6 Mio. | –29-30% |

| Daten gemäß Dan Nystedt @ X | |||

News des 6. Mai 2026

VideoCardz, ComputerBase und PC Games Hardware erinnern an die Ankündigung von GeForce GTX 1070 & 1080 vor genau 10 Jahren, welche den Startschuß der überaus erfolgreichen und beliebten Pascal-Generation gaben. Die seinerzeitige Ankündigung lieferte nur einen Teil der benötigten Daten, aber Launch-Reviews und Marktstart wurden dann in wenigen Wochen bis zum Mai-Ende komplett durchgezogen – es war eine Zeit, wo dies alles schneller wie zackiger lief. GeForce GTX 1070 & 1080 lieferten beiderseits neben Architektur-Verbesserungen auch eine verdoppelte Speichermenge von 4 auf 8 GB VRAM gegenüber ihren Vorgängern – womit diese Speicherbestückung von 8 GB somit seit dem Jahr 2016 bereits Standard im (seinerzeitigen) HighEnd-Segment ist. Zugleich gab es satte Performance-Gewinne im Rahmen von +54-71% für beide Karten, wobei sich dies bei den nachfolgenden Lösungen "GeForce GTX 1080 Ti" (Enthusiast) und "GeForce GTX 1060 6GB" (Midrange) genauso fortsetzte. Weil alles ziemlich "rund" war und die Karten auch noch eine ziemliche Langlebigkeit aufwiesen, hat die Pascal-Generation enorm zum guten Ruf nVidias unter Spielern beigetragen.

| GeForce GTX 1070 | GeForce GTX 1080 | |

|---|---|---|

| Chip-Basis | nVidia GP104, 7,2 Mrd. Transistoren in 16nm auf 314mm² Chipfläche | |

| Hardware | 3 RE, 15 SM (1920 SE) @ 256-bit | 4 RE, 20 SM (2560 SE) @ 256-bit |

| VRAM | 8 GB GDDR5 (+129% ggü GTX 970) | 8 GB GDDR5X (+100% ggü GTX 980) |

| TDP / Realverbrauch | 150W / 147W | 180W / 176W |

| FHD / 4K Perf-Index (zum Launch) | 800% / 107% | 960% / 132% |

| FHD / 4K Perf.-Gewinn (zum Launch) | +54% / +67% ggü. GTX 970 | +60% / +71% ggü. GTX 980 |

| Listenpreis (AIB / FE) | 379$ / 449$ | 599$ / 699$ |

| Ankündigung | 6. Mai 2016 | 6. Mai 2016 |

| Launch-Reviews | 30. Mai 2016 | 17. Mai 2016 |

| Marktstart | 10. Juni 2016 | 27. Mai 2016 |

Die AMD-Geschäftsergebnisse im ersten Quartal 2026

AMD hat nach Intel seine Geschäftszahlen für das abgelaufene erste Quartal 2026 vorgelegt. Für diesen Zeitraum hatte AMD vorab einen Quartalsumsatz von 9,8 Mrd. Dollar (±300 Mio. $) prognostiziert, was man nunmehr mit real 10,253 Mrd. Dollar leicht überboten hat. Gegenüber dem Vorjahreszeitraum ergibt sich auf Umsatz-Seite somit ein satter Zugewinn um +38%. Vor allem aber bemerkenswert ist, dass AMD damit nur marginal hinter dem Rekordergebnis des vorhergehenden vierten Jahresquartals 2026 durchs Ziel läuft, obwohl normalerweise erste Quartale bei AMD (und anderswo) klar schwächer als vierte Quartale ausfallen. Damit ist dann natürlich der Auftakt zu einem wohl ziemlich erfolgreichen Geschäftsjahr 2026 bereits gesetzt. Die Gewinnzahlen fallen im Vergleich zum Vorjahreszeitraum ähnlich hervorragend aus: +95% beim nominellen Gewinn sowie +43% beim operativen non-GAAP-Gewinn.

| Q1/2025 | Q2/2025 | Q3/2025 | Q4/2025 | Q1/2026 | |

|---|---|---|---|---|---|

| Umsatz | 7438 Mio. $ | 7685 Mio. $ | 9246 Mio. $ | 10'270 Mio. $ | 10'253 Mio. $ |

| (nomineller) Gewinn | 709 Mio. $ | 872 Mio. $ | 1243 Mio. $ | 1511 Mio. $ | 1383 Mio. $ |

| Bruttomarge | 50% | 40% | 52% | 54% | 53% |

| operativer non-GAAP-Gewinn | 1779 Mio. $ | 897 Mio. $ | 2238 Mio. $ | 2854 Mio. $ | 2540 Mio. $ |

News des 5. Mai 2026

Vom chinesischen Expreview kommt ein weiterer Spiele-Test zur Arc Pro B70 auf Basis von "Big Battlemage", wobei hier nun endlich direkt gegen andere Consumer-Grafikkarten verglichen wurde. Die TDP der benutzten Arc Pro B70 seitens Gunnir lag dabei mit 290 Watt auch ziemlich hoch und grob auf dem Niveau, wo eine (hypothetische) "Arc B770" zu erwarten wäre (während andere Arc Pro B70 teilweise auch "nur" mit 230W TDP antreten). Allerdings fallen die Ergebnisse der Performance-Messungen erneut nicht wirklich gut für den großen Battlemage-Chip aus: +32% unter Raster sowie +39% unter RayTracing auf der FullHD-Auflösung gegenüber der Arc B580 sind weniger, als man vom Technik-Sprung zwischen BMG-G21 (20 Xe2 @ 192-bit) und BMG-G31 (32 Xe2 @ 256-bit) erwarten konnte. Die etwas besser ausfallenden 3DMark-Ergebnisse von +46% zwischen Arc B580 und Arc Pro B70 zeigen dann darauf hin, dass die Rohleistung wohl durchaus vorhanden ist – aber dass Intel jene beim großen Battlemage-Chip (wieder einmal) nicht gänzlich auf die Straße bekommt.

| Hardware | 3DMarks | FHD Raster | FHD RayTr. | |

|---|---|---|---|---|

| GeForce RTX 5060 Ti 16GB | Blackwell, GB206, 36 SM @ 128-bit, 16 GB, 180W | 121% | 143% | 139% |

| (Gunnir) Arc Pro B70 | Battlemage, BMG-G31, 32 Xe2 @ 256-bit, 32 GB, 290W (für diese Gunnir-Karte) | 146% | 132% | 139% |

| Arc B580 | Battlemage, BMG-G21, 20 Xe2 @ 192-bit, 12 GB, 190W | 100% | 100% | 100% |

| gemäß der Benchmarks von Expreview mit 8 3DMark-Tests und jeweils 5 Spiele-Tests unter FullHD Raster & RayTracing | ||||

News des 4. Mai 2026

Tippgeber Gray @ X beschäftigt sich mit den zukünftigen Intel Prozessoren-Generationen, den hierfür angesetzten Kern-Architekturen, Sockeln und Produktausrichtungen auf Mobile- oder/und Desktop-Einsatz. Die Auflistung ist nicht perfekt, so wird der hier genannte "Cooper Shark" P-Kern für "Titan Lake" seitens Leaker Jaykihn vielmehr als ein E-Kern eingeordnet. Selbst dies ist aber noch nicht ganz feststehend – andere sagen, dass Intel hiermit seine "Unified Core" Architektur umsetzt und somit "Cooper Shark" sowohl P- als auch E-Kern darstellt. Andererseits ging die Tendenz in letzter Zeit eher in die Richtung, das "Unified Core" Projekt eher denn auf "Hammer Lake" zu verschieben – womöglich sogar inklusive der superhohen hierfür gemeldeten Kern-Anzahl von 48P+48E+4LPE (insgesamt 100 CPU-Kerne). Es würde wohl etwas gängiger aussehen, wenn Intel die Kern-Anzahl nicht so rasant von "Nova Lake" (bis zu 52 CPU-Kern) über "Razor Lake" schon zu "Titan Lake" auf 100 CPU-Kerne steigert, sondern wenn dies dann erst mit "Hammer Lake" (somit etwas später) passieren würde.

RZL is HX/S/WS

TTL is Mobile Only (U/H/P)

Quelle: Gray @ X am 30. April 2026

TTL is not desktop and it’s not unified, afaik.

HML is up in the air. Only NVL and RZL are known to be LGA1954.

Quelle: Jaykihn @ X am 15. April 2026

News des 2./3. Mai 2026

Tippgeber Haze @ X spricht über die weiteren Grafikkarten-Pläne bei Intel, nachdem die Xe3-Generation "Celestial" diesbezüglich bereits abgesägt wurde. Xe4 "Druid" ist hingegen noch in den Plänen Intels, mit derzeit zwei Hardware-Konfigurationen – wobei dies wahrscheinlich zwei verschiedene Grafikchips meint, nur zwei Grafikkarten auf Basis desselben Grafikchips wären schließlich etwas mager. Die eigentliche Problematik liegt aber wahrscheinlich darin, dass die Führungsebene bei Intel hier nach wie vor ein ernsthaft profitables Geschäft sehen will – so ein klein wenig oberhalb der schwarzen Null soll wohl nicht ausreichend sein. Dies ist allerdings eine schlechte Ausgangslage, wenn man als neuer dritter Marktteilnehmer sich erst einmal eine gewisse Position aufbauen will – und dann gleichzeitig regelmäßig mit zurückhängender Chipfertigung operiert, was Nachteile bei Chipgröße und Stromverbrauch mit sich bringt.

Xe4 has two discrete configs (as of right now) but depending on management decisions, it may or may not come out.

Top brass needs to see the discrete business as properly profitable, just being slightly profitable doesn't cut it.

There's way more money in integrated.

Quelle: Haze @ X am 25. April 2026