Hauptlinks

Suchen

Aktuelle Treiber

- 596.21

- 32.0.101.8724

- 26.3.1

News des 28./29. März 2026

Analyst Jukan @ X trägt die neuesten Prognosen der Marktforscher von TrendForce zum Speichermarkt bzw. den Speicherpreisen vor. Danach wurde die Prognosen für das erste und zweite Quartal nochmals deutlich angehoben, für das erste Quartal dürfte es dann natürlich schon streng in Richtung eines "Endstands" gehen. Leider fehlen ein paar erklärende Angaben, so dass man sich zusammenreimen muß, dass es sich hier kaum um Spotpreise handeln dürfte (schlecht vorab zu prognostizieren, außerdem in der Marktbedeutung viel zu gering), sondern um Kontraktpreise – und dass die Steigerungsraten aufs Quartal bezogen sein dürften. Insbesondere in der Addition früherer Preissteigerungen zu diesen neuerlichen Preissteigerungen kommen dann teilweise heftige Beträge heraus. Allerdings gilt nach wie vor, dass der Markt an Kontraktpreisen immer noch dem Spotmarkt hinterherzieht, letzterer ist einfach voll überkauft und daher preislich viel weiter übertrieben.

| TrendForce-Prognosen | Q1/2026 | Q2/2026 |

|---|---|---|

| PC DRAM | +50-55% → +110-115% | +10-15% → +40-45% |

| Server DRAM | +60-65% → +93-98% | +10-15% → +43-48% |

| Mobile DRAM | +45-50% → +58-63% | +13-18% → +58-63% |

| eSSD | +33-38% → +75-80% | +15-20% → +68-73% |

| TLC/QLC | +30-35% → +75-80% | +15-20% → +60-65% |

| prognostizierte Preisänderungen am Speichermarkt gemäß TrendForce, wiedergegeben von Jukan @ X | ||

News des 27. März 2026

VideoCardz berichten über Hinweise auf eine mögliche (größere) nVidia-Keynote zur Computex 2026. Noch ist dies nicht offiziell, aber der nVidia-CEO hatte sich bereits in diese Richtung hin geäußert und zugleich bucht nVidia augenscheinlich einige Kapazitäten an Versammlungsräumen. Generell dürfte die Computex mit einiger Sicherheit eine Vorstellung oder wenigstens Ankündigung der N1-Serie an MediaTek/nVidia WoA-SoCs mit sich bringen – zumindest dann, wenn MediaTek & nVidia selbige noch vor Jahresende in den Markt bringen wollen. Auch von AMD fehlt noch konkretes, obwohl hier genauso die Computex als fast idealer Zeitpunkt gelten dürfte, um die im Sommer/Herbst zu erwartende "Zen 6" Architektur vorzustellen. Gesicherte Computex-Keynotes sind hingegen bei Intel & Qualcomm angekündigt, jeweils mit den CEOs, letztgenannte als die offizielle Eröffnungs-Keynote der Computex 2026.

|

News des 26. März 2026

AMD hat den "Ryzen 9 9950X3D2" nun endlich mittels Twitter/X-Posting sowie Produkt-Webseite vorgestellt, wenngleich beim offiziellen Produktnamen da noch ein "Dual Edition" mit drangepflascht wurde. An den bislang schon bekannten technischen Daten ändert sich nichts bzw. bestätigen sich hiermit die Vorabmeldungen. Fehlend ist weiterhin die Angabe des PPT, was wegen der auf 200 Watt erhöhten TDP durchaus eine wichtige Information wäre. Die normale Regel "PPT = TDP * 1,35" dürfte AMD hier wahrscheinlich nicht anwenden, dies war schon beim regulären Ryzen 9 9950X3D nicht der Fall. Ebenfalls fehlend ist noch ein Listenpreis für den am 22. April offiziell erscheinenden Spitzen-Prozessor, für welchen sich AMD gemäß bei WCCF Tech zu sehenden Benchmarkfolien +5-13% mehr Anwendungsperformance erwartet.

| AMD Zen 5 X3D | Kerne | L2+L3 | 3DVC | Takt | iGPU | OC | TDP/PPT | Listenpreis | Retail | Release |

|---|---|---|---|---|---|---|---|---|---|---|

| Ryzen 9 9950X3D2 | 16C/32T | 16+64 MB | 128 MB | 4.3/5.6 GHz | ✓ | ✓ | 200/?W | ? | ? | 22. April 2026 |

| Ryzen 9 9950X3D | 16C/32T | 16+64 MB | 64 MB | 4.3/5.7 GHz | ✓ | ✓ | 170/200W | $699 / 769€ | ab 629€ | 12. März 2025 |

| Ryzen 9 9900X3D | 12C/24T | 12+64 MB | 64 MB | 4.4/5.5 GHz | ✓ | ✓ | 120/162W | $599 / 659€ | ab 532€ | 12. März 2025 |

| Ryzen 7 9850X3D | 8C/16T | 8+32 MB | 64 MB | 4.7/5.6 GHz | ✓ | ✓ | 120/162W | $499 / 499€ | ab 458€ | 29. Jan. 2026 |

| Ryzen 7 9800X3D | 8C/16T | 8+32 MB | 64 MB | 4.7/5.2 GHz | ✓ | ✓ | 120/162W | $479 / 529€ | ab 415€ | 7. Nov. 2024 |

| Ryzen 5 9600X3D | 6C/12T | 8+32 MB | 64 MB | ? | ? | ? | ? | ? | ? | komplett unbestimmt |

| Hinweis: Angaben zu noch nicht offiziell vorgestellter Hardware basieren auf Gerüchten & Annahmen | ||||||||||

News des 25. März 2026

Intel hat in Form von Arc Pro B65 & Arc B70 die ersten Grafikkarten auf Basis des großen Battlemage-Grafikchips "BMG-G31" vorgestellt, welcher fast anderthalb Jahre nach Release des kleineren BMG-G21 nun doch noch veröffentlicht wird. Die beiden neuen Grafikkarten sind rein für den Profi-Bereich gedacht, zu erkennen an der VRAM-Bestückung mit jeweils 32 GB GDDR6 sowie dem Preispunkt der Arc Pro B70 von 949 Dollar. Letztere kommt im Vollausbau des BMG-G31-Chips daher, die Arc Pro B65 ist hingegen eine heftige Abspeckung: Es geht von 32 auf 20 Shader-Cluster herunter, allerdings bleibt das Speicherinterface gleich bei 256-Bit, damit weiterhin die Speichermenge von 32 GB daran angeschlossen werden kann. Ob und wann Intel den BMG-G31 Grafikchip dann noch für Consumer-Varianten nutzt, bleibt weiterhin offen, zuletzt gab es in diese Richtung hin keinerlei Aktivitäten und könnte Intel dies aus Sicht der Beschaffungskosten des GDDR6-Speichers auch schlicht zu wenig wirtschaftlich sein.

| Arc B570 | Arc B580 | "Arc B770" | Arc Pro B65 | Arc Pro B70 | |

|---|---|---|---|---|---|

| Chipbasis | BMG-G21 | BMG-G21 | BMG-G31 | BMG-G31 | BMG-G31 |

| Hardware | 18 Xe2 @ 160-bit, 13,5 MB L2 | 20 Xe2 @ 192-bit, 18 MB L2 | 32 Xe2 @ 256-bit, 24 MB L2 | 20 Xe2 @ 256-bit, ? MB L2 | 32 Xe2 @ 256-bit, 24 MB L2 |

| Speicher | 10 GB GDDR6 | 12 GB GDDR6 | 16 GB GDDR6 | 32 GB GDDR6 | 32 GB GDDR6 |

| TDP | 150W | 190W | 300W (?) | 200W | 230W |

| FHD Perf.Index | 1250% | 1460% | ? | – | – |

| 4K Perf.Index | ~189% | ~225% | ? | – | – |

| Listenpreis | $219 | $249 | ? | ? | $949 |

| Release | 16. Januar 2025 | 13. Dezember 2024 | 2026 (???) | Mitte April 2026 | 24. April 2026 |

| Hinweis: Angaben zu noch nicht offiziell vorgestellter Hardware basieren auf Gerüchten & Annahmen | |||||

News des 24. März 2026

Weit beachtet werden derzeit Asus-Aussagen über weitere Preiserhöhungen bei Komplett-PCs & Notebooks, welche im zweiten Quartal sogar bei +25-30% liegen sollen. Die beiden Quellen Ctee und UDN sind sich allerdings nicht ganz einig darüber, ob diese Prozentzahlen nur für Asus selber oder auch die anderen PC-Hersteller (in dieser Höhe) gelten sollen. Auch gelten jene Preiserhöhungen nominell nur für den taiwanesischen Markt – wobei bei beiden Gegenargumenten gilt, dass sich kein Hersteller und kein Teilmarkt wirklich frei vom weltweiten Geschehen machen kann und daher in diesem Geschäft alles mit kleineren Abschlägen letztlich weltweit ähnlich ablaufen dürfte. Zu beachten wäre hierbei allerdings, dass der Markt der Komplett-Geräte dem Speichermarkt bei der Preisgestaltung bzw. der Einarbeitung der höheren Speicherpreise prinzipiell hinterher läuft.

Liao Yi-hsiang, General Manager des Systems Business von Asus United Technology, erklärte am 23., dass mit Blick auf den taiwanesischen Markt verschiedene Marken voraussichtlich die Preise um weitere 25–30% anheben werden, wobei im dritten Quartal mit weiteren Erhöhungen zu rechnen sei.

Quelle: Ctee am 24. März 2026 (maschinell übersetzt ins Deutsche)

Asus kündigte gestern eine deutliche Preiserhöhung für seine PCs im zweiten Quartal an, die bis zu 30% betragen soll. Auch Acer, MSI und Gigabyte werden voraussichtlich die Preise anheben, mit durchschnittlichen Erhöhungen im zweistelligen Prozentbereich.

Quelle: UDN am 24. März 2026 (maschinell übersetzt ins Deutsche)

News des 23. März 2026

nVidia-CEO Jensen Huang hat im Podcast von Lex Fridman @ YouTube erneut zur andauernden Kontroverse über DLSS5 Stellung genommen und dabei versucht, ein wenig die Wogen gegenüber seiner vorherigen Kritik-Erwiderung zu glätten. Leider bleibt es beim Versuch, mit dem letzten Satz reißt es der nVidia-Chef wieder ein: Denn natürlich wirkt DLSS5 wie eben doch ein Instagram-Filter – völlig egal ob dies nicht derart geplant war oder von der Technik her "unmöglich" sein sollte. Letzteres ist sowieso eine gewagte Aussage, denn am Ende konnte die dahinterliegende Bildverbesserungs-KI kaum mit PC-Spielen trainieren (jene sollen ja verbessert, nicht nachgeahmt werden), sondern natürlich nur mit realen Personen. Und da ergibt sich immer der Effekt der unbewußten Vereinheitlichung sowie Instagram-typischen Verschönerung, dies läßt sich wegen der grundsätzlichen Funktionsweise dieser KI-Bildverbesserer gar nicht unterbinden.

I think their perspective makes sense. And I could see where they're coming from, because I don't love AI slop myself. You know, all of the AI-generated content increasingly looks similar, and they're all beautiful ... I'm empathic toward what they're thinking. That's just not what DLSS5 is trying to do.

Quelle: nVidia-CEO Jensen Huang bei Lex Fridman @ YouTube am 23. März 2026

Intel Arrow Lake Refresh: Die Launch-Reviews gehen online

Bisher hat Intels "Arrow Lake" aka die Core 200 Serie auf dem Desktop wenig gezündet, trotz nachträglicher Performance-Verbesserungen und inzwischen klar günstigerer Preislagen. Nun wagt Intel einen neuen Anlauf in Form zweier Refresh-Modelle, welche mit klar mehr Technik und sogar abgesenktem Listenpreis dieses Bild ändern sollen – Core Ultra 5 250K Plus und Core Ultra 7 270K Plus. Zu Preislagen von 199 bzw. 299 Dollar gibt es hier in jedem Fall richtig viele CPU-Kerne (18 bzw. 24) fürs Geld, sollte die Sache zumindest aus dem Blickwinkel der Allround-Performance interessant sein. Derzeit füllen die Launch-Reviews der bekannten Hardware-Tester das Web, kann im 3DC-Forum über jenen Refresh diskutiert werden und wird dies sicherlich noch Thema einer Launch-Analyse sein, mittels welcher der Blick auf diese "normalen" PC-Prozessoren außerhalb der X3D-Modelle grundsätzlich erneuert wird.

| ARL Desktop | Kerne | P-Takt | E-Takt | L2+L3 | iGPU | PBP/MTP | Liste | Straße | Release |

|---|---|---|---|---|---|---|---|---|---|

| Core Ultra 9 285K | 8P+16E/24T | 3.7/5.7 GHz | 3.2/4.6 GHz | 40+36 MB | 4 Xe-LPG @ ≤2.0 GHz | 125/250W | $589 | ab 502€ | 25. Okt. 2024 |

| Core Ultra 7 270K Plus | 8P+16E/24T | 3.7/5.5 GHz | 3.2/4.7 GHz | 40+36 MB | 4 Xe-LPG | 125/250W | $299 | ? | 26. März 2026 |

| Core Ultra 7 265K | 8P+12E/20T | 3.9/5.5 GHz | 3.3/4.6 GHz | 36+30 MB | 4 Xe-LPG @ ≤2.0 GHz | 125/250W | $394 | ab 282€ | 25. Okt. 2024 |

| Core Ultra 5 250K Plus | 6P+12E/18T | 4.2/5.3 GHz | 3.5/4.7 GHz | 30+30 MB | 4 Xe-LPG | 125/159W | $199 | ? | 26. März 2026 |

| Core Ultra 5 245K | 6P+8E/14T | 4.2/5.2 GHz | 3.6/4.6 GHz | 26+24 MB | 4 Xe-LPG @ ≤1.9 GHz | 125/159W | $309 | ab 177€ | 25. Okt. 2024 |

News des 21./22. März 2026

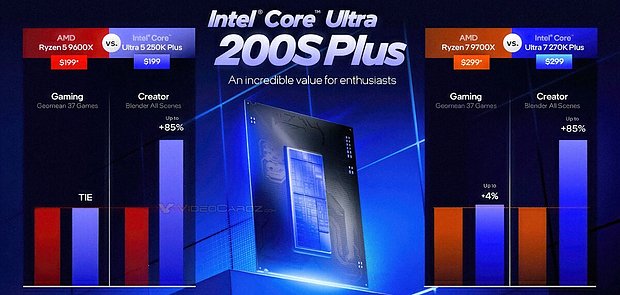

VideoCardz zeigen eine aktualisierte Präsentationsfolie zum Arrow-Lake-Refresh "Core Ultra 200S Plus", welcher die beiden neuen Prozessoren-Modelle nicht mit ihren Arrow-Lake-Vorgängern, sondern den im gleichen Preisbereich befindlichen Zen-5-Prozessoren vergleicht. Im konkreten sind dies somit die Vergleiche Core Ultra 5 250K Plus gegen Ryzen 5 9600X sowie Core Ultra 7 270K Plus gegen Ryzen 7 9700X, wobei die AMD-Prozessoren zum tatsächlichen Straßenpreis passend ausgesucht wurden, ein Vergleich per Listenpreis würde hier nichts bringen (da die AMD-Prozessoren inzwischen klar unterhalb selbigem angeboten werden). Mit diesem Vergleich nimmt Intel für sich in Anspruch, klar führend bei der "Creator"-Performance zu sein sowie bei der Spiele-Performance einen Gleichstand zu erzielen. Dies wird halbwegs hinkommen, wobei der Intel-Vorteil unter allen Anwendungs-Programmen vermutlich (klar) kleiner ausfallen dürfte – aber weiterhin vorhanden sein sollte.