Hauptlinks

Suche

Aktuelle Treiber

- 26.5.2

- 32.0.101.8801

- 596.49

Neuer Artikel: Speicherkrise Preisindex April 2026

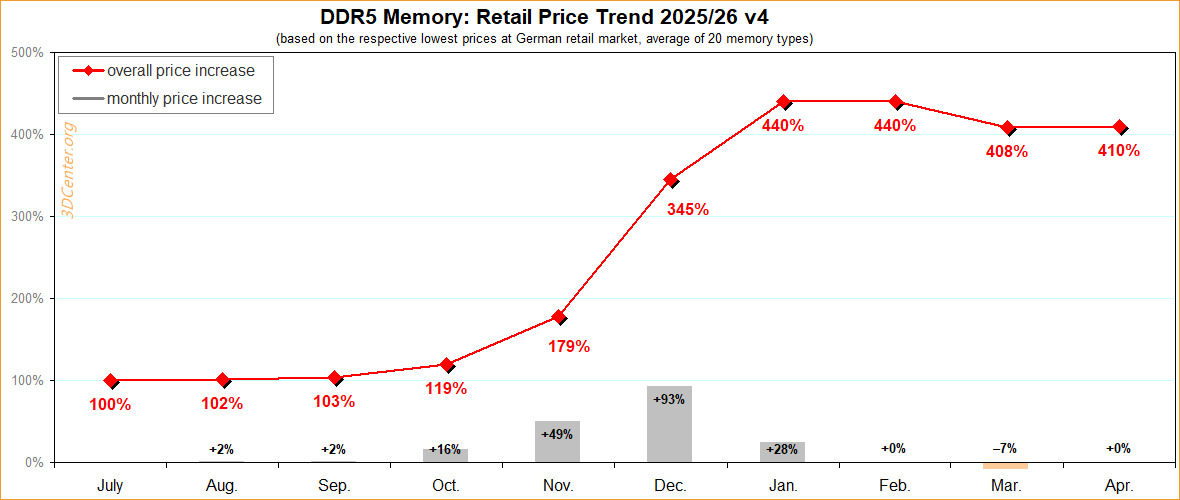

In wiederkehrender Aktualisierung des Speicherkrisen-Preisindex vom März soll nachfolgend erneut betrachtet wie auch dokumentiert werden, wie sich die Preise von DDR5, DDR3/4, SODIMM, internen SSDs & HDDs, externen Festplatten und Grafikkarten im deutschen Einzelhandel zwischen März und April 2026 sowie seit Sommer 2025 entwickelt haben. Zielsetzung ist es, zu klaren Zahlenwerten zu kommen, welche die hierbei auftretenden Preisübertreibungen für alle genannten Produktgruppen quantifizieren. Zugleich werden monatliche Steigerungsraten für jede Produktgruppe ermittelt, womit sich Anziehen und Abflauen von Preissteigerungen wie auch Preissenkungen belegen lassen. Abschließend wird auf Basis all dieser Daten der gesamte Verlauf der Preisveränderungen aller Produktgruppen von Beginn der Speicherkrise bis jetzt zusammengefasst in Diagramm-Form dargeboten ... zum Artikel.