Hauptlinks

Suchen

Top-News

Neuer Artikel: Launch-Analyse AMD Ryzen 3 3100 & 3300X

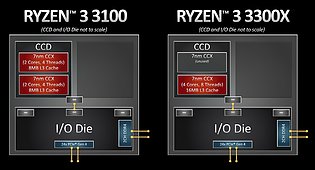

Am 21. Mai wird AMD (wie am 21. April angekündigt) die beiden Zen-2-basierten Vierkern-Prozessoren "Ryzen 3 3100" und "Ryzen 3 3300X" in den Markt entlassen. Bereits am 7. Mai fiel das NDA für die unabhängigen Benchmarks, worauf eine beachtliche Anzahl an Hardware-Tests für diese beiden Einsteiger-Prozessoren veröffentlich wurde. Normalerweise wird Einsteiger-Hardware nicht so breit betrachtet, aber zum einen war man wohl über diesen Hardware-Launch in einer ansonsten Launch-abstinenten Zeit dankbar, zum anderen haben die beiden Ryzen-3-Prozessoren diese breite Betrachtung durchaus verdient, wie nachfolgend noch zu sehen. Mit dieser (kurzen) Launch-Analyse soll in erster Linie herausgearbeitet werden, welches Performance-Bild unter Anwendungs- und Spiele-Benchmarks zu Ryzen 3 3100 & 3300X die Hardware-Tester im einzelnen sowie auch über alle 23 ausgewerteten Launch-Reviews zusammengefasst aufzeigen können ... zum Artikel.

AMDs Zen 4 bringt im Jahr 2022 den Support für USB4 und DDR5-Speicher

Gamers Nexus haben eine interne AMD-Roadmap vorliegen, welche Auskunft über AMDs Pläne zu DDR5, USB4 & PCI Express für den Consumer-Bereich gibt. 2022 wird diesbezüglich das spannende Jahr, denn DDR5-Speicher soll dann von AMDs "Premium Desktop Lineup" unterstützt werden – höchstwahrscheinlich innerhalb der Zen-4-Generation. Mit der genannten Formulierung könnte dann das HEDT-Segment gemeint sein – was in jedem Fall sinnig erscheint, da die (nicht erwähnten) Server-Prozessoren höchstwahrscheinlich zuerst auf DDR5 wechseln (was schon länger vermutet wird). Ein gewisse Chance, das AMD hiermit auch DDR5-Speicher ins "normale" Consumer-Segment bringt, besteht aber trotzdem – dies bleibt dann abzuwarten. Gleichfalls wird es hiermit den nativen Support von USB4 geben, während für PCI Express 5.0 eine Absage erteilt wurde – dies steht nicht auf AMDs Plänen bis einschließlich des Jahres 2022 (mit natürlich einer Seitenchance, das dies im Server-Segment vielleicht doch wieder anders ist). Zudem sollen auch die 2022er AMD-APUs DDR5-Speicher unterstützen, interessanterweise wurden jene als allerdings "Zen 3+" notiert.

2022 is the year that AMD is intending to get DDR5 into its premium desktop lineup. The 2022 platform will retain PCIe4 and will likely be a Zen4 product, also intended to feature native USB4 support. The APUs for that year also presently have DDR5 on the roadmap and are listed as Zen3+ parts. The mobile roadmap has DDR5 LP5 on-board for 2022 in the premium and gaming lines.

Quelle: Gamers Nexus am 26. April 2020

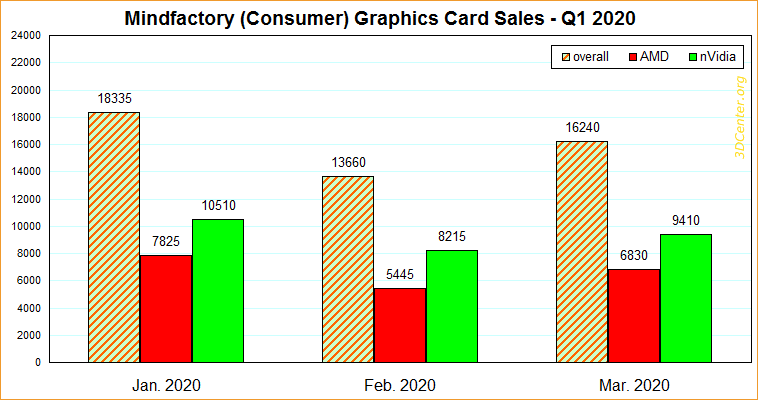

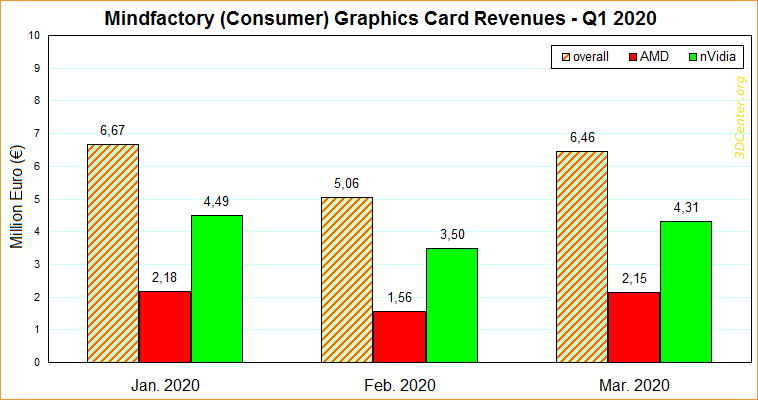

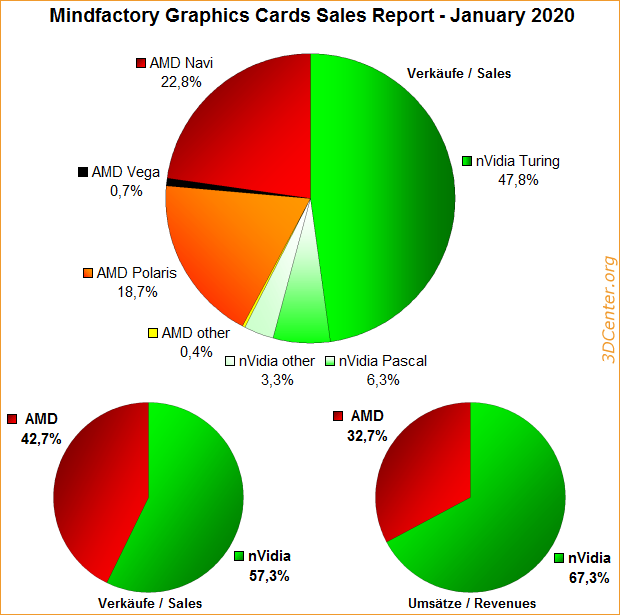

Neuer Artikel: Mindfactory Grafikkarten Retail-Verkaufsreport Q1/2020

Nach dem ersten Versuch eines Grafikkarten-Verkaufsreports für das Retail-Segment zum Januar 2020 folgt nunmehr die "richtige" Ausgabe, welche die Grafikkarten-Verkäufe des gesamten ersten Quartals 2020 umfasst. Die Basis dieser Auswertung ergab sich wiederum aus jenen Daten, welche der deutsche Einzelhändler Mindfactory öffentlich zu seinen Grafikkarten-Verkäufen des Consumer-Segments bekanntgibt – was mit einem Quartals-Absatz von 48.000 AMD- und nVidia-Grafikkarten zu einem Verkaufswert von über 18 Millionen Euro nicht gerade wenig ist. Über die nunmehr bereits mehrfach erfolgte (interne) monatliche Auswertung ergibt sich inzwischen auch ein besseres "Gefühl" für diese Daten, deren übliche Schwankungsbreite und generelle Belastbarkeit. Basierend auf der vorhandenen (großen) Datenmenge lassen sich somit sicherlich relevante Aussagen zum Retail-Grafikkartenmarkt in Mitteleuropa treffen ... zum Artikel.

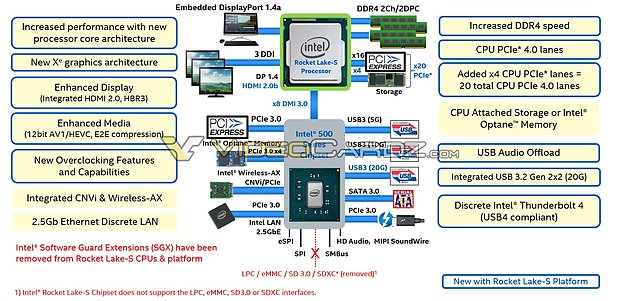

Intels "Rocket Lake" kommt 2021 mit neuer Prozessoren-Architektur, Xe-Grafik und PCI Express 4.0

Videocardz geben ein (augenscheinlich von Intel stammendes) Plattform-Blockdiagramm zu Intels "Rocket Lake" zum besten, welche viele der bisherigen Annahmen & Gerüchte zu dieser "Comet Lake" nachfolgenden Prozessoren-Generation bestätigt. So wird endlich klar ausgesprochen, das Rocket Lake CPU-seitig auf einer neuen Core-Architektur basiert, GPU-seitig eine Xe-basierte Grafiklösung gemäß Intels 12. Grafik-Generation geboten wird und die Rocket-Lake-CPU letztendlich über ein PCI Express 4.0 Interface mit 20 Lanes zur Kommunikation mit den Grafikkarten sowie der ersten NVMe-SSD ausgerüstet erscheint. Dabei wird die "neue Core-Architektur" von Intels Plattform-Blockdiagramm nicht genauer ausgeführt, doch aller Wahrscheinlichkeit nach handelt es sich hierbei um die auch bei der Tiger-Lake-Generation verbauten "Willow Cove" CPU-Kerne, viele andere Möglichkeiten existieren gemäß Intels gültiger Kern-Roadmap schließlich nicht.

Gerüchteküche: Gaming-Ampere wieder nur mit ca. +35% Mehrperformance, dafür aber RTX für alle

Von den Twitterern KittyKitties und Kopite7kimi kommt der nächste Schwung an Gerüchten zu nVidias Gaming-Ampere – mit natürlich unsicherer, da nicht genauer ausgeführter Quellenlage. So beschreibt KittyKitties den erwarteten Enthusiasten-Chip "GA102" als denn schwerlich +40% schneller als eine GeForce GTX 2080 Ti – und in jedem Fall soll es unterhalb dieses Performancesprungs liegen, wenn man auf Chip-Basis gegenüber einem vollen TU102-Chip vergleicht (die GeForce RTX 2080 Ti stellt schließlich auch nicht den Vollausbau des TU102-Chips dar). Kopite7kimi schlägt in die gleiche Kerbe und nennt eine "GeForce RTX 3090" (augenscheinlich eine neue Namenswahl anstatt der bisherigen Ti-Modelle) als wahrscheinlich mit "nur" 4992 Shader-Einheiten ausgerüstet. Dies wären gerade einmal +15% mehr Shader-Einheiten als bei der GeForce RXT 2080 Ti, was demzufolge dann noch mittels Mehrtakt samt Architektur-Verbesserungen aufzuhübschen wäre – damit aber voraussichtlich doch unterhalb den vorgenannten (maximal) +40% Performance-Gewinn bleibt bzw. diese Marke in jedem Fall nicht gerade gravierend schlägt.

1. Surprisingly, the next gen chip will be based on Samsung 10nm node

2. Not very solid about what GA102 really got, may struggle to be 40% above 2080Ti, but bound to be under that number if compared against full bore TU102

3. SLi will be available to GA102 ONLY

4. RTX for everyone

Quelle: KittyKitties @ Twitter am 11. März 2020

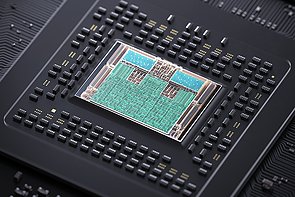

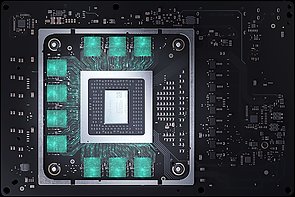

Sony gibt die Hardware-Spezifikationen der Playstation 5 bekannt

Nach Microsoft hat nun auch Sony die mehr oder weniger vollständigen Hardware-Spezifikationen seiner NextGen-Konsole "Playstation 5" im Rahmen eines Videostream-Events bekanntgegeben. Eigentlich sollte diese Vorstellung auf der (nunmehr abgesagten) GDC erfolgen – war insofern wohl lange vorher geplant und ist demzufolge keine Reaktion auf die kürzliche Microsoft-Offenlegung der Xbox Series X. Gegenüber dieser hat es die Playstation 5 derzeit in den Augen der Öffentlichkeit schwer, da man mit der Playstation 5 unterhalb der Hardware-Daten der Microsoft-Konsole herauskommt: Bei der CPU ergibt sich noch ein grober Gleichstand, aber die GPU ist mit nur 36 Shader-Clustern und bis zu 10,3 TFlops Rechenleistung an einem 256 Bit GDDR6-Interface doch augenscheinlich kleiner ausgelegt als beim Microsoft-Pendant mit 52 Shader-Clustern auf 12,1 TFlops Rechenleistung an einem 320 Bit GDDR6-Interface.

| Sony Playstation 5 | Microsoft Xbox Series X | |

|---|---|---|

| Prozessor | 8C/16T Zen 2 @ ≤3.5 GHz | 8C/16T Zen 2 @ 3.6 GHz (ohne SMT @ 3.8 GHz) |

| Grafiklösung | 36 CU RDNA2 @ ≤2.23 GHz (≤10,3 TFlops) | 52 CU RDNA2 @ 1.825 GHz (12,1 TFlops) |

| Speicherinterface | 256 Bit GDDR6 @ 3500 MHz QDR (448 GB/sec) | 320 Bit GDDR6 @ 3500 MHz QDR (Ø 476 GB/sec) |

| Speicher | 16 GB GDDR6 | 16 GB GDDR6 (13,5 GB für Spiele) |

| Festplatte | 825 GB NVMe-SSD @ 5,5 GB/sec (8-9 GB/sec mit Kompression) | 1 TB NVMe-SSD @ 2,4 GB/sec (4,8 GB/sec mit Kompression) |

| Preislage | ??? | ??? |

| Release | "Holiday Season" 2020 | "Holiday Season" 2020 |

Microsoft gibt die vollständigen Spezifikationen der Xbox Series X bekannt

Nach der bereits weitgehenden Microsoft-Offenlegung Ende Februar zur Technik der kommenden Spielekonsole "Xbox Series X" haben Microsoft im eigenen Xbox-Blog sowie Eurogamer mittels eines unter Mithilfe von Microsoft entstandenden Artikels die Konsolen-Spezifikationen nun nochmals genauer ausgeführt – und dabei insbesondere die bestehenden Wissenlücken bei CPU, Speicherinterface und Speichermenge geschlossen. Somit präsentiert sich der SoC der Xbox Series X nunmehr als ein 360mm² großer Chip mit 15,3 Mrd. Transistoren unter der N7P-Fertigung von TSMC – hierbei kommt also noch keine EUV-Belichtung zum Einsatz, sondern "nur" das zweitbeste der drei 7nm-Verfahren von TSMC. In diese nahe der Xbox One X kommende Chipfläche quetschen AMD und Microsoft dann 8 CPU-Kerne auf Basis von Zen 2 samt SMT auf Taktraten von 3.8 GHz sowie eine RDNA2-basierte Grafiklösung mit 52 Shader-Clustern (aka 3328 Shader-Einheiten) auf 1825 MHz GPU-Takt – was dann 12,1 TFlops FP32-Rechenleistung ergibt und damit früheren Microsoft-Vorgaben entspricht.

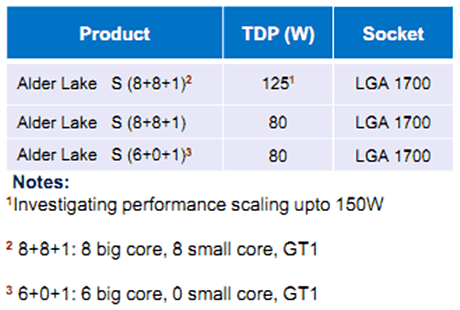

Intels Alder-Lake-Generation soll mit bis zu 16 CPU-Kernen im big.LITTLE-Design antreten

In einer Diskussion im chinesischen PTT-Forum hat der bekannter Nutzer "Sharkbay" einen Teil einer (angeblichen) Intel-Unterlage zu Intels Prozessoren-Generation "Alder Lake" zum besten gegeben (direkt auf Imgur aufrufbar, via Videocardz). Folgt man den dortigen Angaben, dann kommt jene "Alder Lake" Prozessoren-Generation im neuen Sockel LGA 1700 in einem big.LITTLE-Design heraus – mit also zum Teil leistungsstarken Prozessoren-Kernen aus (wahrscheinlich) Intels "Cove" Kern-Reihe (verbaut bei den "Core"-Prozessoren) und zum Teil sehr stromsparenden Prozessoren-Kernen aus (wahrscheinlich) Intels "Mont" Kern-Reihe (verbaut bei allen LowPower-Prozessoren, früher die "Atom"-Linie). Konkret werden hierbei Desktop-Prozessoren von "Alder Lake-S" mit bis zu 8 Cove- sowie gleichzeitig bis zu 8 Mont-Kernen als augenscheinlichem Maximal-Ausbau genannt, kleinere Prozessoren-Versionen verzichten dann teilweise auf einige Cove- bzw. teilweise auch auf alle Mont-Kerne:

Performance-Entwicklung und Performance/Preis-Verhältnisse von nVidias 250-Dollar-Grafikkarten 2010-2019

Aus unserem Forum kam noch letzten Herbst die Anregung, eine seinerzeitige Gegenüberstellung der GeForce GTX 1660 Super mit gleich schnellen älteren nVidia-Karten erneut aufzulegen – nunmehr aber Preis- und nicht Performance-basiert. Mit etwas Herumkramen in den Archiven war dieser Anregung nachzukommen – leider geht es nicht unterhalb der GeForce-200-Generation, weil sich dann die verfügbaren Informationen über die offiziellen Listenpreise immer mehr verflüchtigen. Die nachfolgende Aufstellung macht somit kenntlich, was nVidia im Preissegment von 200 bis 250 Dollar über die letzte Dekade so angeboten hat. Dabei gab es teils beachtbare Unterschiede zwischen Karten zu 199$ und 249$ Listenpreis – letztere haben oftmals deutlich höhere Stromverbrauchswerte, basieren dann gern (nicht immer) auf einem viel größeren Grafikchip bzw. nicht auf einem explizit für dieses Preissegment aufgelegten Chip. Besonders deutlich ist dies bei der GT200b-basierten GeForce GTX 275 zu sehen, welche nur zum Zweck des Preiskampfs mit ATIs Radeon HD 4890 veröffentlicht und dann auf die seinerzeit notwendige Preislage heruntergebracht wurde.

| Architektur | Release | FHD-Perf. | Realverbr. | Liste | Perf./Preis | P/P per Jahr | |

|---|---|---|---|---|---|---|---|

| GeForce GTX 275 | Tesla 2 (55nm) | 2. April 2009 | ~140% | 178W | 249$ | 100% | - |

| GeForce GTX 460 1GB | Fermi (40nm) | 12. Juli 2010 | 160% | 113W | 229$ | 119% (+19%) | +15% per Jahr |

| GeForce GTX 560 Ti | Fermi (40nm) | 25. Januar 2011 | 210% | 149W | 249$ | 150% (+26%) | +48% per Jahr |

| GeForce GTX 660 | Kepler (28nm) | 13. September 2012 | 250% | 113W | 229$ | 186% (+24%) | +15% per Jahr |

| GeForce GTX 760 | Kepler (28nm) | 25. Juni 2013 | 310% | 155W | 249$ | 221% (+19%) | +24% per Jahr |

| GeForce GTX 960 | Maxwell (28nm) | 22. Januar 2015 | 340% | 109W | 199$ | 271% (+22%) | +14% per Jahr |

| GeForce GTX 1060 6GB | Pascal (16nm) | 19. Juli 2016 | 590% | 114W | 249$ | 421% (+55%) | +37% per Jahr |

| GeForce GTX 1660 | Turing (12nm) | 14. März 2019 | 690% | 113W | 219$ | 526% (+25%) | +9% per Jahr |

| GeForce GTX 1660 Super | Turing (12nm) | 29. Oktober 2019 | 770% | 126W | 229$ | 574% (+9%) | +15% per Jahr |

| Alle Rechnungen zum Performance/Preis-Verhältnis (P/P) erfolgten mit einer Gewichtung des Preis-Effekts auf 50% – sprich, Preis-Veränderungen gingen nur hälftig in diese Rechnung ein. | |||||||

Neuer Artikel: Mindfactory Grafikkarten-Verkaufsreport Januar 2020

Die monatlichen Prozessoren-Verkaufsreports seitens Redditor Ingebor erfreuen sich einiger Beliebtheit innerhalb der IT-Gemeinde, bekommt man hiermit doch ein Marktbild gemäß dem Kaufverhalten von PC-Selbstbauern und informierten Käufern zu sehen – während allgemeine Marktzahlen durch den übergroßen Anteil an OEM-Geschäften (stark) verzerrt werden. Jener Effekt ist im Grafikkarten-Geschäft nicht ganz so dramatisch, aber natürlich dennoch vorhanden – denn im Komplett-PCs wird üblicherweise eine andere Klasse an Grafikkarten verbaut, als im Retail-Segment über die Ladentheken gehen. Basierend auf derselben Datenquelle in Form der öffentlich einsehbaren Mindfactory-Verkaufszahlen soll hiermit nun selbiges für Consumer-Grafikkarten entstehen – ein Grafikkarten-Verkaufsreport für das Retail-Segment. Nachfolgend soll somit aufgeschlüsselt werden, wieviele Consumer-Grafikkarten über die Mindfactory im Monat Januar 2020 verkauft wurden, welcher Umsatz hiermit erzielt wurde – und wie sich dies auf die einzelnen Marktsegmente sowie die beiden Chip-Anbieter AMD & nVidia verteilt ... zum Artikel.