Hauptlinks

Suche

Grafik-Features

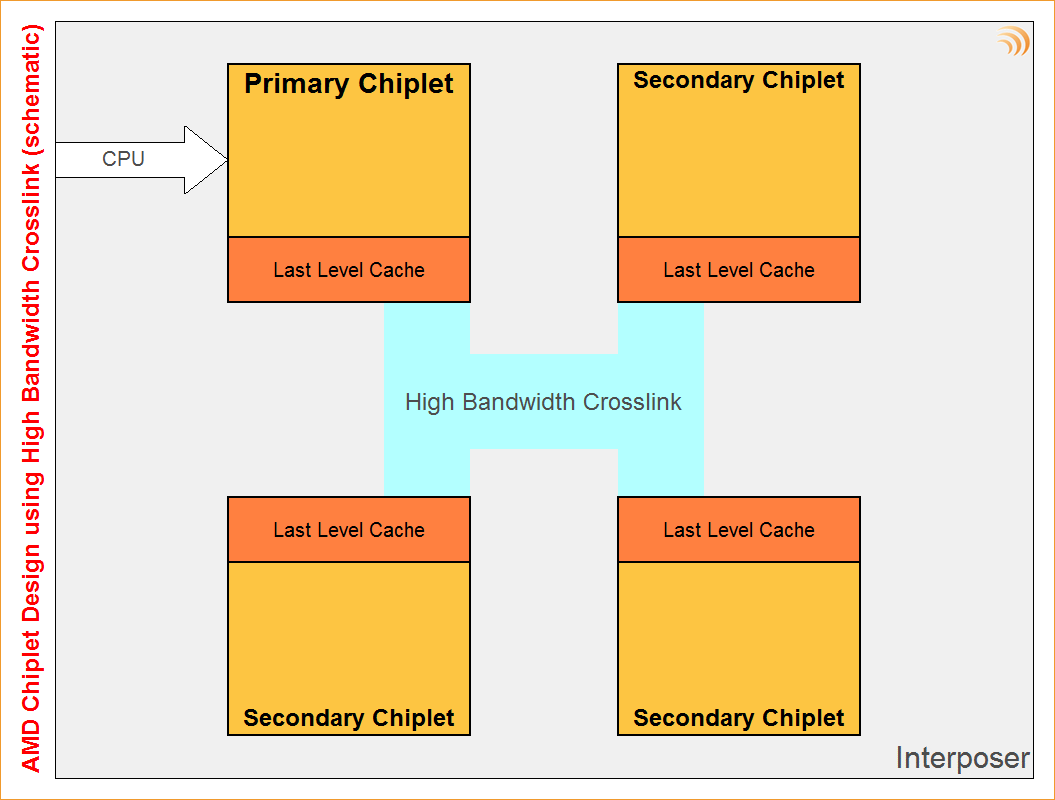

AMD arbeitet am technischen Unterbau von MultiChip-Grafiklösungen

VideoCardz erwähnen ein hochinteressantes, neu eingereichtes AMD-Patent, welches von multiplen GPU-Chiplets spricht – und damit augenscheinlich den technischen Unterbau zu MultiChip-Lösungen im Grafikkarten-Bereich liefern soll. Die Patentschrift selber ist abstrakt genug gehalten, um dies nicht einzelnen Produkten oder Architekturen zuordnen zu können – das ganze ist eher als Grundlagen-Arbeit und kaum als konkretes Chip-Projekt zu verstehen. Dabei hat AMD nicht einfach nur mehrere Chiplets auf ein Blatt Papier gemalt, sondern sich explizit der Frage gewidmet, wie man die Skalierung der Rechenleistung hoch halten bzw. die Datenströme zwischen den Chiplets reglementieren kann. Hierfür verbindet man mittels "High Bandwidth Crosslink" die Level3-Caches aller Chiplets, jene Anbindung wird über AMDs Interposer-Technologie (und damit vergleichsweise stromsparend) realisiert.

nVidia gibt die Unterstützung für "implicit SLI" mit dem Jahresende 2020 auf

Die "Release Notes" (PDF) zum neuen nVidia-Treiber 465.38 mit der erstmaligen Unterstützung der GeForce-30-Serie enthalten eine interessante Passage zum SLI-Support der Ampere-Grafikkarten. Einen SLI-Support wird es wie bekannt sowieso nur auf der GeForce RTX 3090 geben, nicht auf kleineren Ampere-Grafikkarten, auch nicht auf der Chip-gleichen GeForce RTX 3080. Jene GeForce RTX 3090 sowie alle zukünftigen SLI-fähigen nVidia-Grafikkarten werden allerdings nicht mehr "implicit SLI" unterstützen, sprich die bisherige SLI-Variante mit SLI-Profilen im nVidia-Treiber. Für die GeForce RTX 3090 wird es nur noch "explicit SLI" geben, was auf einem eigenen SLI-Support durch die jeweilige Anwendung selber basiert, was derzeit nur unter den Grafik-APIs DirectX 12, Vulkan und OpenGL möglich ist. nVidia streicht somit für Ampere und nachfolgende Grafik-Generationen den bisher üblichen SLI-Support komplett.

Implicit SLI, where the driver makes assumptions with application profiles to achieve GPU scaling, is disabled on NVIDIA Ampere GPUs. Explicit SLI is still supported, where the application knows the SLI state and uses extensions (such as DirectX 12 linked nodes, Vulkan device groups, or OpenGL multicast extensions) to issue commands to each device in the SLI group.

Quelle: Release Notes (PDF) der nVidia-Treiber 465.38

Microsoft bringt das DirectX Feature-Level 12_2 mit verpflichtendem Support von RayTracing und Shader Model 6.5

Nach dem erst im März vorgestellten "DirectX 12 Ultimate" bringt Microsoft nunmehr mit dem "Feature-Level 12_2" von DirectX (im eigentlichen dem für 3D-Grafik gedachten Teil "Direct3D") eine weitere Ausbaustufe der DirectX 12 Grafik-API. Dabei beinhaltet DirectX 12_2 (inoffizielle Abkürzung) alle Änderungen von DirectX 12 Ultimate – welche ja sowieso "nur" die vier neuen Hauptfeatures "DirectX RayTracing", "Mesh Shaders", "Variable Rate Shading" (VRS) und "Sampler Feedback" umfasst, sprich vergleichsweise plakative Veränderungen. DirectX 12_2 ist hingegen dann wiederum ein echtes DirectX-Update, sprich zuzüglich zu den Verbesserungen von DirectX 12 Ultimate gibt auch noch noch einen ganzen Strauß an weiteren Detail-Verbesserungen. Am Hardware-Support ändert sich hingegen nichts: Wie auch bei DirectX 12 Ultimate, wird DirectX 12_2 von den Grafik-Architekturen AMD RDNA2, Intel Xe-HPC, nVidia Turing (nur GeForce-20-Modelle) und nVidia Ampere unterstützt.

| Feature-Level 12_0 | Feature-Level 12_1 | Feature-Level 12_2 | |

|---|---|---|---|

| AMD | GCN2, GCN3, GCN4 | GCN5, RDNA1 | RDNA2 |

| Intel | - | - | Xe-HPG |

| nVidia | - | Maxwell 2, Pascal, Turing (GF16) | Turing (GF20), Ampere |

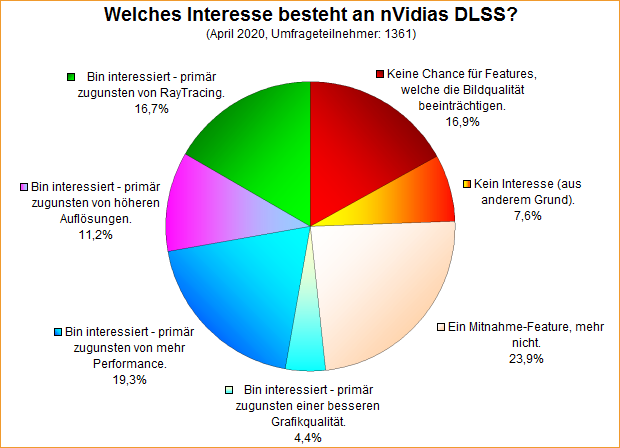

Umfrage-Auswertung: Welches Interesse besteht an nVidias DLSS?

Mittels einer Umfrage von Anfang des Monats wurde der aktuelle Stand zum Interesse an nVidias DLSS abgefragt – nachdem nVidia die verbesserte Ausführung DLSS 2.0 vorgestellt hatte und jene als ziemlich gut bewertet wurde. Die Stimmungslage der Grafikkarten-Nutzer zu DLSS verteilt sich ziemlich breit, was aber für ein bislang wenig um Vordergrund stehendes Grafik-Feature mit zudem vergleichsweise geringer Verbreitung (nutzbar nur auf nVidias RTX-Karten der Turing-Generation) nicht gänzlich überraschend kommt. Dennoch reicht es schon zu einem groben Gleichstand zwischen interessierten Nutzern (51,6%) und nicht oder nur wenig interessierten Nutzern (48,4%). Die gar nicht interessierten Nutzer stellen mit kumuliert 24,5% sogar nur ein grobes Viertel der Umfrage-Teilnehmer – wobei dort die Fraktion derjenigen Grafikkarten-Nutzer, welche jede Beinträchtigung der Bildqualität generell ablehnt, mit 16,9% (aller Umfrage-Teilnehmer) dominiert.

Microsoft stellt "DirectX 12 Ultimate" mit vier verpflichtenden "neuen" Grafik-Features vor

Microsoft hat mit "DirectX 12 Ultimate" eine neue, offizielle Ausbaustufe der DirectX 12 Grafik-API mittels eines Blog-Eintrags vorgestellt, welche ab dem kommenden Windows-Update 20H1 verfügbar wird. Für jene neue Ausbaustufe wählte man keine numerische Bezeichnung wie bisher mit den Feature-Levels – was immer leicht mißverständlich war und mittels der verschiedenen Tier-Levels auch ziemlich schwammig daherkommt. Inoffiziell kann man DirectX 12 Ultimate natürlich auch als "DirectX 12 Feature-Level 12_2" bezeichnen, treffender wäre aber eher die Abkürzung "DX12U". Unter dieser hat Microsoft dann schlicht vier bereits existierende optionale DirectX-12-Feature nunmehr verpflichtend gemacht: "DirectX RayTracing" (DXR) in der neuen Version 1.1, "Variable Rate Shading" (VSR), "Mesh Shaders" & "Sampler Feedback". Sinn und Zweck der Maßnahme ist natürlich die Abgrenzung neuerer Hardware gegenüber älterer Hardware – weswegen sich AMD & nVidia auch gleich bemühten zu betonen, welche ihrer Hardware nunmehr bereits DX12U unterstützt: Bei AMD wird dies die kommende RDNA2-basierte Generation um die Navi-2X-Grafikchips sein, während nVidia in dieser Angelegenheit vorn liegt, da bereits deren aktuelle RTX-Grafikkarten der GeForce-20-Serie für DX12U (und damit das entsprechende Logo) ausgelegt sind.

| DirectX 12 FL 12_0 | DirectX 12 FL 12_1 | DirectX 12 Ultimate | |

|---|---|---|---|

| AMD | GCN2/GCN3, Polaris | Vega, RDNA1 | RDNA2 |

| Intel | - | Skylake, Kaby Lake, Coffee Lake, Comet Lake | ? |

| nVidia | - | Maxwell 2, Pascal, Turing (GF16) | Turing (GF20), Ampere |

nVidia wiederbelebt MultiGPU-Rendering mittels neuem CFR-Modus

Aus unserem Forum (Dank an 'Blaire') kommt die hochinteressante Kunde über einen neuen, derzeit noch inoffiziellen wie auch undokumentierten MultiGPU-Modus in den aktuellen nVidia-Treibern – welcher allerdings durchaus das Potential hat, dem Thema "MultiGPU-Rendering" wieder neues Leben einzuhauchen. Hierbei handelt es sich augenscheinlich um ein Checkerboard-basiertes Verfahren, wo also nicht abwechselnd ein Bild von beiden Grafikkarten gerendert wird (AFR-Modus) oder das Bild platt in der Mitte zwischen zwei Grafikkarten aufgeteilt wird (SFR-Modus), sondern vielmehr das Bild in eine größere Menge an Tiles zerteilt wird und an jedem Tile dann immer nur eine der Grafikkarten arbeitet. Im Prinzip ergibt dies eine höherwertige, wahrscheinlich schlicht viel effizientere Version des SFR-Modus – interessanterweise ist der neue CFR-Modus im nVidia-Treiber unter dem alten SFR-Modus verborgen, welcher seinerseits zuletzt von nVidia überhaupt nicht mehr gepflegt wurde.

|

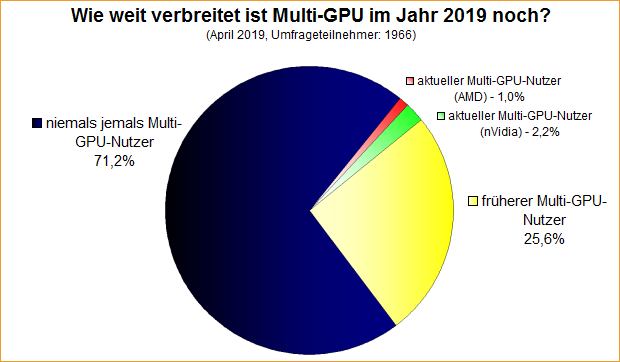

Umfrage-Auswertung: Wie weit verbreitet ist Multi-GPU im Jahr 2019 noch?

Mittels einer Umfrage vom April wurde nach aktuellen wie vergangenen Verbreitungsgrad von Multi-GPU-Grafikkarten gefragt. Das Umfrage-Ergebnis gibt dabei niederschmetterende 3,2% der Umfrage-Teilnehmer als aktuelle Multi-GPU-Nutzer an, mit einer klaren Verteilung von 31:69% zugunsten von nVidia. Das es (angesichts der AMD-Absage an neue CrossFire-Treiber schon im Jahr 2017) überhaupt noch AMD-Nutzer gibt, ist dabei zuerst ein wenig erstaunlich, doch aufgrund der geringen Stimmenanzahl (20 Stimmen bei 1966 Umfrageteilnehmern) dürften sich hier vermutlich eher Nutzer älterer, einfach noch nicht ersetzter Systeme tummeln. Jene könnte es auch im nVidia-Feld geben, so das die Anzahl an Multi-GPU-Nutzern rein auf aktuellen Grafikkarten dann nochmals geringer ausfallen dürfte – vielleicht nur noch bei anderthalb Prozentpunkten. Für das 3DCenter ist dies ein wirklich schwaches Resultat, denn Multi-GPU war hier bei den absoluten Enthusiasten ein gern gepflegtes Steckenpferd mit jederzeit drastisch höherem Verbreitungsgrad als im Massenmarkt oder auf Steam.

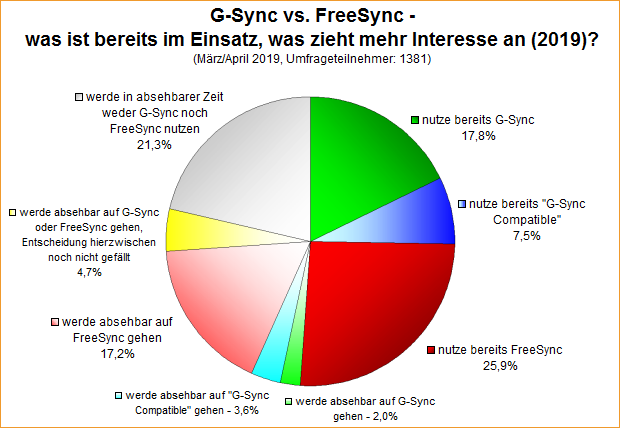

Umfrage-Auswertung: G-Sync vs. FreeSync - was ist bereits im Einsatz, was zieht mehr Interesse an (2019)?

Mittels einer Umfrage vom letzten März-Tag wurde der Stand der Verbreitung zu G-Sync und FreeSync abgefragt, so wie bei ähnlichen Umfragen vom September 2017 bzw. vom Januar 2016. In der Zwischenzeit hat sich mittels "G-Sync Compatible" einiges getan, was sich auch sofort in den Umfrage-Ergebnissen zeigt, wo dieses technisch gesehen "FreeSync mit nVidia-Grafikkarten" umgehend auf eine beachtbare Nutzer-Anzahl kommt. Alle drei Sync-Standards zusammen erreichen im übrigen kumuliert 51,2% Stimmenanteil – womit die Sync-Standards erstmals eine (knappe) absolute Nutzer-Mehrheit (hier im 3DCenter) auf sich vereinigen können. Insbesondere gegenüber dem Stand von Anfang 2016 (12,6% Sync-Nutzer) ist dies eine regelrecht rasante Entwicklung, durchaus gleichzusetzen mit der seinerzeitig schnellen Durchsetzung der SSD gegenüber der HDD.

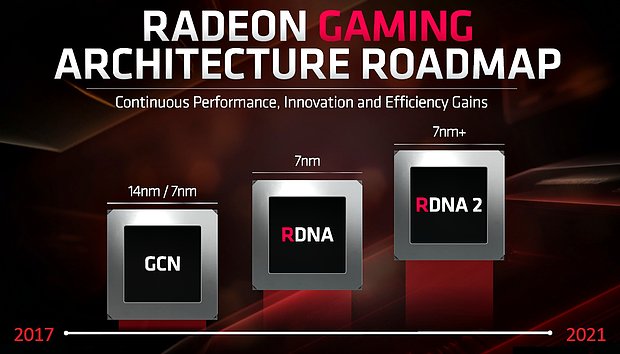

AMD gibt Ausblick auf die RDNA2-Architektur und RayTracing mit AMD-Grafikchips

Zur Vorstellung der Navi-basierten Radeon RX 5700 & 5700 XT Grafikkarten hat AMD leider gar nichts zum Thema von RayTracing sowie der weiteren Entwicklung der RDNA-Architektur gesagt, diese Informationen ergaben sich dann allerdings im Nachgang. So wird eine neue offizielle Grafikarchitektur-Roadmap offeriert, welche die "RDNA2"-Architektur in der 7nm+ Fertigung für den Zeitrahmen 2020/21 verspricht. Diese zeitliche Einordnung ist nicht wirklich präzise, da die Roadmap-Beschriftung in dieser Frage ziemlich ungenau ist – technisch gesehen deutet zwar alles auf das Jahr 2020 hin, aber nominell könnte es eben doch auch noch das Jahr 2021 werden. Ob damit der größere Navi-Chip "Navi 20" oder aber die nachfolgende "Arcturus"-Generation gemeint ist, bleibt offen – beide Varianten sind denkbar. Sofern es Navi 20 wird, gäbe es somit innerhalb derselben Grafikkarten-Generation erhebliche Architektur-Differenzen (was bei AMD allerdings nicht ungewöhnliches wäre) – wenn es dagegen "Arcturus" wird, könnte AMD eine komplett neue Grafikkarten-Generation gemäß dieser RDNA2-Architektur aufbauen.

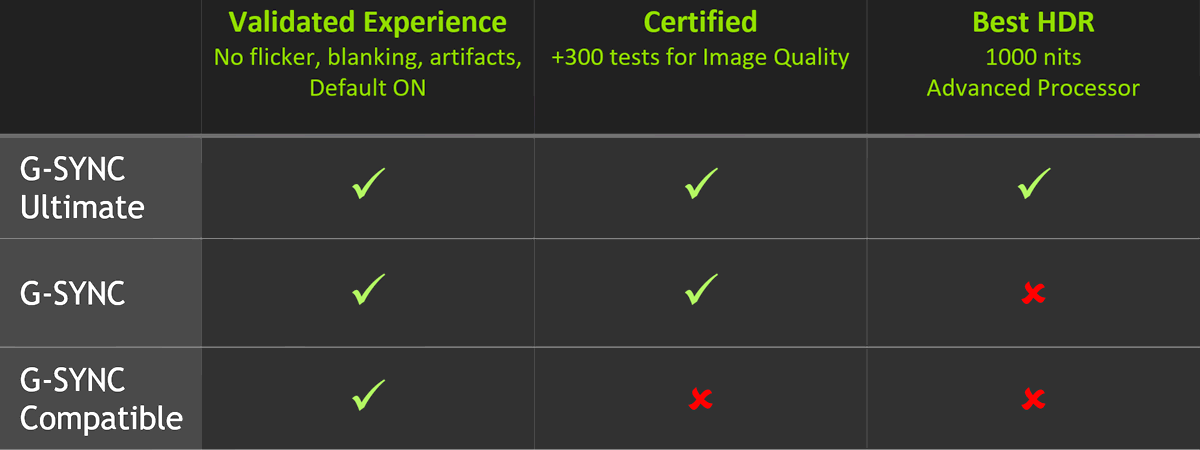

nVidia könnte mit "G-Sync Compatible" die konkurrierenden Sync-Standards vereinen

Ein wesentlicher Punkt von nVidias CES-Pressekonferenz war neben viel Show rund um RayTracing, der (kurzen) Vorstellung der GeForce RTX 2060 sowie der Ankündigung von Turing-basierten Mobile-Beschleunigern die Neuerungen zu nVidias G-Sync. So gibt es nunmehr einen extra Standard "G-Sync Ultimate" für eine ordentliche HDR-Darstellung (mit entsprechend hohem Helligkeitswert), was das bisherige "G-Sync HDR" beerbt. Gleichfalls öffnet nVidia sich nominell dem offenen AdaptiveSync-Standard, welcher technisch auf AMDs FreeSync basiert. nVidia ordnet dies unter "G-Sync Compatible" ein und will entsprechende FreeSync-Monitore mit einem neuen Treiber ab 15. Januar dann mit G-Sync-Funktionalität beglücken. Allerdings sind nVidias Anforderungen offenbar ziemlich hoch, von 400 vorab getesteten FreeSync-Monitoren haben nur 12 die nVidia-Prüfungen bestanden und können sich zukünftig mit dem Prädikat "G-Sync Compatible" schmücken.