Hauptlinks

Suchen

nVidia-Grafik

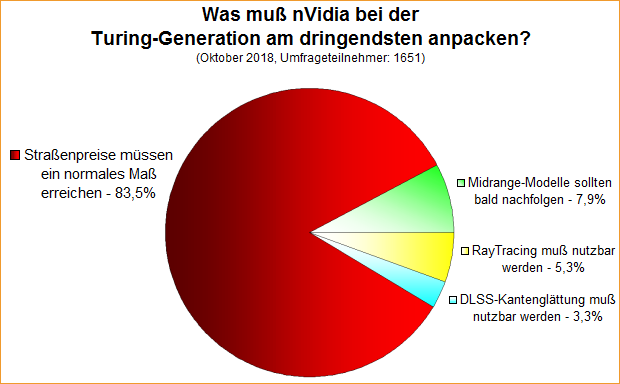

Umfrage-Auswertung: Was muß nVidia bei der Turing-Generation am dringendsten anpacken?

Die Umfrage der letzten Woche widmete sich der Frage danach, woran nVidias (eher mau gestartete) Turing-Generation derzeit am meisten krankt bzw. was nVidia also zuerst anpacken muß, um dies zu ändern. Hierzu gab es eine sehr eindeutige Antwort: Zuerst müssen laut immerhin 83,5% der Umfrage-Teilnehmer die Straßenpreise der Turing-Beschleuniger auf ein normales Maß absinken. Die anderen Antwort-Optionen Midrange-Modelle, RayTracing und DLSS erreichten dagegen kumuliert gerade einmal 16,5% der Stimmen – sind also sicherlich für den späteren Verlauf weiter beachtbar, müssen aber vorerst gegenüber dieser klaren Handlungsempfehlung an nVidia zurückstehen.

Neuer Artikel: Launch-Analyse nVidia GeForce RTX 2070

Mit der GeForce RTX 2070 schickt nVidia nunmehr seine dritte Turing-basierte Grafiklösung ins Rennen – auf dem inzwischen schon dritten Turing-Grafikchip (TU106), ungewöhnlich viel zu diesem vergleichsweise frühen Zeitpunkt. Jene dritte Turing-Lösung kommt zu einem Preispunkt von (idealerweise) 499 Dollar daher, verbleibt also immer noch klar im HighEnd-Bereich und stellt damit sicherlich das höchste (und auch teuerste) dar, was nVidia jemals im Rahmen einer x70er Grafikkarte geboten hat. Mit diesem Preispunkt geht die Karte dann in direkte Konkurrenz zur genauso ausgepreisten GeForce GTX 1080 aus der vorhergehenden Pascal-Generation – und wir werden uns nachfolgend ansehen, was die vielen Launchreviews zu den Themen Performance, Taktraten, Stromverbrauch, Übertaktungseignung und Performance/Preis-Verhältnis der GeForce RTX 2070 zu sagen haben ... zum Artikel.

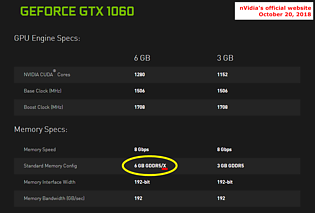

nVidia hat augenscheinlich eine GeForce GTX 1060 mit GDDR5X-Speicher in Vorbereitung

Seitens Videocardz kam jüngst das Gerücht über eine GeForce GTX 1060 mit GDDR5X-Speicher auf, welche bei Gigabyte sogar schon in Vorbereitung sein soll. Darunter stellte man sich ein (stark abgespecktes) GP104-Derivat vor, da der für die GeForce GTX 1060 normalerweise benutzte GP106-Chip nominell über kein GDDR5X-fähiges Speicherinterface verfügt (wobei dieser Punkt nie offiziell seitens nVidia bestätigt wurde). Die Abspeckung des GP104-Grafikchips von 2560 auf nur noch 1280 Shader-Einheiten wäre zwar drastisch, aber damit kann nVidia eben auf einfachem Wege eine GeForce GTX 1060 mit GDDR5X-Support und damit deutlich mehr Speicherbandbreite erzeugen. Allgemein wird diese Karte als nVidias Antwort auf die Radeon RX 590 angesehen – beide Karten kommen ohne wirklich neue Chips daher und stellen somit nur leicht verbesserte Refreshs dar. Interessant wird das Gerücht nunmehr durch den Punkt, das nVidia auf seiner eigenen US-Webseite die Spezifikationen zur GeForce GTX 1060 bereits mit der Unterstützung von GDDR5X-Speicher auszeichnet:

GeForce RTX 2070 Launchreviews: Die Testresultate zur WQHD-Performance im Überblick

Als Teaser für die kommende Launch-Analyse zur GeForce RTX 2070 seien hiermit schon einmal die ausgewerteten Benchmarks in der WQHD-Auflösung kredenzt – der wahrscheinlich sinnvollsten Auflösung für diese Karte (die Launch-Analyse wird dann natürlich auch Benchmark-Auswertungen zu FullHD und UltraHD enthalten). Im Gegensatz zu GeForce RTX 2080 & 2080 Ti wurde die GeForce RTX 2070 primär in Form von Herstellerkarten auf Referenztaktraten vermessen, nVidias eigene Founders Edition kam viel seltener zum Einsatz. Trotzdem gab es wenigstens einen Testbericht bei PCGamer, welcher beide Karten-Varianten gleichzeitig durch alle Benchmarks geschickt hat (hinzukommend AnandTech mit der umgetakteten und damit simulierten GeForce RTX 2070 auf Referenztakt). Die Performance-Differenz zwischen beiden Karten-Varianten hält sich gemäß dieser Tests allerdings (wie von GeForce RTX 2080 & 2080 Ti her bekannt) vollkommen im Rahmen und liegt bei grob 3½ Prozent.

| vs. Vega 64 | vs. 1080 | vs. 1080 Ti | |

|---|---|---|---|

| GeForce RTX 2070 Founders Edition | +14,2% | +12,7% | -11,8% |

| GeForce RTX 2070 Referenztaktung | +10,2% | +8,7% | -14,9% |

| basierend auf den gemittelten WQHD-Ergebnissen der Launchreviews | |||

Erster TimeSpy-Wert zur GeForce RTX 2070 zeigt ein Performance-Niveau zwischen GeForce GTX 1080 und 1080 Ti an

Vom bekannten Leaker Tum Apisak kommen erste 3DMark13-TimeSpy-Resultate zur GeForce RTX 2070 – zumindest vermutlich zu dieser Karte, denn es existiert kein entsprechender Eintrag in der 3DMark-Benchmarkdatenbank, womit der Sache schlicht vertraut werden muß (oder eben auch nicht). Derzeit gibt es auch nur zwei Overall-Werte zu vermelden – einmal 8151 Punkte mit einer Zotac-Karte, die bis auf maximal 1950 MHz Boosttakt lief, und einmal 8403 Punkte mit einer wahrscheinlichen Founders Edition, welche "nur" auf maximal 1860 MHz Boosttakt kam. Wahrscheinlich liefen diese Tests dennoch unübertaktet ab, da die Werte anderer Grafikkarten-Tests dieses japanischen Testers zum bekannten Performanceniveau unübertakteter FE-Karten passen. Die zu sehende Differenz beider RTX2070-Ergebnisse könnte hingegen an abweichenden Treibern liegen, das bessere Ergebnis ist einen Tag jünger. Wenigstens kam alles vom selben japanischen Tester auf demselben Testsystem, welcher mit einem Core i7-8700K ausgerüstet war. Da für exakt dieses System zudem einzelne CPU-Werte (zu anderen Grafikkarten) vorliegen, läßt sich ziemlich genau (anhand der offiziellen Formel) zurückrechnen, das die (angenommene) GeForce RTX 2070 "FE" einen Graphics-Wert von ~8580 erreicht haben muß.

| Technik | TimeSpy (Score) | TimeSpy (Graphics) | |

|---|---|---|---|

| GeForce GTX 1080 Ti | Pascal GP102, 3584 Shader-Einheiten @ 352 Bit Interface, 11 GB GDDR5X | Ø 8696 | Ø 9429 |

| GeForce RTX 2070 (?) | Turing TU106, 2304 Shader-Einheiten @ 256 Bit Interface, 8 GB GDDR6 | 8403 | (hochgerechnet) ~8580 |

| GeForce GTX 1080 | Pascal GP104, 2560 Shader-Einheiten @ 256 Bit Interface, 8 GB GDDR5X | Ø 6905 | Ø 7073 |

| GeForce GTX 1070 Ti | Pascal GP104, 2432 Shader-Einheiten @ 256 Bit Interface, 8 GB GDDR5 | Ø 6680 | Ø 6783 |

| GeForce GTX 1070 | Pascal GP104, 1920 Shader-Einheiten @ 256 Bit Interface, 8 GB GDDR5 | Ø 5761 | Ø 5733 |

| Radeon RX Vega 64 | AMD Vega 10, 4096 Shader-Einheiten @ 2048 Bit Interface, 8 GB HBM2 | Ø 6994 | Ø 7085 |

| Radeon RX Vega 56 | AMD Vega 10, 3584 Shader-Einheiten @ 2048 Bit Interface, 8 GB HBM2 | Ø 6170 | Ø 6251 |

| Quellen: RTX2070 von Tum Apisak, alle anderen sind das mathematische Mittel der Werte von TweakPC, Hardware.fr, SweClockers und KitGuru | |||

Turing-basierter Midrange-Grafikchip zeigt sich in nVidias Automobil-Lösung "Drive AGX Pegasus"

Die PC Games Hardware hat sich mit nVidias Automobil-Lösung "Drive AGX Pegasus" und den dort verbauten zwei Turing-Grafikchips beschäftigt – worunter sich ein Turing-basierter Midrange-Chip verbergen sollte. Das es sich um Turing-basierte Chips handelt, hatte nVidia schon bestätigt – und die Midrange-Klasse ergibt sich indirekt aus der angegebenen Tensor-Power von 320 TOPS im bestmöglichen Fall, ergo bei INT4-Berechnungen. Davon gehen laut der PCGH zweimal 30 TOPS für die beiden verbauten Xavier-SoCs ab, bleiben also 260 TOPS für zwei verbaute Turing-Chips übrig, sprich 130 TOPS pro Turing-Chip. Eine GeForce RTX 2070 schafft in der FE-Ausführung ihre 252 TOPS – wobei eine im Automobil-Bereich verbaute Grafiklösung sicherlich nicht mit Desktop-Taktraten antreten wird. Ein Turing-Grafikchip, welcher 130 TOPS unter diesen Bedingungen leistet, ist dann im Desktop-Umfeld sicherlich 150-160 TOPS stark – dies sind grob 60% des Leistungsniveaus der Radeon RTX 2070. Dies deutet ziemlich genau auf den direkt unterhalb des (für die GeForce RTX 2070 verwendeten) TU106-Chips liegenden Turing-Chips hin – sprich, ein Turing-basierter MidrangeChip, spekulativ derzeit "TU116" genannt.

| TU102 | TU104 | TU106 | "TU116" | "TU117" | |

|---|---|---|---|---|---|

| Marktsegment | Enthusiast | HighEnd | HighEnd | Midrange | Mainstream |

| Chipgröße | 754mm² | 545mm² | 445mm² | (grob) ~300mm² | (grob) ~200mm² |

| Hardware | 4608 SE @ 384 Bit GDDR6 | 3072 SE @ 256 Bit GDDR6 | 2304 SE @ 256 Bit GDDR6 | ~1408-1536 SE @ 192 Bit GDDR6 | ~896-1024 SE @ 128 Bit GDDR5 |

| RayTracing | ✓ | ✓ | ✓ | ✗ | ✗ |

| Tensor Cores | ✓ | ✓ | ✓ | ✓ | ✓ |

| NVLink | 2x | 1x | ✗ | ✗ | ✗ |

| Grafikkarten | GeForce RTX 2080 Ti | GeForce RTX 2080 | GeForce RTX 2070 | GeForce GTX 2060 | GeForce GTX 2050 /Ti |

| Alle Angaben zu den Grafikchips "TU116" und "TU117" sind derzeit natürlich rein spekulativ. | |||||

nVidia bereitet Mobile-Portfolio auf Turing-Basis für Jahresanfang 2019 vor

Bei WCCF Tech hat man aus Industriequellen einige Hinweise zu kommenden neuen Mobile-Grafiklösungen innerhalb von nVidia GeForce 20 Serie erhalten. Dazu zählt primär eine Roadmap von anzunehmenderweise einem Notebook-Hersteller, welcher sich auf diese neuen Mobile-Grafiklösungen bezieht. Laut jener Roadmap plant der nicht genannte Notebook-Hersteller für das nächste Jahre neue Notebook-Modelle mit Prozessoren aus dem Coffee-Lake-Refresh sowie neuen nVidia-Grafiklösungen, welche kurz als "2050", "2050 Ti", "2060", "2060 Ti", "2070 MaxQ" und "2070" bezeichnet werden. Dieses Mobile-Lineup soll wohl um die CES (Anfang Januar 2019) herum vorgestellt werden, eine "2080 MaxQ" soll dann etwas später nachfolgen. Mit entsprechenden Notebooks dürfte dann ergo im Zeitrahmen Februar/März zu rechnen sein, einzelne Geräte könnten natürlich auch schon im Januar 2019 auftauchen.

| Mobile-Lösungen | Abstammung |

|---|---|

| GeForce RTX 2080 Mobile GeForce RTX 2080 MaxQ |

TU104M-Chip (laut einer früheren Meldung) |

| GeForce RTX 2070 Mobile GeForce RTX 2070 MaxQ |

anzunehmenderweise der TU106M-Chip |

| GeForce GTX 2060 Ti Mobile GeForce GTX 2060 Mobile GeForce GTX 2050 Ti Mobile GeForce GTX 2050 Mobile |

drei mögliche Auflösungen: 1. Rebranding vorhandener Pascal-Lösungen 2. neu aufgelegte Grafikchips innerhalb der Pascal-Architektur (spekulativ GP206 & GP207) 3. neu aufgelegte Grafikchips innerhalb der Turing-Architektur (spekulativ TU116 & TU117) |

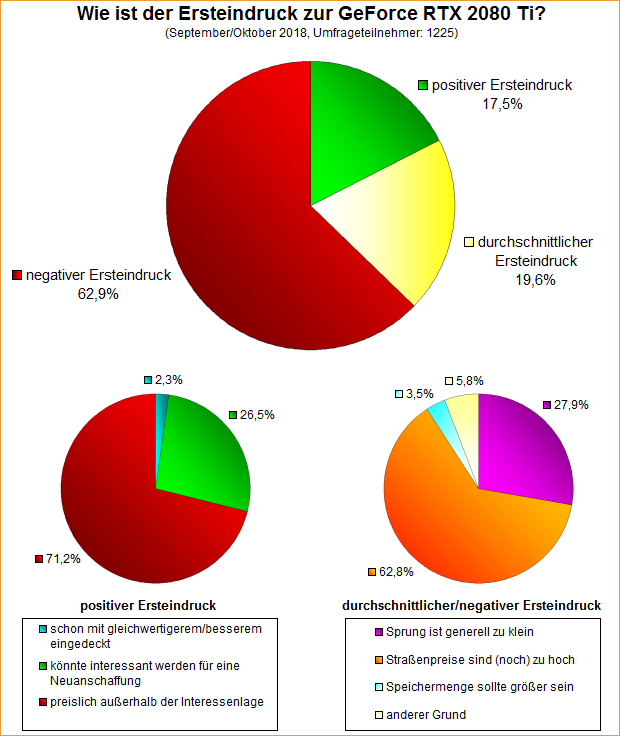

Umfrage-Auswertung: Wie ist der Ersteindruck zu nVidias GeForce RTX 2080 Ti?

Mit einer Umfrage von Ende September wurde nach dem Ersteindruck zur GeForce RTX 2080 Ti gefragt. Hierbei zeigte sich ein gegenüber der gleichlautenden Umfrage zur kleineren GeForce RTX 2080 fast deckungsgleiches Bild – welches generell nicht rosig für das aktuelle Turing-Spitzenmodell aussieht. Denn 17,5% positiver Ersteindruck zu 19,6% durchschnittlicher Ersteindruck bei satten 62,9% negativem Ersteindruck sind ein schwaches Ergebnis für ein Ti-Spitzenmodell von nVidia: Die GeForce GTX 780 Ti trat seinerzeit mit 60,2% positivem Ersteindruck an, die GeForce GTX 980 Ti noch mit 52,2% und die GeFore GTX 1080 Ti wieder mit 61,9%. Dabei muß sich die GeForce RTX 2080 Ti bezüglich der Performance (einsame Spitze) und der Speichermenge (zumindest Spitzenmaß, wenn auch nicht erhöht) wirklich nichts vorwerfen lassen – um so mehr erstaunt dann dieses Umfrageergebnis.

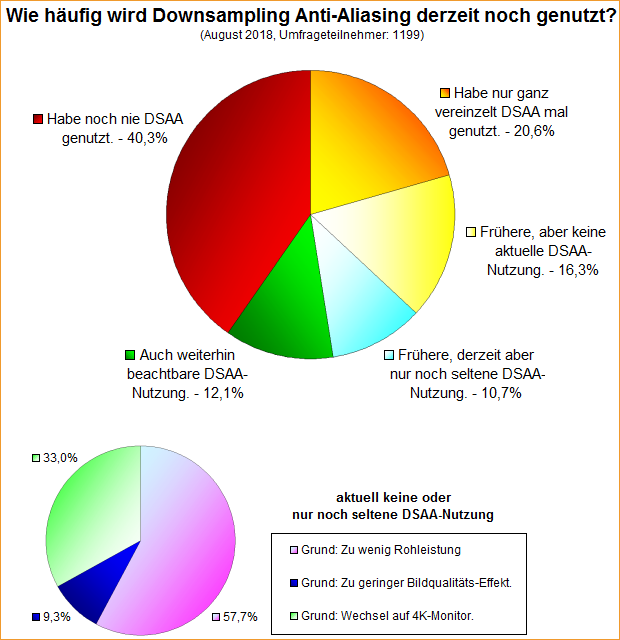

Umfrage-Auswertung: Wie häufig wird Downsampling Anti-Aliasing derzeit noch genutzt?

Eine Umfrage von Mitte August ging der Frage nach, wie breit Downsampling Anti-Aliasing derzeit überhaupt noch genutzt wird. Vor einigen Jahren waren AMDs VSR bzw. nVidias DSR Anti-Aliasing noch heiße Eisen, heuer aber hört man kaum noch etwas neues hierzu, wird auch kaum noch in diese Richtung hin getestet. Dies bestätigt sich allerdings durch die aktuelle Nutzer-Anzahl, welche mit 12,1% beachtbaren und 10,7% seltenen Nutzern (zusammengezählt 22,8%) nicht gerade hoch ausfällt – in jedem Fall weniger als vor zwei Jahren, wo die Nutzer-Anzahl kumulativ schon 37,3% erreichte. Letztlich sind somit im Laufe der Zeit sogar beachtbar Nutzer von dieser Kantenglättungs-Variante abgewandert, anstatt vielmehr neue Nutzer hinzugekommen wären.

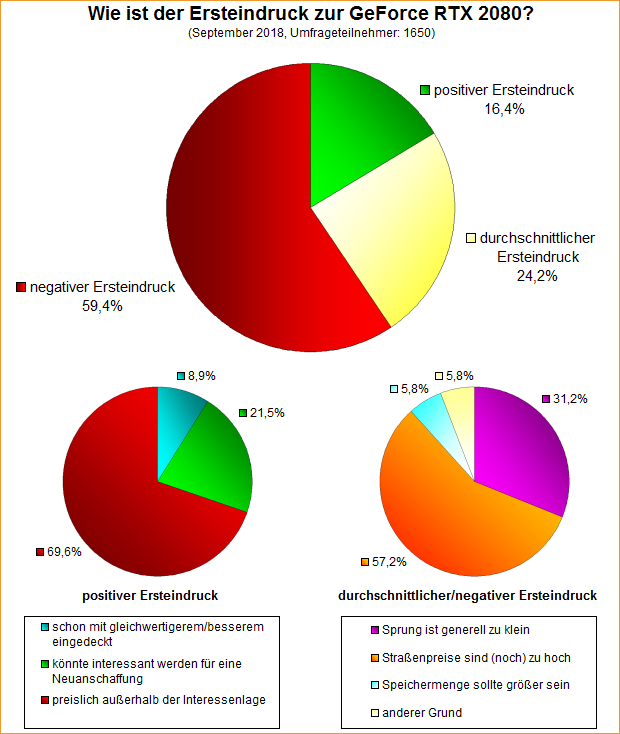

Umfrage-Auswertung: Wie ist der Ersteindruck zu nVidias GeForce RTX 2080?

Die Umfrage der abgelaufenen Woche galt natürlich dem Ersteindruck zur GeForce RTX 2080, der kleineren der beiden zuerst vorgestellten Turing-Grafikkarten. Jene im Performance- und Preisbereich der GeForce GTX 1080 Ti angesiedelte Karte musste sich natürlich mit dieser Pascal-Lösung herumschlagen, was angesichts der real aufgerufenen Preispunkte kein leichtes Brot ist. So stimmten dann auch (nicht gänzlich unerwartet) immerhin 59,4% der Umfrageteilnehmer zugunsten eines negativen Ersteindrucks – und nur 16,4% für einen positiven sowie weitere 24,2% für einen durchschnittlichen Ersteindruck. Dies ist eine sicherlich sehr schwache Wertung, welche ansonsten nur überteuerte Titan-Grafikkarten "erreichen", wo die Mehrperformance nur schwerlich zum Mehrpreis passt – aber diese Einschätzung trifft ja zu den aktuellen Straßenpreisen auch ganz gut auf die GeForce RTX 2080 zu.