Hauptlinks

Suchen

AMD-Grafik

Performance-Skalierung von 3DMark TimeSpy und Steel Nomad im Vergleich

Unter der Woche hat der 3DMark-Macher "UL" dem 3DMark13 einen neuen Einzeltest spendiert, welcher den bisherigen Raster-Standardtest "TimeSpy" ablösen soll. Dafür bringt "Steel Nomad" eine deutlich bessere und damit leistungsfressender Grafik mit und wird gleich unter der 4K-Auflösung ausgeführt. Eine zusätzliche "Light"-Variante läuft unter der WQHD-Auflösung, arbeitet allerdings mit abgespeckten Grafik-Optionen und hat somit eher sein eigenes Performance-Profil. Die Systemanforderungen sind leicht gestiegen, inzwischen ist eine Grafikkarte mit DirectX 12 Feature_Level 12_0 für "Steel Nomad" vonnöten (für TimeSpy hatte noch FL11_0 gereicht). Alternativ läuft Steel Nomad auch unter Vulkan, was hier und da sogar für die (leicht) besseren Resultate sorgt. Zum neuen Benchmark haben sich auch bereits gehaltvolle Testberichte seitens ComputerBase und PC Games Hardware eingefunden, welche zudem Benchmarks für die wichtigsten aktuellen wie vergangenen Grafikkarten mitbringen.

| TimeSpy | Steel Nomad Light | Steel Nomad | |

|---|---|---|---|

| Render-Auflösung | WQHD bzw. 4K (Extreme) | WQHD | 4K |

| HW-Anforderungen | DualCore-CPU mit SSE3, 4 GB RAM (8 GB bei iGPU), 4 GB VRAM | DualCore-CPU mit SSE3, 8 GB RAM (16 GB bei iGPU), 4 GB VRAM | DualCore-CPU mit SSE3, 8 GB RAM (16 GB bei iGPU), 6 GB VRAM |

| DX-Anforderung | DX12 Feature-Level 11_0 | DX12 Feature-Level 12_0 | DX12 Feature-Level 12_0 |

| Anmerkung | - | nicht nur Unterschied in der Auflösung, auch die Grafik-Details sind in der Light-Version zurückgefahren | |

| Release | 2016 | 2024 | 2024 |

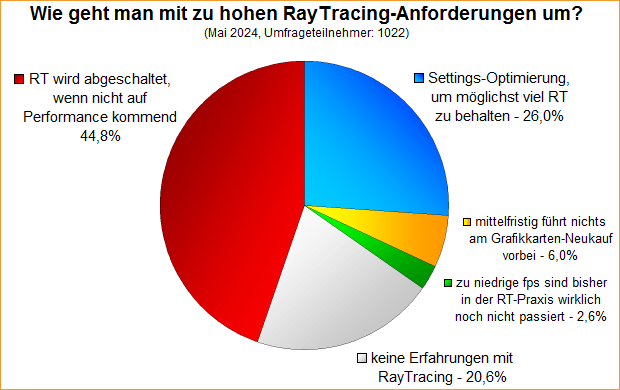

Umfrage-Auswertung: Wie geht man mit zu hohen RayTracing-Anforderungen um?

Mittels einer Umfrage von Anfang Mai wurde die Frage gestellt, was im Fall von zu hohen Leistungsanforderungen bei RayTracing getan wird: Schaltet man RayTracing ab, dreht zugunsten von RayTracing die Bildqualitäts-Settings zurück (bzw. setzt Upscaler ein) – oder geht es am Ende irgendwann in Richtung Grafikkarten-Neukauf. Erst einmal haben 20,6% der Umfrageteilnehmer (bislang) gar keine Erfahrungen mit RayTracing – was letztlich auch eine wertvolle Information darstellt, somit haben schließlich bereits 79,4% der Umfrageteilnehmer entsprechende Erfahrungen gemacht. Weitere 2,6% haben die Ausgangslage zur Fragestellung – zu hohe Leistungsanforderungen durch RayTracing – bislang in der Praxis noch nicht bemerken können, was wohl auf die Nutzer der GeForce RTX 4090 hinausläuft.

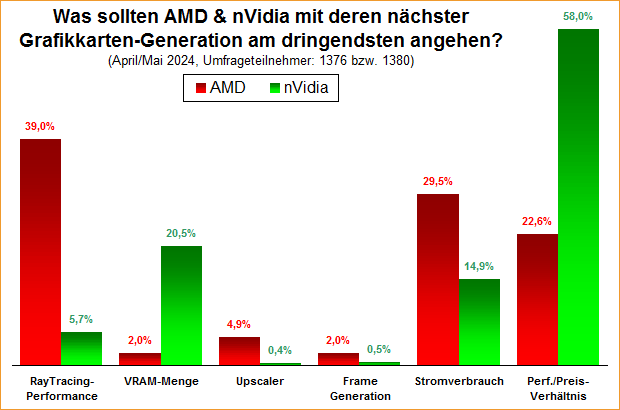

Umfrage-Auswertung: Was sollten AMD & nVidia mit deren nächster Grafikkarten-Generation am dringendsten angehen?

Ab Ende April liefen hintereinander zwei Umfrage mit derselben Fragestellung, einmal für AMD und einmal für nVidia: Welche Problematiken sollten die Grafikchip-Entwickler mit deren nächster Grafikkarten-Generation am dringendsten angehen? Die beiden Umfragen werden hiermit gemeinsam ausgewertet, da die herausgekommenen Ergebnisse um so interessanter sind, vergleicht man jene direkt zwischen AMD und nVidia. Denn es ergaben sich bei gleicher Fragestellung samt gleichen Antwortoptionen doch recht unterschiedliche Favoriten, je nach Grafikchip-Entwickler: So vereinnahmen bei AMD die Antwortoptionen "RayTracing-Performance", "Stromverbrauch" und "Performance/Preis-Verhältnis" (in dieser Reihenfolge) die große Mehrheit der Stimmen, die anderen Antwortoptionen kamen nicht auf bedeutende Stimmanteile.

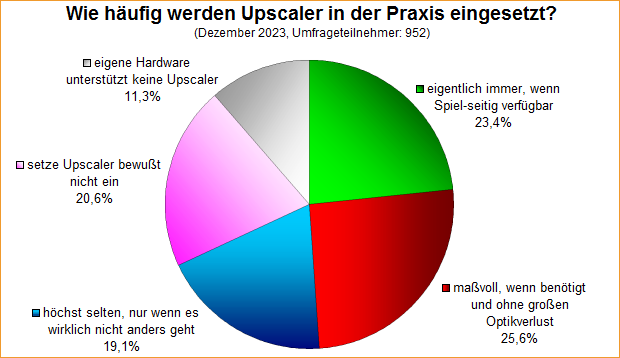

Umfrage-Auswertung: Wie häufig werden Upscaler in der Praxis eingesetzt?

Nach der kürzlichen Auswertung der RayTracing-Umfrage erfolgt hiermit noch die Auswertung der entsprechenden Upscaler-Umfrage von letztem Dezember – mittels welcher die Häufigkeit des Praxis-Einsatzes dieses Features erfasst werden sollte. In dieser Frage haben Upscaler logischerweise den natürlichen Vorteil, dass jene im klaren Gegensatz zu RayTracing normalerweise Performance erbringen – und nicht gerade erheblich an Performance kosten. Demzufolge ist es wenig verwunderlich, wenn Upscaler derzeit schon etwas häufiger als RayTracing genutzt werden, mit einem Nutzeranteil von 68,1% ist der Vorteil gegenüber RayTracing (Nutzeranteil 54,8%) nicht gerade unerheblich.

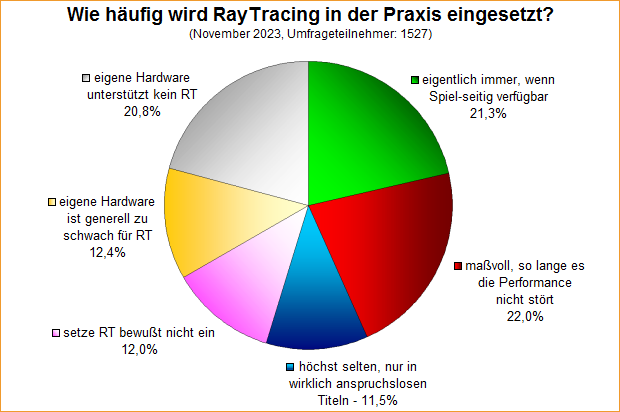

Umfrage-Auswertung: Wie häufig wird RayTracing in der Praxis eingesetzt?

Etwas untergangen im Launch-Feuerwerk zum Jahresanfang 2024 sind noch zwei Umfragen von Ende 2023, welche hiermit nachträglich ausgewertet werden sollen: Den Anfang macht die Umfrage zur Fragestellung, wie häufig RayTracing in der Praxis eingesetzt wird – um ermessen zu können, welche Alltags-Bedeutung RayTracing bereits erlangt hat. Selbige ist zumindest unter den Umfrage-Teilnehmern und damit 3DCenter-Lesern nicht gerade klein, wenn immerhin 54,8% RayTracing wenigstens ab und zu einsetzen. Natürlich ergeben sich dabei große Abstufungen bezüglich der Häufigkeit: Unter den RayTracing-Nutzern setzen 39% selbiges eigentlich immer ein, 40% in maßvoller Art & Weise und 21% jedoch nur höchst selten.

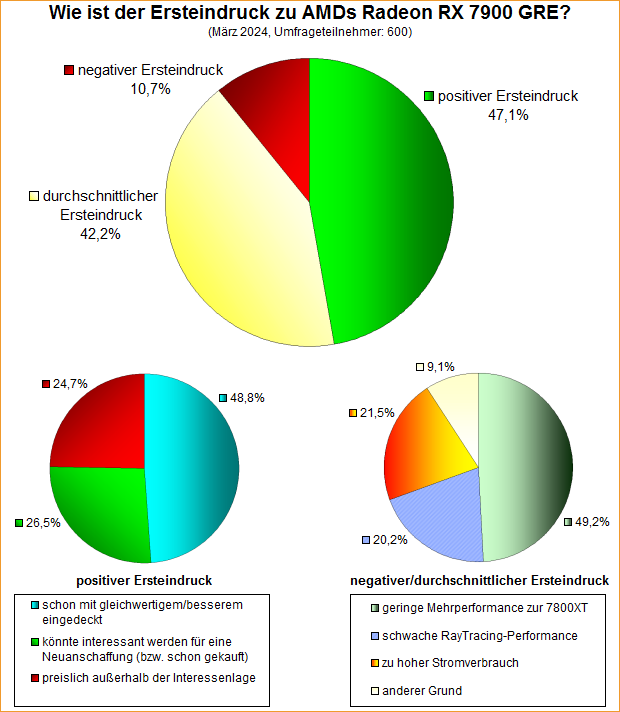

Umfrage-Auswertung: Wie ist der Ersteindruck zu AMDs Radeon RX 7900 GRE?

Mittels einer Umfrage von Mitte März wurde nach dem Ersteindruck zur Radeon RX 7900 GRE gefragt, dem letzten Zugang in der Grafikkarten-Launch-Bonanza zum Jahresanfang 2024. Als später Nachzügler und preislich nur wenig von der Radeon RX 7800 XT entfernt sollte man es eigentlich schwer haben, allerdings fiel die Stimmung der Umfrageteilnehmer überraschend freundlich zur Radeon RX 7900 GRE aus: Mit 47,1% positiver Ersteindruck zu 42,2% durchschnittlichem Ersteindruck und nur 10,7% negativem Ersteindruck wird das seinerzeitige Stimmungsbild zur Radeon RX 7800 XT (41,5% positiv, 44,6% durchschnittlich & 13,9% negativ) sogar leicht übertroffen. Nominell ist die Radeon RX 7900 GRE damit diese Karte der RDNA3/Ada-Generation mit der besten Bewertung innerhalb dieser Ersteindrucks-Umfragen, vor Radeon RX 7800 XT und GeForce RTX 4090.

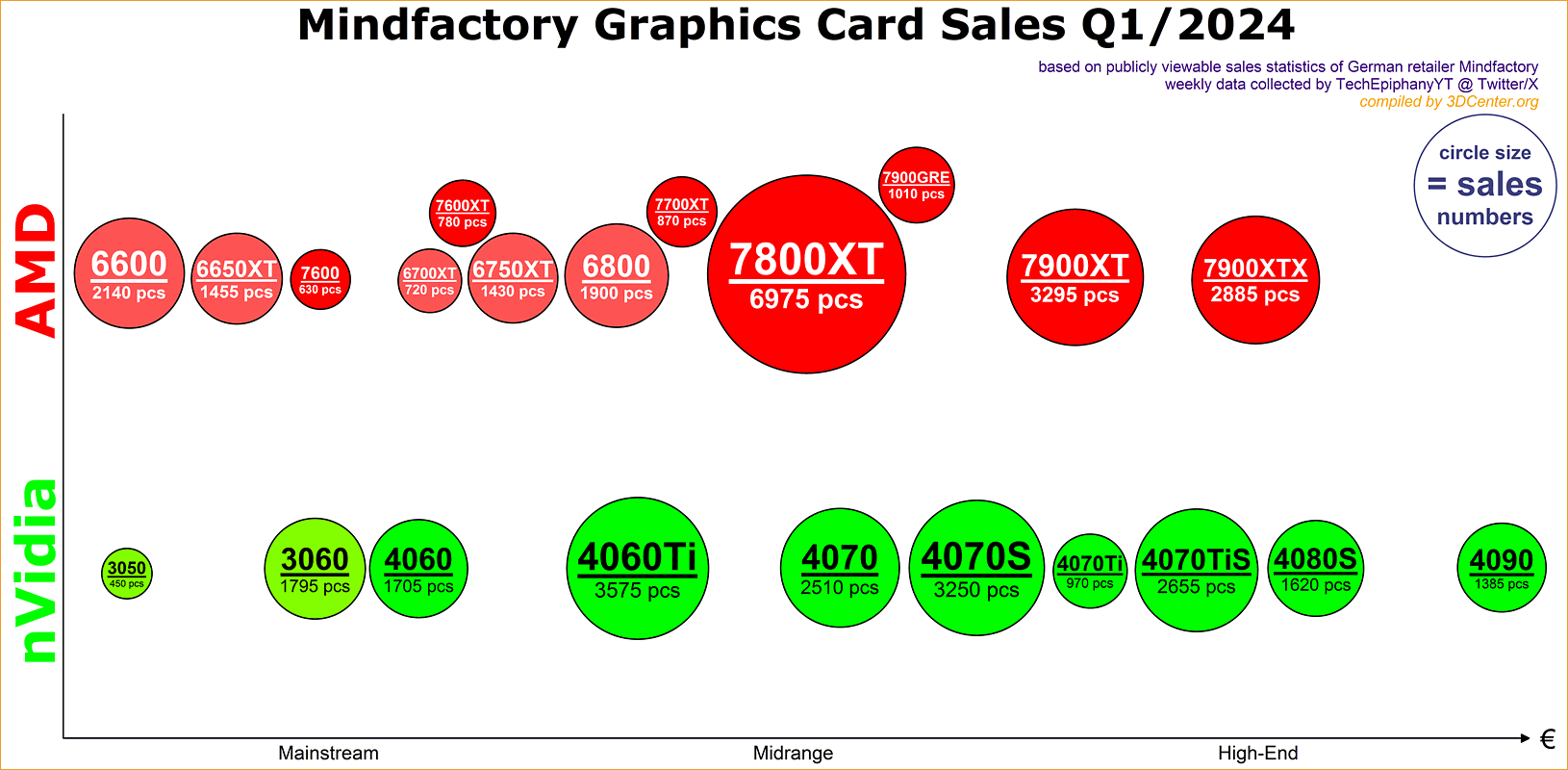

Neuer Artikel: Grafikkarten-Verkaufsstatistik Mindfactory Q1/2024

Mit dem abgelaufenen ersten Jahresquartal 2024 läßt sich eine neue Grafikkarten-Verkaufsstatistik der diesbezüglichen Absätze & Umsätze des deutschen Einzelhändlers aufstellen, in Fortsetzung der Grafikkarten-Verkaufsstatistik für das Jahr 2023. Das erste Quartal des Jahres 2024 sah jede Menge Grafikkarten-Neuvorstellungen, welche insbesondere im mittleren und oberen Segment eine deutlich veränderte Angebotssituation entstehen lassen haben. Wie die Grafikkarten-Absätze und -Umsätze von AMD, nVidia und Intel im ersten Quartal 2024 bei der Mindfactory aussehen, wie dies im Vergleich zu den Vorquartalen liegt und welche Grafikkarten-Modelle bzw. Grafikkarten-Serien sich besonders weit vorn in der Absatz-Statistik positionieren konnten, wird dieser Artikel aufzeigen ... zum Artikel.

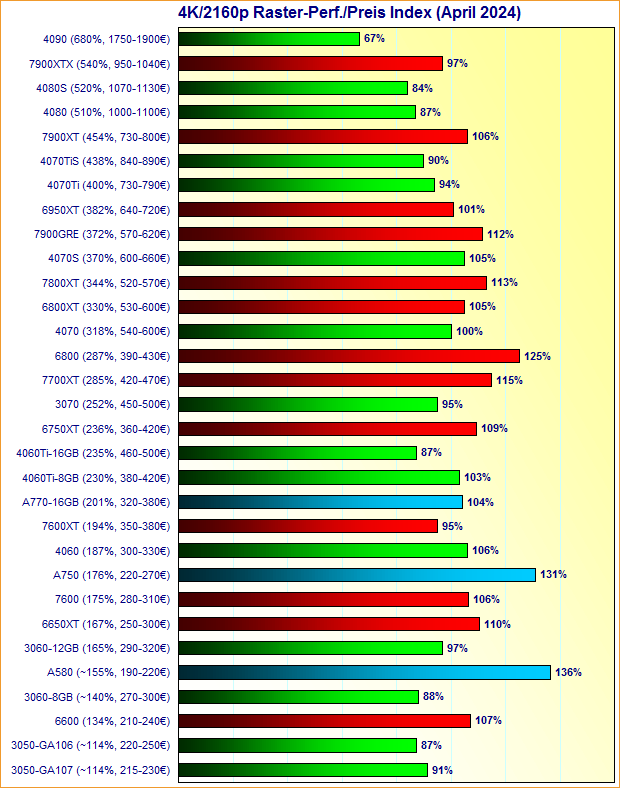

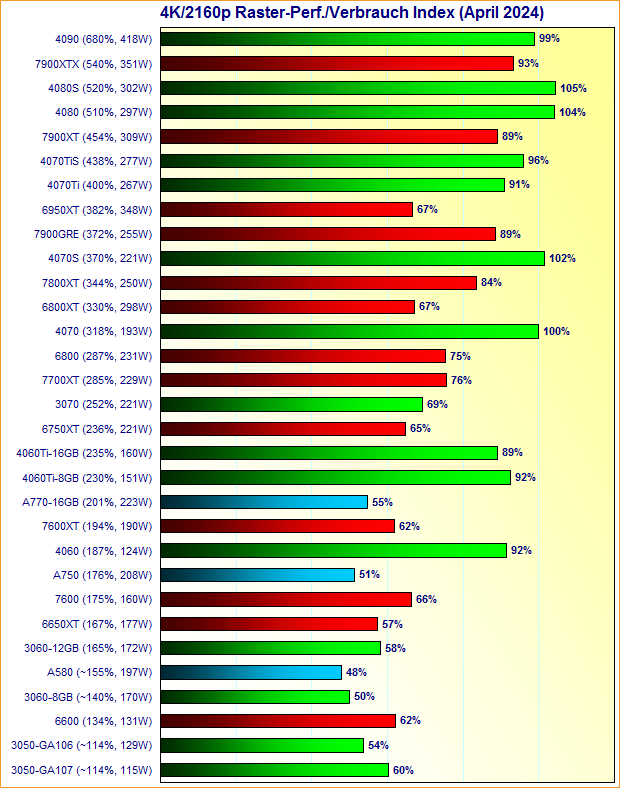

Neuer Artikel: Grafikkarten-Marktüberblick April 2024

Nachdem seit dem letzten Grafikkarten-Marktüberblick vom November 2023 einige Zeit vergangen ist (in welcher zahlreiche Grafikkarten-Neuvorstellungen lagen), soll hiermit nunmehr ein aktualisierter Überblick über den hiesigen Grafikkarten-Markt gezeichnet werden. Jener arbeitet die immerhin sechs Zugänge seit Jahresbeginn ein (Radeon RX 7600 XT, Radeon RX 7900 GRE, GeForce RTX 3050 6GB sowie die drei Modelle des GeForce RTX 40 "SUPER" Refreshs), sortiert die sich inzwischen ergebenden Markt-Abgänge aus und operiert auf Basis der jüngst aktualisierten Performance-Werte. Auf der zweiten Artikel-Seite folgen dann wiederum die entsprechenden Indizies zu Performance/Preis und Performance/Stromverbrauch unter drei Auflösungen, zuzüglich grundsätzlich gehaltener Grafikkarten-Empfehlungen. Was der Grafikkarten-Markt in Deutschland & Österreich im April 2024 für Angebote offeriert, soll somit nachfolgend in den Disziplinen Preis, Performance und Stromverbrauch betrachtet werden ... zum Artikel.

Gerüchteküche: Hardware-Daten, Chipflächen und eine erste Rechenleistungsangabe zu AMDs Navi 48 & 44

Von Twitterer All The Watts!! kommen diverse Grund-Daten zu den RDNA4-Grafikchips Navi 48 & 44, ergänzt mittels zwei nachfolgenden Tweets um eine Angabe der Chipfertigung sowie eine Angabe der Rechenleistung von Navi 48. Der Original-Tweet enthält allerdings leider keine Maßgaben dazu, welche Zahlen-Angaben was bedeuten soll, wobei sich vieles faktisch von alleine ergibt. Unsicher sind allein die jeweils zweite und vorletzte Angabe. Die zweite Angabe könnte die Menge des Infinity Caches oder die Anzahl der Shader-Cluster wiedergeben – letzteres ist aber weniger wahrscheinlich, da die erste Zeile bereits die Anzahl der WGPs enthält und sich die Anzahl der Shader-Cluster hieraus automatisch ergibt (das Doppelte der WGPs).

| Navi 48 | Navi 44 | wahrscheinliche Erklärung |

|---|---|---|

| 32 | 16 | Anzahl an WGPs (Anzahl CUs = 2x WGP) |

| 64 | 32 | Infinity Cache in MB (alternative Erklärung: Anzahl an CUs) |

| 256 | 128 | Breite des Speicherinterfaces in Bits |

| 693 | 288 | nominelle Bandbreite in GB/sec (ergibt Speicher mit 21,7 bzw. 18 Gbps) |

| 2770 | 515 | effektive Bandbreite in GB/sec (inkl. des Effekts des Infinity Caches) |

| ~240mm² | ~130mm² | Chipfläche unter der N4P-Fertigung von TSMC |

| Wiedergabe der Angaben seitens All The Watts!! @ Twitter (1./2. Spalte) samt eigenen Erklärungen (3. Spalte) | ||

Gerüchteküche: PlayStation 5 Pro mit drastisch mehr RayTracing-Performance sowie KI-unterstütztem "PSSR" Upscaling

Von YouTuber Moore's Law Is Dead kommt ein hochinteressanter Leak zur PlayStation 5 Pro, welcher nachfolgend auch noch von Konsolen-Insider Tom Henderson bestätigt wird. Zu sehen sind einige angebliche Sony-Dokumente, welche Hardware-Details zum kommenden Konsolen-Refresh auspacken. So soll die PS5Pro über eine Rechenkraft von 67 TFlops FP16 verfügen, was somit 33,5 TFlops FP32 entspricht. Dies passt gut zu den letzten Hardware-Gerüchten und würde bei 60 Shader-Clustern á RDNA3 einen GPU-Takt von ca. 2180 MHz ergeben. Einzurechnen bei allen Vergleichen mit Xbox Series X und auch der originalen PlayStation 5 wäre natürlich, dass die neue Grafiklösung der PS5Pro auf Basis einer Verbesserung der RDNA3-Architektur bereits die FP32-Verdopplung von RDNA3 trägt, die TeraFlops-Angaben somit nicht direkt mit früheren Spielekonsolen vergleichbar sind.

|